Google BERT Update: Hintergrund und Analyse

Veröffentlicht: 2019-10-29Es ist die größte Änderung am Google-Algorithmus seit fünf Jahren und betrifft jede zehnte Suchanfrage. Mit dem Google BERT Update will Google die Interpretation komplexer Long-Tail-Suchanfragen verbessern und relevantere Suchergebnisse anzeigen. Durch die Verwendung von Natural Language Processing hat Google seine Fähigkeit, den semantischen Kontext von Suchbegriffen zu verstehen, erheblich verbessert.

Wenn Sie Unterstützung bei der Suchmaschinenoptimierung Ihrer Website suchen, erhalten Sie weitere Informationen und Analysen von unseren Experten:

Vereinbaren Sie einen Termin!

Die zwei Cent von Searchmetrics für das Google BERT Update

„Bert ist eine logische Weiterentwicklung für Google und tritt in die Fußstapfen von Panda, Hummingbird und RankBrain. Diesmal betrachten wir jedoch keine Änderung in der Art und Weise, wie Daten indiziert oder eingestuft werden. Stattdessen versucht Google, den Kontext einer Suchanfrage zu identifizieren und entsprechende Ergebnisse bereitzustellen. Dies ist eine spannende Ergänzung zu dem, was kontextfreie Modelle wie Word2Vec und GloVe bieten können. Für Voice Search und Conversational Search erwarte ich in naher Zukunft deutliche Sprünge in der Qualität der Ergebnisse.“ – Malte Landwehr, VP Produkt, Searchmetrics

„Bert ist eine logische Weiterentwicklung für Google und tritt in die Fußstapfen von Panda, Hummingbird und RankBrain. Diesmal betrachten wir jedoch keine Änderung in der Art und Weise, wie Daten indiziert oder eingestuft werden. Stattdessen versucht Google, den Kontext einer Suchanfrage zu identifizieren und entsprechende Ergebnisse bereitzustellen. Dies ist eine spannende Ergänzung zu dem, was kontextfreie Modelle wie Word2Vec und GloVe bieten können. Für Voice Search und Conversational Search erwarte ich in naher Zukunft deutliche Sprünge in der Qualität der Ergebnisse.“ – Malte Landwehr, VP Produkt, Searchmetrics

Wo wurde BERT eingeführt?

Während BERT zunächst nur die organischen Suchergebnisse von Google.com nutzte, hat BERT seit Dezember 2019 mehr als 70 Sprachen weltweit ausgerollt. Für Featured Snippets, die über den organischen Suchergebnissen als Position 0 mit Text, Tabelle oder Liste angezeigt werden, wurde BERT bereits in allen 25 Sprachen verwendet, für die Google auch Featured Snippets anzeigt.

BERT wird für die Berechnung der organischen Suchergebnisse eingeführt in: Afrikaans, Albanisch, Amharisch, Arabisch, Armenisch, Azeri, Baskisch, Weißrussisch, Bulgarisch, Katalanisch, Chinesisch (vereinfacht & Taiwan), Kroatisch, Tschechisch, Dänisch, Niederländisch, Englisch , Estnisch, Farsi, Finnisch, Französisch, Galizisch, Georgisch, Deutsch, Griechisch, Gujarati, Hebräisch, Hindi, Ungarisch, Isländisch, Indonesisch, Italienisch, Japanisch, Javanisch, Kannada, Kasachisch, Khmer, Koreanisch, Kurdisch, Kirgisisch, Laotisch, Lettisch , Litauisch, Mazedonisch Malaiisch (Brunei Darussalam & Malaysia), Malayalam, Maltesisch, Marathi, Mongolisch, Nepali, Norwegisch, Polnisch, Portugiesisch, Punjabi, Rumänisch, Russisch, Serbisch, Singhalesisch, Slowakisch, Slowenisch, Spanisch Suaheli, Schwedisch, Tagalog, Tadschikisch , Tamil, Telugu, Thai, Türkisch, Ukrainisch, Urdu, Usbekisch und Vietnamesisch.

In diesem Tweet kündigte Google den weltweiten Rollout von BERT an:

BERT, unsere neue Methode für die Google-Suche, um Sprache besser zu verstehen, wird jetzt weltweit in über 70 Sprachen eingeführt. Es wurde ursprünglich im Oktober für US-Englisch eingeführt. Sie können unten mehr über BERT lesen und eine vollständige Liste der Sprachen finden Sie in diesem Thread…. https://t.co/NuKVdg6HYM

– Google SearchLiaison (@searchliaison) 9. Dezember 2019

In der Zwischenzeit hat Webmaster Trends Analyst John Mueller in einem seiner Google Webmaster Hangouts gesprochen, nachdem ein Benutzer einen Rückgang des Traffics um 40 % gemeldet und BERT als Ursache vermutet hatte. Mueller erklärte, dass BERT nicht für solche Rankings und Traffic-Rückgänge verantwortlich sei, sondern eines der regelmäßigen Updates oder ein Core-Update. Nach welchen Kriterien die Algorithmus-Änderungen vorgenommen werden, erklärt Müller ab Minute 30:46 im Video ausführlich, wie die Entwicklung bei Google funktioniert:

Was bedeutet BERT?

Die Abkürzung „BERT“ steht für Bidirectional Encoder Representations from Transformers und bezeichnet ein Algorithmusmodell, das auf neuronalen Netzen basiert. Mit Hilfe von Natural Language Processing (NLP) versuchen Maschinensysteme, die Komplexität der menschlichen Sprache zu interpretieren. Eine ausführliche Dokumentation von BERT finden Sie im KI-Blog von Google.

Einfach ausgedrückt versucht Google mit BERT, den Kontext einer Suchanfrage besser zu verstehen und die Bedeutung der einzelnen Wörter genauer zu interpretieren. Dieser Durchbruch basiert auf mathematischen Modellen namens Transformers: Diese analysieren ein Wort im Verhältnis zu allen anderen Wörtern im Satz – oder im Falle der Google-Suche die Suchanfrage – und betrachten die Bedeutung von Wörtern nicht nur isoliert. Dies ist besonders nützlich, wenn Sie die Bedeutung von Präpositionen und die Position einzelner Wörter innerhalb einer Suchanfrage interpretieren möchten.

Warum ist das BERT-Update so wichtig für Google?

Laut Google sind rund 15 Prozent aller Suchanfragen neu – das heißt, sie werden zum ersten Mal gesucht. Darüber hinaus nähert sich die Formulierung von Suchanfragen immer mehr der realen menschlichen Kommunikation an – teilweise unter dem Einfluss technischer Fortschritte wie Voice Search. Der Statistikdienst Comscore schätzt, dass der Anteil der Sprachsuchen innerhalb von zwei Jahren 50 Prozent erreichen soll. Ein weiterer Faktor ist die zunehmende Länge der Suchanfragen – heute können 70 % der Suchanfragen als Long-Tail bezeichnet werden. Menschen wenden sich mit ausformulierten Fragen an Google und erwarten in Sekundenbruchteilen präzise Antworten – und BERT macht mittlerweile einen wesentlichen Teil der Technologie aus, die dies ermöglicht.

Google arbeitet seit vielen Jahren an neuronalen Netzen, die auf neue Suchanfragen richtig reagieren und die Interpretation von Inhalten verbessern können:

- Hummingbird: 2013 wurde Hummingbird in den Google-Algorithmus integriert. Dieses Algorithmus-Update ermöglichte es, ganze Suchanfragen besser zu interpretieren, anstatt nur nach einzelnen Wörtern innerhalb einer Suchanfrage zu suchen.

- RankBrain : 2015 wurde RankBrain Teil des Algorithmus von Google und zum drittwichtigsten Rankingfaktor erklärt. Damit war es möglich, Suchbegriffe mit mehreren Bedeutungen oder anderweitig komplexe Suchanfragen zu verarbeiten, die über die normale Long-Tail-Suche hinausgehen. Mit RankBrain wurde es außerdem möglich, Erstsuchen, Umgangssprache, Dialoge und Neologismen zu verarbeiten.

Welche Suchanfragen sind von BERT betroffen?

Die Wirkung von BERT wirkt sich auf Long-Tail-Suchanfragen aus. BERT verbessert die Interpretation des Kontexts für längere Suchanfragen, die als Frage oder Wortgruppe in die Suchleiste eingegeben (oder für die Sprachsuche gesprochen) werden.

Google hat in seinem Blog einige Beispiele für Suchanfragen bereitgestellt, die BERT besser zu verstehen hilft und für die die Suchmaschine nun relevantere Ergebnisse liefern soll.

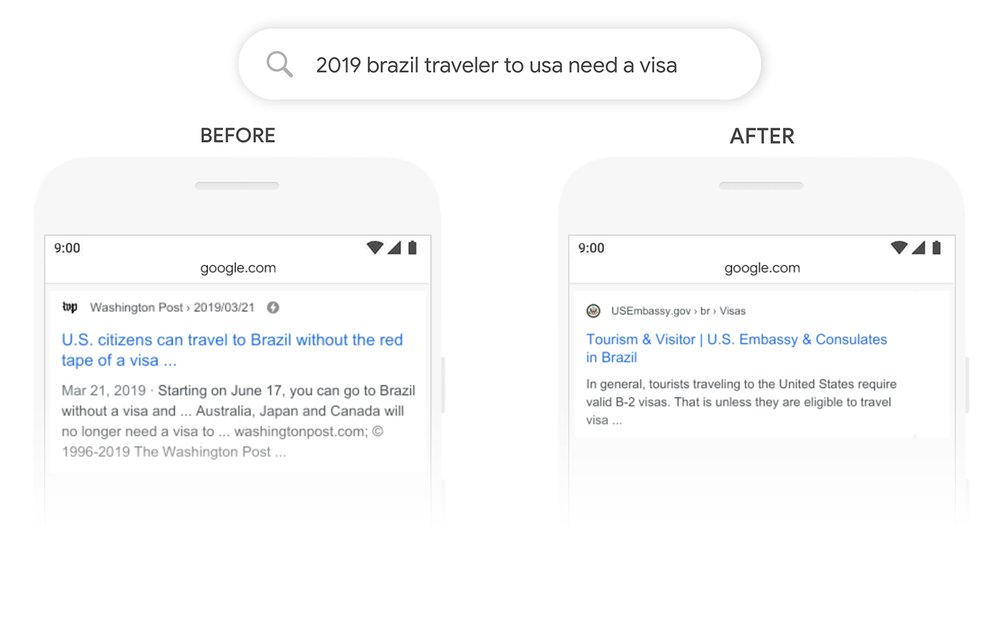

In diesem Beispiel für ein organisches Suchergebnis wurde laut Google die Bedeutung des Wortes „to“ und seine Beziehung zu anderen Wörtern bisher unterschätzt. Das Wort „to“ spielt jedoch eine wesentliche Rolle in der Bedeutung des Satzes. Wir haben es mit jemandem aus Brasilien zu tun, der in die USA reisen möchte – nicht umgekehrt. Das neue BERT-Modell ermöglicht es Google, diese Unterscheidung richtig zu verstehen und Ergebnisse bereitzustellen, die der wahren Suchabsicht entsprechen.

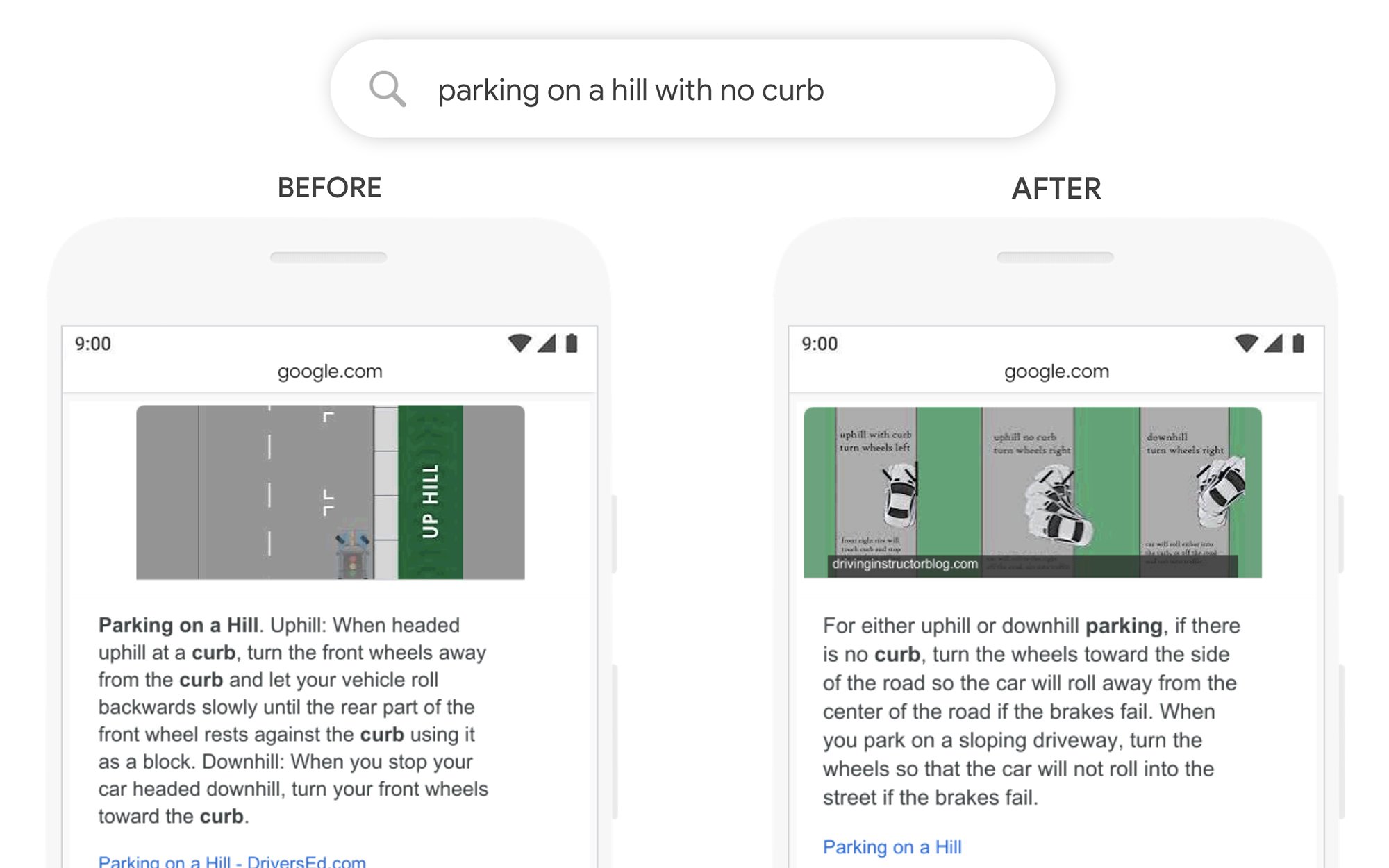

Beispiel 2: „Parken auf einem Hügel ohne Bordstein“

In diesem Beispiel aus dem Blogpost von Google, in dem es um die Auswertung der Suchergebnisse zur Auswahl des relevantesten Featured Snippets geht, wurde der Fokus früher zu stark auf das Wort „Kandare“ gelegt und die Bedeutung des Wortes „Nein“ vernachlässigt. Das bedeutete, dass ein Featured Snippet angezeigt wurde, das wenig hilfreich war, da es eigentlich die entgegengesetzte Frage zu der vom Suchenden gestellten Frage beantwortete.

Was können SEOs und Webmaster tun?

Es gibt keine einfache Antwort darauf, wie man auf BERT reagieren soll. Es gibt keine einfachen Taktiken, mit denen Sie Ihre Website plötzlich besser ranken oder Verluste wettmachen können. Stattdessen ist es wichtig zu bedenken, dass Sie Ihre Inhalte schreiben und Ihre Websites nicht nur für Algorithmen erstellen müssen, sondern für Menschen: für Ihre potenziellen Benutzer und Kunden, die Ihre Website besuchen und mit ihr interagieren.