Aggiornamento Google BERT: background e analisi

Pubblicato: 2019-10-29È il più grande cambiamento all'algoritmo di Google negli ultimi cinque anni, che interessa una query di ricerca su dieci. Con Google BERT Update, Google mira a migliorare l'interpretazione di complesse query di ricerca a coda lunga e a visualizzare risultati di ricerca più pertinenti. Utilizzando l'elaborazione del linguaggio naturale, Google ha notevolmente migliorato la sua capacità di comprendere il contesto semantico del termine di ricerca.

Se cerchi supporto per l'ottimizzazione dei motori di ricerca del tuo sito web, puoi ottenere maggiori informazioni e analisi dai nostri esperti:

Fissare un appuntamento!

I due centesimi di Searchmetrics sull'aggiornamento BERT di Google

“Bert è uno sviluppo logico per Google, seguendo le orme di Panda, Hummingbird e RankBrain. Tuttavia, questa volta non stiamo osservando un cambiamento nel modo in cui i dati vengono indicizzati o classificati. Invece, Google sta cercando di identificare il contesto di una query di ricerca e fornire risultati di conseguenza. Questa è un'entusiasmante aggiunta a ciò che i modelli privi di contesto come Word2Vec e GloVe sono in grado di offrire. Per la ricerca vocale e la ricerca conversazionale, mi aspetto di vedere notevoli passi avanti nella qualità dei risultati nel prossimo futuro". – Malte Landwehr, VP Product, Searchmetrics

“Bert è uno sviluppo logico per Google, seguendo le orme di Panda, Hummingbird e RankBrain. Tuttavia, questa volta non stiamo osservando un cambiamento nel modo in cui i dati vengono indicizzati o classificati. Invece, Google sta cercando di identificare il contesto di una query di ricerca e fornire risultati di conseguenza. Questa è un'entusiasmante aggiunta a ciò che i modelli privi di contesto come Word2Vec e GloVe sono in grado di offrire. Per la ricerca vocale e la ricerca conversazionale, mi aspetto di vedere notevoli passi avanti nella qualità dei risultati nel prossimo futuro". – Malte Landwehr, VP Product, Searchmetrics

Dove è stato lanciato BERT?

Mentre BERT inizialmente utilizzava solo i risultati di ricerca organici di Google.com, da dicembre 2019 BERT ha distribuito più di 70 lingue in tutto il mondo. Per gli snippet in primo piano, che vengono visualizzati sui risultati di ricerca organici come posizione 0 con testo, tabella o elenco, BERT è già stato utilizzato in tutte le 25 lingue per le quali Google visualizza anche gli snippet in primo piano.

BERT sta implementando il calcolo dei risultati della ricerca organica in: afrikaans, albanese, amarico, arabo, armeno, azero, basco, bielorusso, bulgaro, catalano, cinese (semplificato e taiwanese), croato, ceco, danese, olandese, inglese , estone, farsi, finlandese, francese, galiziano, georgiano, tedesco, greco, gujarati, ebraico, hindi, ungherese, islandese, indonesiano, italiano, giapponese, giavanese, kannada, kazako, khmer, coreano, curdo, kirghiso, laotiano, lettone , lituano, macedone malese (Brunei Darussalam e Malesia), malayalam, maltese, marathi, mongolo, nepalese, norvegese, polacco, portoghese, punjabi, rumeno, russo, serbo, singalese, slovacco, sloveno, spagnolo swahili, svedese, tagalog, tagiko , tamil, telugu, tailandese, turco, ucraino, urdu, uzbeko e vietnamita.

In questo tweet, Google ha annunciato il lancio globale di BERT:

BERT, il nostro nuovo modo per la ricerca di Google di comprendere meglio la lingua, è ora disponibile in oltre 70 lingue in tutto il mondo. Inizialmente è stato lanciato in ottobre per l'inglese americano. Puoi leggere di più su BERT di seguito e un elenco completo delle lingue è in questo thread…. https://t.co/NuKVdg6HYM

— Google SearchLiaison (@searchliaison) 9 dicembre 2019

Nel frattempo, l'analista di Webmaster Trends John Mueller ha parlato in uno dei suoi hangout per i webmaster di Google dopo che un utente ha segnalato un calo del traffico del 40% e sospettava che la causa fosse BERT. Mueller ha spiegato che BERT non era responsabile di tali classifiche e diminuzioni del traffico, ma di uno degli aggiornamenti regolari o di un aggiornamento principale. In base a quali criteri vengono apportate le modifiche all'algoritmo, Mueller spiega in dettaglio come funziona lo sviluppo di Google da 30:46 minuti nel video:

Cosa significa BERT?

L'abbreviazione "BERT" sta per Bidirectional Encoder Representations di Transformers e si riferisce a un modello di algoritmo basato su reti neurali. Con l'aiuto del Natural Language Processing (NLP), i sistemi macchina tentano di interpretare la complessità del linguaggio umano. Puoi trovare una documentazione dettagliata di BERT sul blog AI di Google.

In parole povere, Google utilizza BERT per cercare di comprendere meglio il contesto di una query di ricerca e per interpretare in modo più accurato il significato delle singole parole. Questa svolta si basa su modelli matematici chiamati Transformers: questi analizzano una parola in relazione a tutte le altre parole nella frase – o nel caso di Google cerca la query di ricerca – e non guardano semplicemente il significato delle parole in isolamento. Ciò è particolarmente utile quando si interpreta il significato delle preposizioni e la posizione delle singole parole all'interno di una query di ricerca.

Perché l'aggiornamento BERT è così importante per Google?

Secondo Google, circa il 15% di tutte le query di ricerca sono nuove, il che significa che vengono cercate per la prima volta. Inoltre, il fraseggio delle query di ricerca si sta avvicinando sempre di più alla vera comunicazione umana, in parte sotto l'influenza di progressi tecnici come la ricerca vocale. Il servizio di statistiche Comscore stima che la percentuale di ricerche vocali raggiunga il 50 percento entro due anni. Un altro fattore è la lunghezza crescente delle query di ricerca: oggi il 70% delle ricerche può essere considerato a coda lunga. Le persone si rivolgono a Google con domande completamente formulate e si aspettano risposte precise in una frazione di secondo - e BERT ora costituisce una parte significativa della tecnologia che lo rende possibile.

Da molti anni Google lavora su reti neurali in grado di rispondere correttamente alle nuove query di ricerca e migliorare l'interpretazione dei contenuti:

- Hummingbird: nel 2013, Hummingbird è stato incorporato nell'algoritmo di Google. Questo aggiornamento dell'algoritmo ha permesso di interpretare meglio intere query di ricerca, piuttosto che cercare solo le singole parole all'interno di una query.

- RankBrain : nel 2015, RankBrain è diventato parte dell'algoritmo di Google ed è stato dichiarato il terzo fattore di ranking più importante. Ciò ha consentito di elaborare termini di ricerca con più significati o query comunque complesse che vanno oltre la normale ricerca a coda lunga. Con RankBrain è stato anche possibile elaborare ricerche per la prima volta, colloquialismi, dialoghi e neologismi.

Quali query di ricerca sono interessate da BERT?

L'impatto di BERT influisce sulle query di ricerca a coda lunga. BERT migliora l'interpretazione del contesto per le query più lunghe che vengono immesse (o pronunciate per la ricerca vocale) nella barra di ricerca come una domanda o un gruppo di parole.

Sul loro blog, Google ha fornito alcuni esempi di query di ricerca che BERT aiuta a comprendere meglio e per le quali il motore di ricerca ora fornisce risultati più pertinenti.

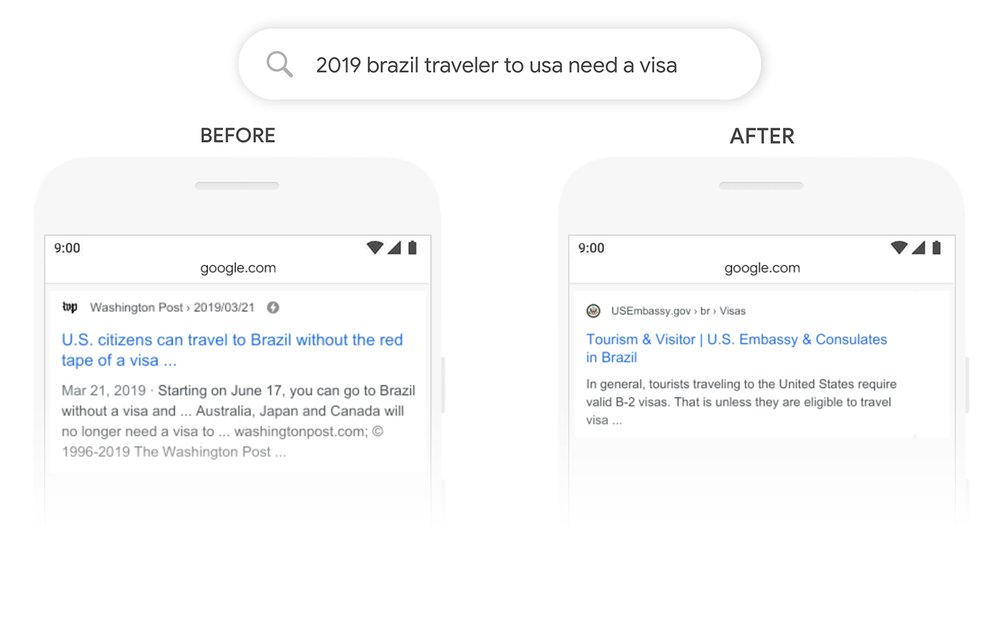

In questo esempio per un risultato di ricerca organico, secondo Google, l'importanza della parola "a" e la sua relazione con altre parole erano precedentemente sottovalutate. Tuttavia, la parola "a" gioca un ruolo fondamentale nel significato della frase. Abbiamo a che fare con qualcuno dal Brasile che vuole viaggiare negli Stati Uniti, non il contrario. Il nuovo modello BERT consente a Google di comprendere correttamente questa distinzione e fornire risultati che corrispondono al vero intento di ricerca.

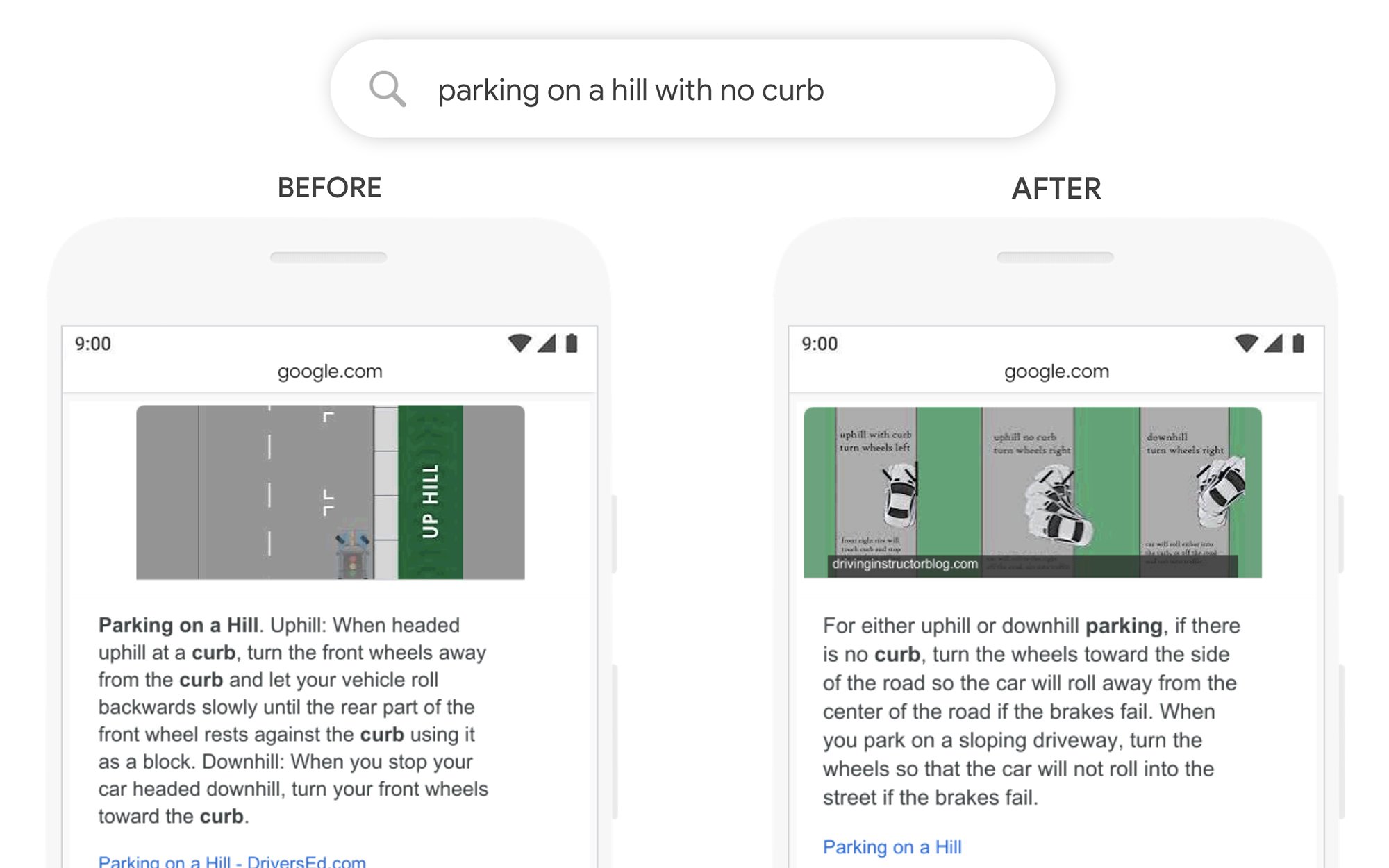

Esempio 2: “Parcheggio in collina senza cordolo”

In questo esempio tratto dal post del blog di Google, che si occupa di valutare i risultati della ricerca per scegliere il Featured Snippet più pertinente, l'attenzione veniva posta troppo pesantemente sulla parola "curb", ignorando l'importanza della parola "no". Ciò significava che veniva visualizzato uno snippet in primo piano che era di scarsa utilità, poiché in realtà rispondeva alla domanda opposta a quella posta dal ricercatore.

Cosa possono fare SEO e webmaster?

Non esiste una risposta semplice su come reagire al BERT. Non ci sono tattiche facili che puoi usare per migliorare improvvisamente il posizionamento del tuo sito web o per recuperare le perdite. Invece, è importante tenere a mente che devi scrivere i tuoi contenuti e costruire i tuoi siti web non solo per gli algoritmi, ma per le persone: per i tuoi potenziali utenti e clienti che visiteranno e interagiranno con il tuo sito web.