Actualización de Google BERT: antecedentes y análisis

Publicado: 2019-10-29Es el mayor cambio en el algoritmo de Google en cinco años y afecta a una de cada diez consultas de búsqueda. Con Google BERT Update, Google tiene como objetivo mejorar la interpretación de consultas de búsqueda complejas de cola larga y mostrar resultados de búsqueda más relevantes. Mediante el uso del procesamiento del lenguaje natural, Google ha mejorado mucho su capacidad para comprender el contexto semántico del término de búsqueda.

Si está buscando apoyo con la optimización de motores de búsqueda de su sitio web, puede obtener más información y análisis de nuestros expertos:

¡Organizar una cita!

Los dos centavos de Searchmetrics en la actualización de Google BERT

“Bert es un desarrollo lógico para Google, siguiendo los pasos de Panda, Hummingbird y RankBrain. Sin embargo, esta vez no estamos viendo un cambio en la forma en que se indexan o clasifican los datos. En cambio, Google está tratando de identificar el contexto de una consulta de búsqueda y proporcionar resultados en consecuencia. Esta es una adición emocionante a lo que pueden ofrecer los modelos libres de contexto como Word2Vec y GloVe. Para la búsqueda por voz y la búsqueda conversacional, esperaría ver avances significativos en la calidad de los resultados en un futuro cercano". – Malte Landwehr, vicepresidente de productos, Searchmetrics

“Bert es un desarrollo lógico para Google, siguiendo los pasos de Panda, Hummingbird y RankBrain. Sin embargo, esta vez no estamos viendo un cambio en la forma en que se indexan o clasifican los datos. En cambio, Google está tratando de identificar el contexto de una consulta de búsqueda y proporcionar resultados en consecuencia. Esta es una adición emocionante a lo que pueden ofrecer los modelos libres de contexto como Word2Vec y GloVe. Para la búsqueda por voz y la búsqueda conversacional, esperaría ver avances significativos en la calidad de los resultados en un futuro cercano". – Malte Landwehr, vicepresidente de productos, Searchmetrics

¿Dónde se ha implementado BERT?

Si bien BERT inicialmente solo usaba los resultados de búsqueda orgánicos de Google.com, desde diciembre de 2019 BERT ha implementado más de 70 idiomas en todo el mundo. Para los fragmentos destacados, que se muestran sobre los resultados de búsqueda orgánicos como posición 0 con texto, tabla o lista, BERT ya se ha utilizado en los 25 idiomas para los que Google también muestra fragmentos destacados.

BERT se está implementando para el cálculo de los resultados de la búsqueda orgánica en: afrikáans, albanés, amárico, árabe, armenio, azerí, vasco, bielorruso, búlgaro, catalán, chino (simplificado y taiwanés), croata, checo, danés, holandés, inglés , estonio, farsi, finlandés, francés, gallego, georgiano, alemán, griego, gujarati, hebreo, hindi, húngaro, islandés, indonesio, italiano, japonés, javanés, kannada, kazajo, jemer, coreano, kurdo, kirguís, laosiano, letón , lituano, macedonio malayo (Brunei Darussalam y Malasia), malayalam, maltés, marathi, mongol, nepalí, noruego, polaco, portugués, punjabí, rumano, ruso, serbio, cingalés, eslovaco, esloveno, español swahili, sueco, tagalo, tayiko , tamil, telugu, tailandés, turco, ucraniano, urdu, uzbeko y vietnamita.

En este tweet, Google anunció el lanzamiento global de BERT:

BERT, nuestra nueva forma de que la Búsqueda de Google comprenda mejor el idioma, ahora se está implementando en más de 70 idiomas en todo el mundo. Inicialmente se lanzó en octubre para inglés estadounidense. Puede leer más sobre BERT a continuación y hay una lista completa de idiomas en este hilo... https://t.co/NuKVdg6HYM

— Google SearchLiaison (@searchliaison) 9 de diciembre de 2019

Mientras tanto, el analista de Tendencias para webmasters, John Mueller, habló en uno de sus Hangouts para webmasters de Google después de que un usuario informara una disminución del 40% en el tráfico y sospechara que BERT era la causa. Mueller explicó que BERT no era responsable de tales clasificaciones y disminuciones de tráfico, sino de una de las actualizaciones periódicas o una actualización central. Según qué criterios se realizan los cambios de algoritmo, Mueller explica detalladamente cómo funciona el desarrollo en Google a partir del minuto 30:46 del video:

¿Qué significa BERT?

La abreviatura, 'BERT', significa Representaciones de codificador bidireccional de transformadores y se refiere a un modelo de algoritmo que se basa en redes neuronales. Con la ayuda del procesamiento del lenguaje natural (NLP), los sistemas de máquinas intentan interpretar la complejidad del lenguaje humano. Puede encontrar una documentación detallada de BERT en el blog de IA de Google.

En pocas palabras, Google usa BERT para tratar de comprender mejor el contexto de una consulta de búsqueda e interpretar con mayor precisión el significado de las palabras individuales. Este avance se basa en modelos matemáticos llamados transformadores: estos analizan una palabra en relación con todas las demás palabras en la oración, o en el caso de la búsqueda de Google, la consulta de búsqueda, y no solo miran el significado de las palabras de forma aislada. Esto es particularmente útil cuando se interpreta el significado de las preposiciones y la posición de las palabras individuales dentro de una consulta de búsqueda.

¿Por qué la actualización BERT es tan importante para Google?

Según Google, alrededor del 15 por ciento de todas las consultas de búsqueda son nuevas, lo que significa que se buscan por primera vez. Además, la redacción de las consultas de búsqueda se acerca cada vez más a la comunicación humana real, en parte bajo la influencia de avances técnicos como la búsqueda por voz. El servicio de estadísticas Comscore calcula que la proporción de búsquedas por voz alcanzará el 50 por ciento en dos años. Otro factor es la longitud cada vez mayor de las consultas de búsqueda: hoy en día, el 70% de las búsquedas pueden considerarse de cola larga. Las personas recurren a Google con preguntas completamente formuladas y esperan respuestas precisas en una fracción de segundo, y BERT ahora constituye una parte importante de la tecnología que lo hace posible.

Desde hace muchos años, Google trabaja en redes neuronales que pueden responder correctamente a nuevas consultas de búsqueda y mejorar la interpretación del contenido:

- Hummingbird: en 2013, Hummingbird se incorporó al algoritmo de Google. Esta actualización del algoritmo hizo posible interpretar mejor las consultas de búsqueda completas, en lugar de solo buscar las palabras individuales dentro de una consulta.

- RankBrain : en 2015, RankBrain se convirtió en parte del algoritmo de Google y fue declarado el tercer factor de clasificación más importante. Esto hizo posible procesar términos de búsqueda con múltiples significados o consultas complejas que van más allá de la búsqueda de cola larga normal. Con RankBrain, también fue posible procesar búsquedas por primera vez, coloquialismos, diálogos y neologismos.

¿Qué consultas de búsqueda se ven afectadas por BERT?

El impacto de BERT afecta las consultas de búsqueda de cola larga. BERT mejora la interpretación del contexto para consultas más largas que se ingresan (o se pronuncian para la búsqueda por voz) en la barra de búsqueda como una pregunta o un grupo de palabras.

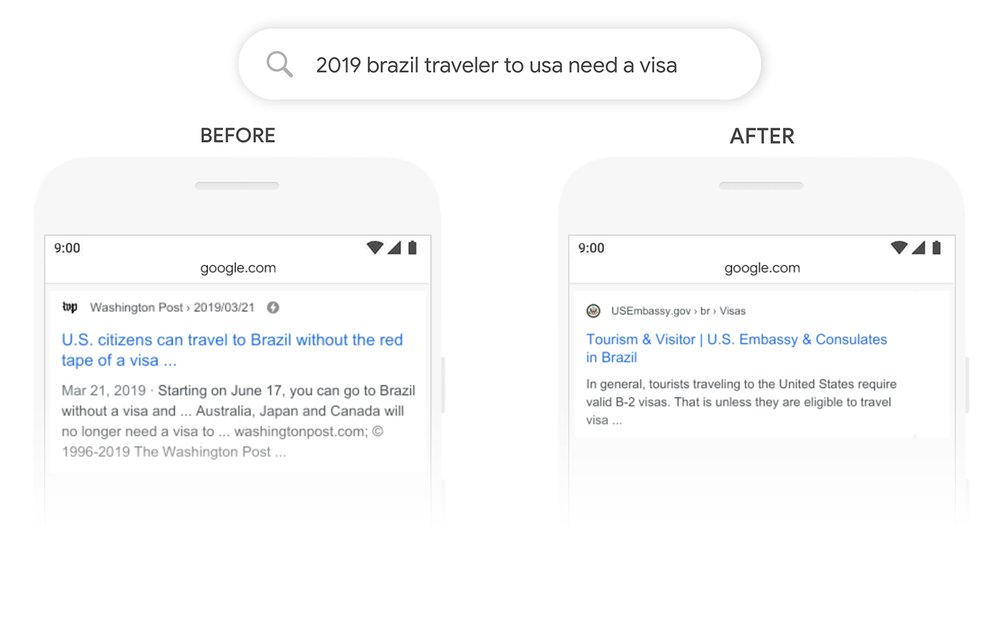

En su blog, Google proporcionó algunos ejemplos de consultas de búsqueda que BERT ayuda a comprender mejor y para las cuales el motor de búsqueda ahora brinda resultados más relevantes.

En este ejemplo para un resultado de búsqueda orgánico, según Google, la importancia de la palabra "to" y su relación con otras palabras se subestimaron previamente. Sin embargo, la palabra "to" juega un papel integral en el significado de la oración. Estamos tratando con alguien de Brasil que quiere viajar a los EE. UU., no al revés. El nuevo modelo BERT hace posible que Google entienda correctamente esta distinción y brinde resultados que correspondan a la verdadera intención de búsqueda.

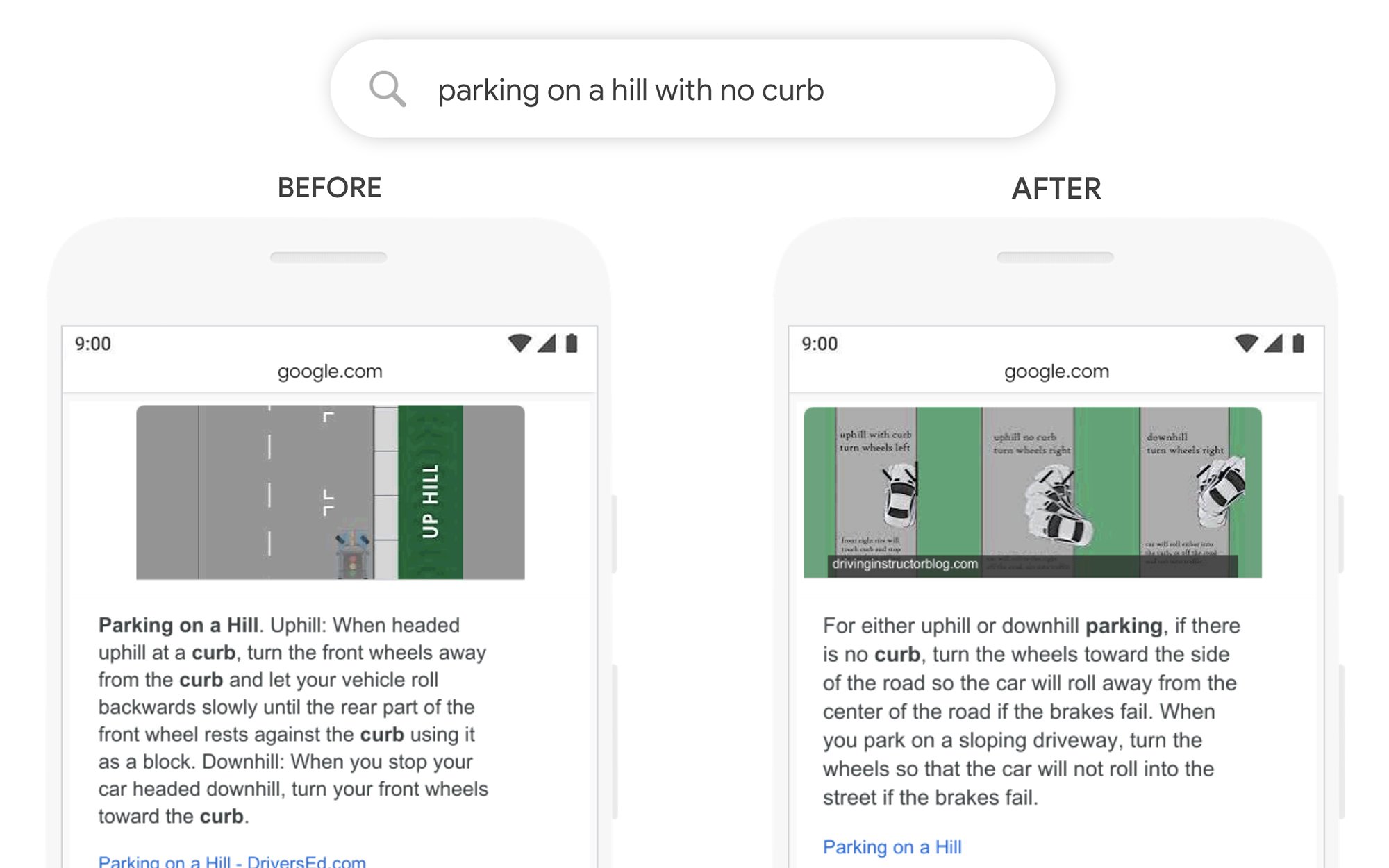

Ejemplo 2: "Estacionamiento en una colina sin bordillo"

En este ejemplo de la publicación de blog de Google, que trata de evaluar los resultados de búsqueda para elegir el fragmento destacado más relevante, el enfoque solía estar demasiado centrado en la palabra "bordillo", ignorando la importancia de la palabra "no". Esto significaba que se mostraba un Fragmento destacado que era de poca utilidad, ya que en realidad respondía a la pregunta opuesta a la planteada por el buscador.

¿Qué pueden hacer los SEO y los webmasters?

No hay una respuesta simple sobre cómo reaccionar ante BERT. No hay tácticas fáciles que pueda usar para hacer que su sitio web se clasifique mejor de repente o para recuperar pérdidas. En cambio, es importante tener en cuenta que debe escribir su contenido y crear sus sitios web no solo para los algoritmos, sino también para las personas: para sus usuarios y clientes potenciales que visitarán e interactuarán con su sitio web.