AB'de Yapay Zeka Düzenlemesi ve Uyumluluğu: Yazılım Geliştirmeye İlişkin Yasal Ortamın Çizelgesi

Yayınlanan: 2024-02-12Yapay zeka (AI), dünyamızın işleyiş şeklini hızla değiştirerek çeşitli sektörler üzerinde önemli bir etki bırakıyor. Teknoloji, kişiselleştirilmiş sağlık hizmetleri sunmaktan lojistik ve tedarik zincirlerini optimize etmeye kadar tüm sektörlerde yeteneklerini sergiledi.

Avrupa pazarlarına gelindiğinde, ülkeler ve işletmelerin inovasyonu, büyümeyi ve toplumsal refahı teşvik etmek için yapay zeka destekli yazılım geliştirmeyi hızla benimsemesi nedeniyle yapay zekanın potansiyeli özellikle ümit vericidir.

Ancak heyecanın yanı sıra çözülmesi gereken önemli zorluklar da var. Algoritmaların önyargıları, şeffaflıkları ve potansiyel işten çıkarmalara ilişkin endişeler, dikkatli bir şekilde değerlendirilmesi gereken çok sayıda etik ve sosyal soruyu gündeme getirdi. Yapay zeka ortamında etkili bir şekilde gezinmek için potansiyelinden yararlanma ve risklerini azaltma arasında denge kurmak çok önemlidir.

Özellikle, Avrupa Birliği yakın zamanda AB Yapay Zeka düzenlemesinin önemini vurgulayarak Yapay Zeka Yasasını değiştirdi. Avrupa'daki yazılım geliştirme pazarına girmek isteyen işletmeler için bu düzenlemeleri anlamak ve bunlara uymak artık isteğe bağlı değil, işin önemli bir parçası.

Bu blog, yapay zeka ve yazılım geliştirmenin kesişimiyle ilgili her şeyi anlamanıza yardımcı olacak ve AB'de yapay zeka düzenlemelerinin gelişen ortamını vurgulayacak. Buna ek olarak, hükümetin yapay zeka düzenleyici standartlarına bağlı kalmanın önemine de değineceğiz.

Neyse lafı daha fazla uzatmadan önemli detaylara geçelim.

AB'de Yapay Zeka Düzenlemesinin Önemi

Avrupa Birliği (AB), yapay zeka destekli yazılımların hakim olduğu bir dünyada düzenleme ve uyumluluk konusunda proaktif bir duruş sergiliyor. Güçlü teknolojinin potansiyel faydalarını ve risklerini tanıyan AB, etik uygulamalar, şeffaflık ve sorumlu dağıtımla desteklenen sağlam bir çerçeve oluşturmayı amaçlamaktadır. Yazılım geliştirmede yapay zeka uyumluluğunun önemini anlamak birkaç nedenden dolayı çok önemlidir:

Güven Oluşturmak

AB'deki yapay zeka uyumluluğu, yapay zeka sistemlerinin etik bir şekilde geliştirilmesini ve kullanılmasını sağlayarak kullanıcılar, işletmeler ve paydaşlar arasında güven oluşturmayı amaçlıyor. Bu güven, yapay zeka çözümlerinin yaygın olarak benimsenmesi ve sürekli geliştirilmesi için gereklidir.

Etik Risklerin Azaltılması

Yapay zeka günlük hayata giderek daha fazla entegre oldukça önyargı, ayrımcılık ve diğer etik kaygıların potansiyeli de artıyor. AB düzenlemeleri bu risklerin azaltılmasına ve yapay zeka sistemlerinin adil ve sorumlu bir şekilde kullanılmasını sağlamaya yönelik rehberlik etmektedir.

Uyumluluk ve Sürdürülebilirlik

AB, net uyumluluk gereklilikleri belirleyerek sürdürülebilir ve sorumlu bir yapay zeka ekosistemi yaratmayı amaçlıyor. Bu, işletmelerin riskleri yönetmesine, siber güvenliği güçlendirmesine ve şeffaflığı artırmasına yardımcı olur. Sonuçta yapay zeka uyumluluğunun önemini anlamak, işletmelerin yasal sorunları yönetmesine yardımcı olur ve yapay zekanın sorumlu bir şekilde geliştirilmesini ve yaygınlaştırılmasını destekler.

AB'de yapay zeka uyumluluğu yalnızca işletmeler için yasal bir zorunluluk değil, aynı zamanda yapay zekanın uzun vadeli başarısına ve toplumdaki olumlu etkisine yönelik stratejik bir yatırımdır. İşletmeler, AB'deki yapay zeka düzenlemelerine bağlı kalarak, yapay zeka destekli çözümlerinin herkese etik ve sürdürülebilir şekilde fayda sağladığı bir geleceğin inşasına katkıda bulunabilir.

Bir yapay zeka sisteminin kurallara uyduğundan emin olmak için bir uygunluk değerlendirmesinden geçmesi gerekir. Geçtikten sonra AB veritabanına kaydolur ve piyasaya sürülmeden önce standartları karşıladığını gösteren bir CE (Avrupa Uygunluğu) işareti alır. Sistemde, yeni veriler konusunda eğitim vermek veya özellik eklemek/kaldırmak gibi büyük değişiklikler varsa, tekrar sertifikalandırılıp veritabanına geri koyulmadan önce, kurallara hâlâ uyduğundan emin olmak için yeni bir değerlendirmeden geçmesi gerekir.

AB Yapay Zeka Düzenlemesi: Yapay Zeka Destekli Yazılım Geliştirme için Düzenleyici Ortamda Gezinme

Avrupa Birliği, yapay zeka alanını önemli ölçüde etkileyen birçok temel düzenlemeyi uygulamaya koydu. Yazılım geliştirmede yapay zeka düzenlemesi, bireylerin mahremiyetini koruyabilen ve potansiyel riskleri azaltabilen etik yapay zeka gelişimini sağlamak için tasarlanmıştır. Yapay zeka gelişimi için bazı önemli AB uyumluluklarını inceleyelim.

1. Genel Veri Koruma Yönetmeliği (GDPR)

Genel Veri Koruma Yönetmeliği (GDPR), Avrupa Birliği'nde yapay zeka ortamının şekillenmesinde önemli bir faktördür. Kişisel verileri korumaya odaklanır ve yapay zeka uygulamalarında şeffaflığı ve hesap verebilirliği sağlamak için katı önlemler uygular.

Buna ek olarak GDPR, algoritmik önyargıyı da ele alarak adil ve tarafsız yapay zeka sistemlerinin önemini vurguluyor. Yönetmelik, yapay zeka projeleri için potansiyel riskleri ve gizlilik sonuçlarını değerlendiren Veri Koruma Etki Değerlendirmelerinin (DPIA'lar) kullanılmasını zorunlu kılmaktadır. Bu kapsamlı düzenleyici çerçeve, AB içerisinde etik ve sorumlu yapay zeka gelişimi için güçlü bir temel oluşturmayı amaçlamaktadır.

2. Yapay Zeka Yasası

Yapay Zeka Yasası, yüksek riskli yapay zeka sistemlerini yöneten kapsamlı bir çerçevedir. Şeffaflık, açıklanabilirlik ve insan gözetimine ilişkin gereklilikleri ana hatlarıyla belirtir. Bu düzenleyici yapı, sorumlu ve açıklanabilir yapay zeka geliştirme ve dağıtımını teşvik etmeyi amaçlamaktadır.

Yapay zeka destekli yazılım geliştiren işletmelerin, uyumluluk zaman çizelgeleri ve pratik hususlar da dahil olmak üzere, yazılım geliştirmede yapay zeka uyumluluğuna ve bunun sonuçlarına uyması gerekir. Kanun, şeffaflık ve gözetim kriterleri oluşturarak, yeniliği teşvik etmek ile temel hakları korumak arasında bir denge kurar. Avrupa Birliği'nde etik yapay zeka uygulamalarının önünü açıyor.

3. Ürün Sorumluluğu Direktifi

Ürün Sorumluluğu Direktifi, yapay zeka ürünlerinin güvenliğine ve son kullanıcıların refahına öncelik veren kapsamlı bir çerçevedir. Ürün güvenliğine yönelik proaktif bir yaklaşım ihtiyacını vurgulayarak geliştiricilere yapay zeka ürünleriyle ilişkili potansiyel riskleri yönetme sorumluluğunu verir.

Yönerge, ürün geliştirmeyle ilgili geliştiricileri, yapay zeka ürünlerinin genel güvenlik standartlarını geliştirmek için risk yönetimi stratejilerini keşfetmeye teşvik ediyor. Geliştiriciler bu önlemlere bağlı kalarak Avrupa Birliği içinde güvenli ve güvenilir bir yapay zeka ortamının yaratılmasına katkıda bulunabilir.

İşletmeler, AB'deki yapay zeka düzenlemelerini kapsamlı bir şekilde anlayarak, gelişen yapay zeka geliştirme ortamında ilerleyebilir, uyumluluğu, etik uygulamaları ve yapay zeka teknolojilerinin sorumlu bir şekilde konuşlandırılmasını sağlayabilir.

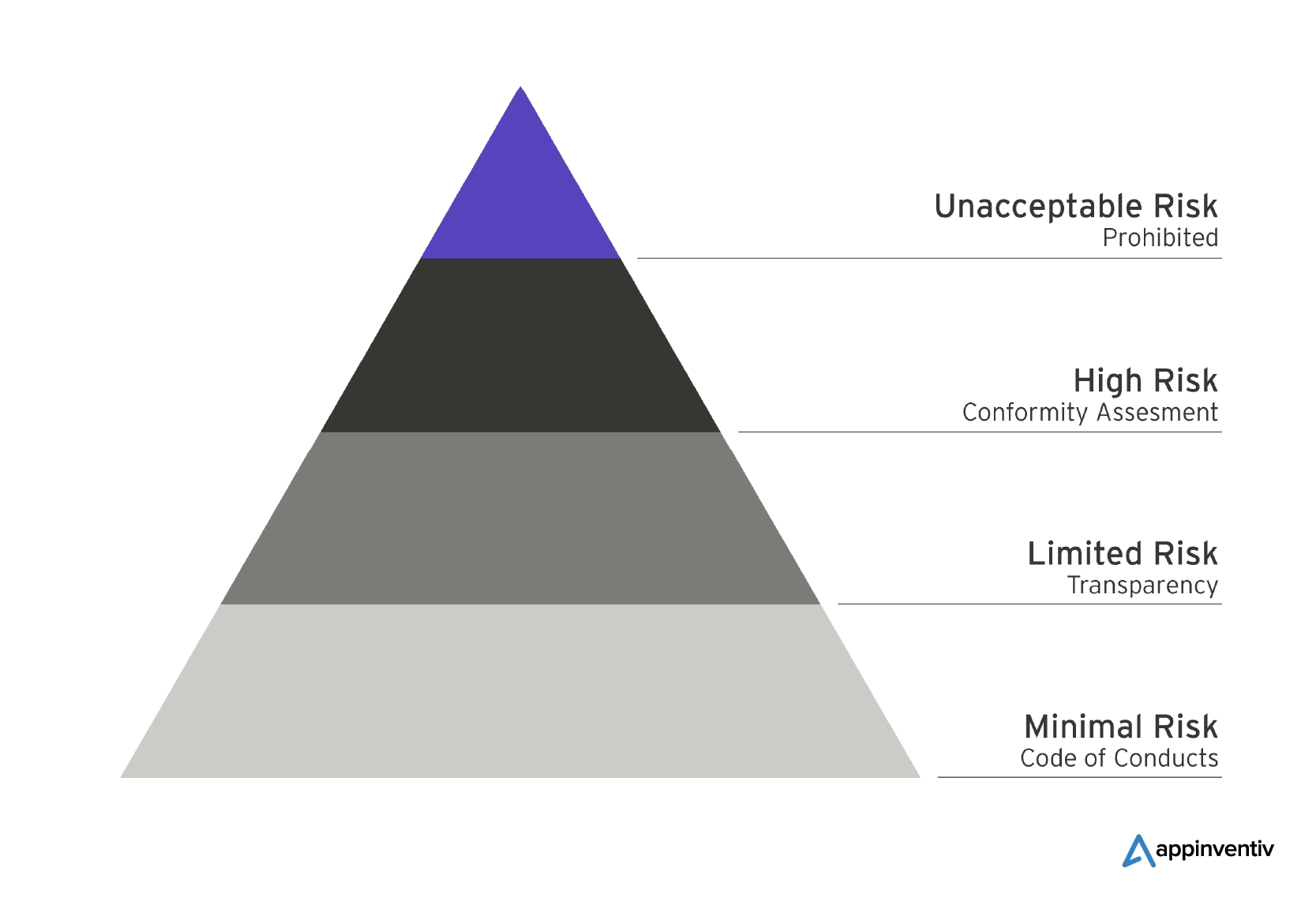

Risk Spektrumunda Gezinme: Yeni AB Yapay Zeka Yasasındaki Risk Kategorilerini Anlamak

Avrupa Parlamentosu'na göre öncelikli amaç, AB içinde kullanılan yapay zeka sistemlerinin güvenliğini, şeffaflığını, izlenebilirliğini, ayrımcılık yapılmamasını ve çevresel sürdürülebilirliğini sağlamaktır. Böylece yapay zeka sistemleriyle ilişkili risk düzeyine göre farklılaştırılmış kurallar oluşturdular. Aşağıda birden fazla kategoriye ayrıntılı olarak bakalım:

Kabul Edilemez Risk: Tehdit Eden Yapay Zeka Sistemlerinin Yasaklanması

Kabul edilemez risk kategorisine giren yapay zeka sistemleri, bireylere yönelik doğrudan tehdit olarak kabul ediliyor ve yeni AB Yapay Zeka Yasası uyarınca doğrudan yasaklanmayla karşı karşıya kalacak. Örneğin, bilişsel davranışsal manipülasyon, sosyal puanlama ve biyometrik tanımlama, bu yasaklı kategoriye giren faaliyetlerden bazılarıdır. Özellikle gerçek zamanlı biyometrik tanımlama sistemleri söz konusu olduğunda, sıkı koşullara tabi olacak belirli kolluk kuvvetleri uygulamaları için bazı istisnalara izin verilebilir.

Yüksek Risk: Güvenliğin ve Temel Hakların Korunması

AB Yapay Zeka Yasasında ana hatları belirtilen yüksek risk kategorisi, yapay zeka kullanılırken temel hakların güvenliğini ve korunmasını sağlamaya yönelik koruyucu bir önlem olarak hizmet ediyor. Bu kategori, güvenliği veya temel hakları olumsuz yönde etkileme potansiyeline sahip yapay zeka sistemlerini kapsar.

Daha fazla netlik sağlamak için yüksek risk kategorisi iki alt kategoriye ayrılmıştır. İlk alt kategori, oyuncaklar, havacılık ve tıbbi cihazlar gibi çok çeşitli sektörleri içeren AB ürün güvenliği mevzuatına tabi ürünlere entegre edilen yapay zeka sistemlerine odaklanıyor. İkinci alt kategori, belirli kritik alanlarda çalışan ve bir AB veritabanına zorunlu kayıt gerektiren yapay zeka sistemlerine odaklanır.

Sınırlı Risk: Bilgilendirilmiş Kullanıcı Kararları için Asgari Şeffaflık

Sınırlı risk olarak sınıflandırılan yapay zeka sistemlerinin, kullanıcıların bilinçli kararlar almasına olanak tanıyan minimum şeffaflık gereksinimlerine uyması gerekir. Sınırlı risk kısıtlamaları uyarınca kullanıcının, deepfake gibi görüntü, ses veya video içeriği üreten veya değiştiren yapay zeka uygulamalarıyla etkileşimde bulunduğunda bilgilendirilmesi gerekir. Sınırlı riskli yapay zekaya yönelik şeffaflık standartları, kullanıcı farkındalığı ile yapay zeka uygulamalarının kusursuz kullanımı arasında bir denge kurmaya odaklanıyor.

Genel Amaçlı ve Üretken Yapay Zeka: Şeffaflığın Sağlanması

AB Yapay Zeka Yasası, operasyonlarında şeffaflığı sağlamak amacıyla genel amaçlı ve üretken yapay zeka modelleri için açık yönergeler oluşturuyor. Buna, içeriklerinin yapay zeka tarafından oluşturulduğunu açıklamak, yasa dışı içerik oluşturulmasını önlemek ve eğitim için kullanılan telif hakkıyla korunan verilerin özetlerini yayınlamak için gerekli olan ChatGPT gibi araçlar da dahildir.

Ayrıca, GPT-4 gibi gelişmiş modeller gibi yüksek etkili genel amaçlı yapay zeka modellerinin kapsamlı değerlendirmelerden geçmesi gerekiyor. Bu modeller, ciddi olayların yaşanması durumunda bu tür olayları Avrupa Komisyonu'na bildirmekle yükümlüdür.

Yapay Zeka Uyumlu Yazılım Geliştirme – İşletmeler İçin Önemli Hususlar

MIT incelemesinden elde edilen bilgilere göre, AB Yapay Zeka Yasası, yapay zekanın yüksek riskli alanlarda kullanılmasından kaynaklanabilecek olası zararları azaltmak ve böylece bireylerin temel haklarını korumak için tasarlanmış yenilikçi bir mevzuattır. Özellikle sağlık, eğitim, sınır gözetimi ve kamu hizmetleri gibi sektörler öncelikli koruma alanları olarak belirlendi. Ayrıca Kanun, "kabul edilemez risk" oluşturan yapay zeka uygulamalarının kullanımını açıkça yasaklamaktadır.

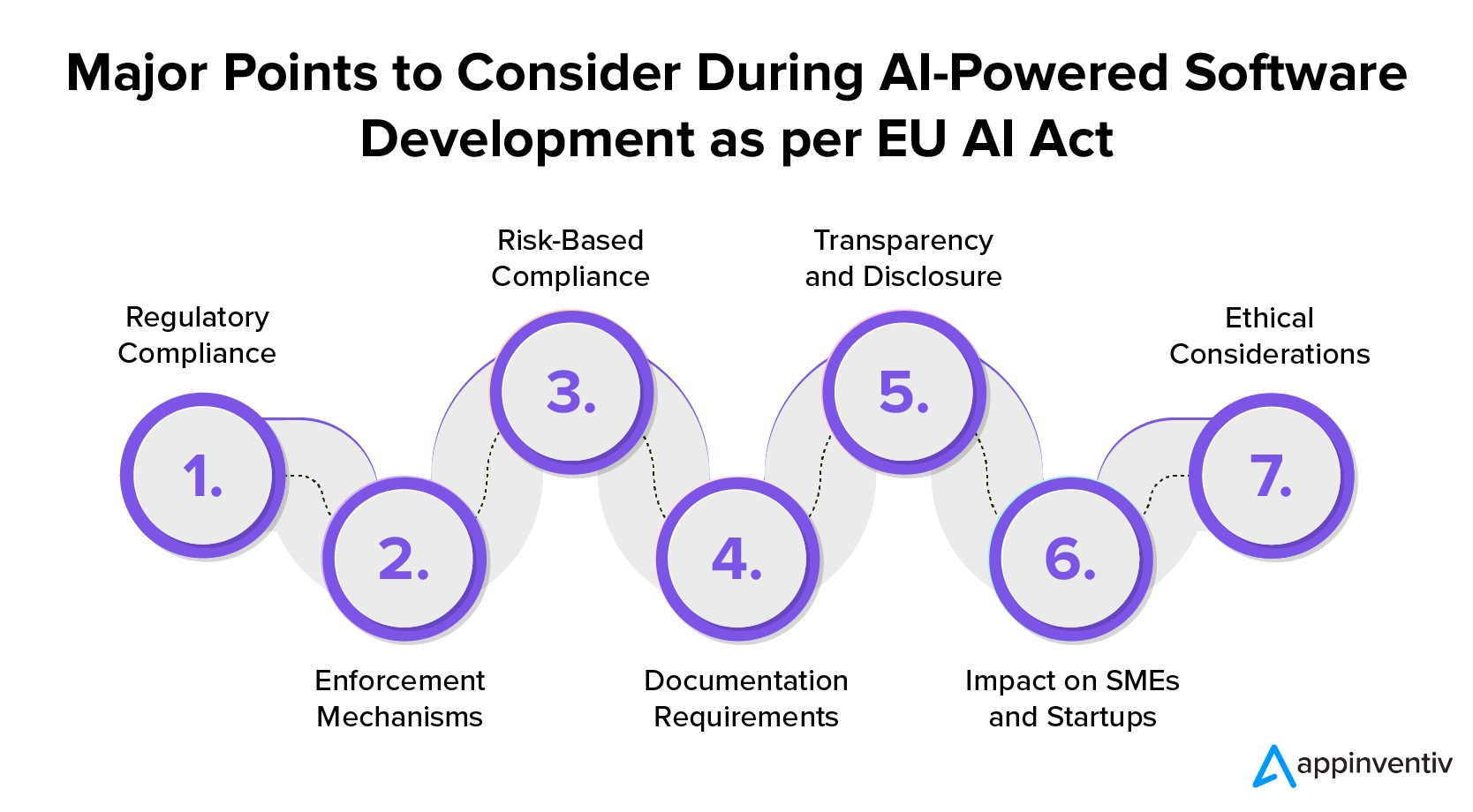

Aralık 2023'te açıklanan AB Yapay Zeka Yasası, Avrupa Birliği'nde yapay zekanın düzenlenmesine yönelik önemli bir adımdır. Yazılım geliştirmede yapay zeka düzenlemesini anlamak isteyen işletmelerin bunun sonuçlarını kavraması ve uyumluluğa hazırlanması gerekir. Yapay zeka uyumlu yazılım geliştirme hizmetlerine yatırım yapmak isteyen işletmelerin dikkate alması gereken önemli noktalar şunlardır:

1. Mevzuata Uygunluk

AB Yapay Zeka Yasası, yapay zeka yazılım geliştiricilerinin sıkı bir şekilde uymasını zorunlu kılıyor ve hem sağlayıcılar hem de kullanıcılar için kesin düzenlemeler getiriyor. Bu düzenlemelere uygunluğu sağlamak için yapay zeka destekli yazılım geliştirmeye yatırım yapmak isteyen işletmelerin, yapay zeka sistemlerini AB pazarına sunarken şeffaflığa ve raporlama standartlarına sıkı sıkıya uyması gerekiyor.

2. Yaptırım Mekanizmaları

Kanun, güçlü bir uygulama mekanizması ve katı bir ceza yapısı içermektedir. Uyumsuzluk, özellikle de ciddi yapay zeka ihlalleri durumunda, küresel yıllık cironun %7'sine kadar para cezalarına yol açabilir. Bu, etik yapay zeka geliştirmenin ve sorumlu dağıtımın önemini vurgulamaktadır.

3. Risk Esaslı Uyumluluk

İşletmeler yapay zeka destekli yazılım geliştirmeyi kullanmayı seçtiklerinde risk değerlendirmeleri yapmaları gerekir. Bunlar, yapay zeka sistemlerinin insan güvenliği ve temel haklar açısından oluşturabilecekleri potansiyel risklere göre sınıflandırılmasına yardımcı olur.

Yapay zeka sistemleri, yüksek risk grupları için daha sıkı gerekliliklerle birlikte "kabul edilemez", "yüksek", "sınırlı" veya "minimum risk" kategorileri altında sınıflandırılacak.

AB'de yapay zeka uyumluluğunu sağlamak için işletmelerin uyumluluk görevlerini ilgili risk düzeyine göre sınıflandırması gerekir. Bu yaklaşım, farklı yapay zeka sistemi türleri için uygun önlemlerin uygulanmasına olanak tanır. İşletmeler potansiyel riskleri azaltmak ve yapay zekanın sorumlu kullanımını sağlamak için bu sürece dahil olmalıdır.

4. Dokümantasyon Gereksinimleri

Yapay zeka tabanlı yazılım geliştiren işletmelerin, sistemleri için güncel teknik dokümantasyon ve kayıt tutmaları gerekmektedir. Bu belgeleme, genel şeffaflık ve düzenleyici standartlara uygunluğun gösterilmesi açısından hayati öneme sahiptir.

5. Şeffaflık ve Açıklama

İşletmeler tarafından işe alınan yazılım geliştiricilerin, yapay zeka sisteminin risk düzeyine bağlı olarak değişen şeffaflık yükümlülüklerine uyması gerekiyor. Yüksek riskli yapay zeka sistemleri için AB veri tabanına kayıt gereklidir. Ayrıca işletmelerin, duygu tanıma veya biyometrik sınıflandırma gibi belirli yapay zeka uygulamaları için kullanıcıları bilgilendirmesi ve onların onayını alması gerekiyor.

6. KOBİ'ler ve Startup'lar Üzerindeki Etki

Küçük işletmeleri desteklemek amacıyla AB Yapay Zeka Yasası, Küçük ve Orta Ölçekli İşletmeler (KOBİ'ler) ve yeni kurulan şirketlere yönelik cezaları sınırlıyor. Bu, yapay zeka işletmelerinin çeşitli doğasını yansıtır ve düzenlemelere uyumu teşvik eder.

7. Etik Hususlar

Çerçeve, işletmelerin yapay zekanın potansiyelinden yararlanma ve risklerini azaltma arasında denge kurmasını gerektiren etik hususları vurguluyor. AB Yapay Zeka Yasası, uyumsuzluğu cezalandırmayı ve yüksek güvenlik standartlarına bağlılığı teşvik etmeyi amaçlamaktadır.

AB Yapay Zeka Düzenleme Çağında Nasıl Başarılı Olunur: Uyumluluğun Sağlanması İçin En İyi Uygulamalar

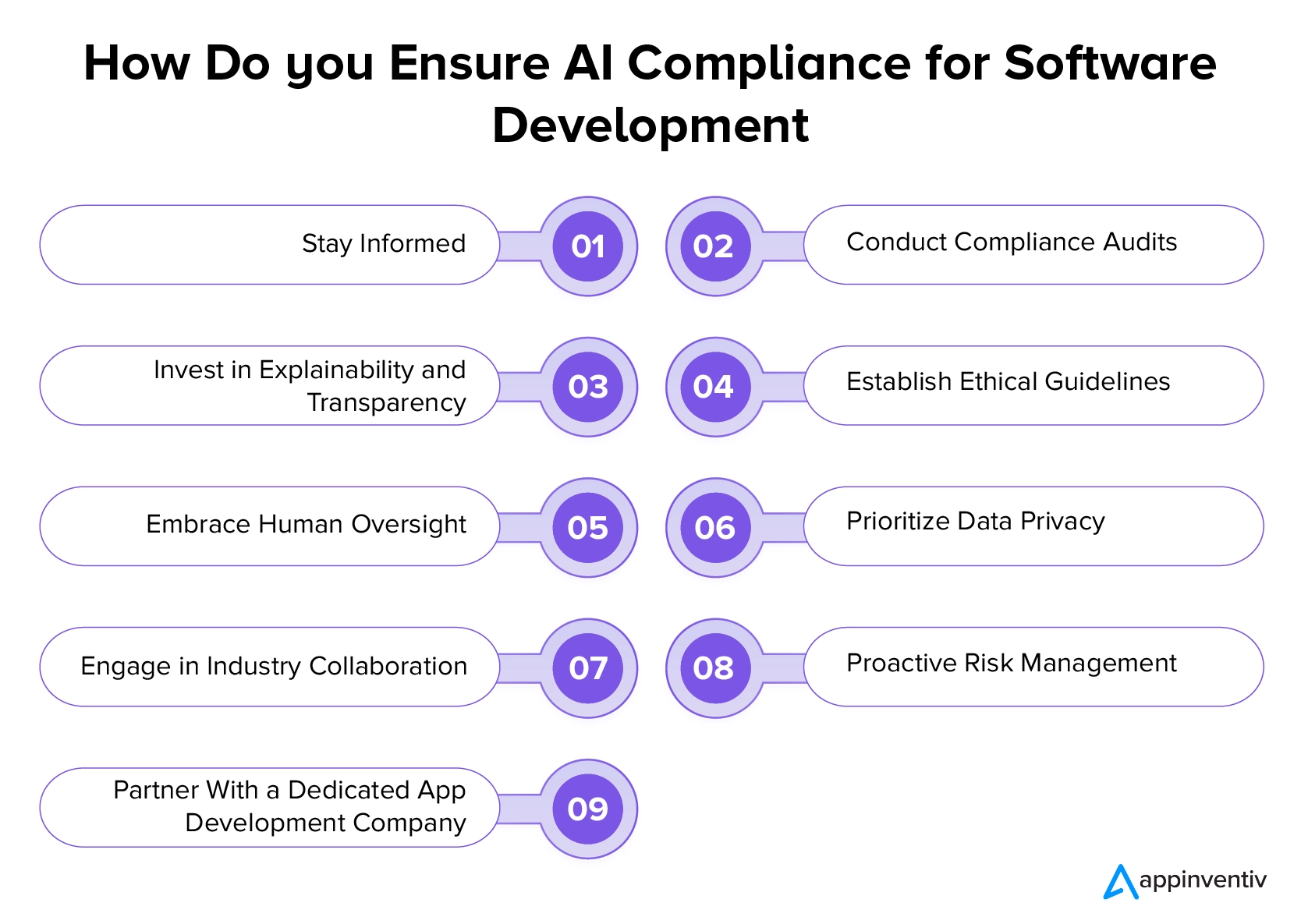

AB Yapay Zeka Yasası ve diğer düzenlemeler, etik, şeffaflık ve kullanıcı refahına öncelik vererek yapay zeka geliştirme ortamını önemli ölçüde değiştiriyor. Bu değişikliklere uyum sağlama olasılığı bazı yapay zeka geliştirme zorluklarına neden olsa da işletmeler, aşağıda belirtilen en iyi uygulamaları takip ederek ve profesyonel bir yazılım geliştirme firmasıyla işbirliği yaparak bu yeni alanda ilerleyebilir.

Haberdar Olun

İşletmeler, değişiklikler ve güncellemeler de dahil olmak üzere yapay zeka düzenlemelerindeki en son gelişmelerden haberdar olmalıdır. Yapay zeka girişimlerini etkileyebilecek herhangi bir değişiklik konusunda farkındalık sağlamak için düzenleyici otoriteleri, resmi yayınları ve sektör güncellemelerini düzenli olarak izlemek çok önemlidir. İşletmeler, yazılım geliştirmede yapay zeka düzenlemesini güncel tutarak stratejilerini proaktif bir şekilde uyarlayabilir ve gelişen düzenlemelere uyumu sağlayabilir.

Uygunluk Denetimleri Gerçekleştirin

İşletmeler, mevcut düzenlemelere uygunluğu sağlamak için yapay zeka sistemlerini ve süreçlerini düzenli olarak denetlemelidir. Yapay zeka algoritmalarının şeffaflığını, adilliğini ve hesap verebilirliğini değerlendirmek önemlidir. Bu, yapay zeka uygulamalarınızla ilişkili olası önyargıların veya risklerin tanımlanmasını ve ele alınmasını içerir. İşletmeler bu denetimleri gerçekleştirerek ortaya çıkabilecek olası yasal veya etik sorunları azaltabilir.

Ayrıca Okuyun: Yapay Zeka Modelinin Çökmesini Önleme: Sentetik Veri Kümelerinin Doğal Riskinin Ele Alınması

Açıklanabilirliğe ve Şeffaflığa Yatırım Yapın

İşletmelere yapay zeka sistemlerinde şeffaflığa ve açıklanabilirliğe öncelik vermeleri tavsiye ediliyor. Yapay zeka algoritmalarının nasıl karar verdiğine dair net iletişim sağlayan çözümler uygulamalıdırlar. Bu, düzenleyici gerekliliklerle uyumludur ve kullanıcılar ile paydaşlar arasında güveni artırır.

Etik Kurallar Oluşturun

İşletmeler yapay zeka projeleri için açık etik kurallar geliştirmeye ve uygulamaya öncelik vermelidir. Bu yönergeler özellikle adalet, mahremiyet ve yapay zekanın daha geniş toplumsal etkisi gibi kritik etik hususları ele almalıdır. Sağlam etik standartlar, sorumlu yapay zeka gelişimini sağlar, kullanıcılar ve paydaşlar arasında güven aşılar ve düzenleyici gerekliliklerle uyum sağlar.

İnsan Gözetimini Benimseyin

İşletmeler, özellikle yüksek riskli uygulamalarda yapay zeka süreçlerinde insan gözetiminin önemini vurgulamalıdır. İnsan incelemesi ve karar alma sürecini entegre etmek, hesap verebilirliği artırmak ve tam otomatik yapay zeka sistemleriyle bağlantılı potansiyel riskleri azaltmak için çok önemlidir.

Veri Gizliliğine Öncelik Verin

İşletmelerin GDPR gibi düzenlemelerle uyumlu sağlam veri gizliliği uygulamalarına uyması gerekir. Yapay zeka destekli yazılım tasarlarken, verileri yapay zeka sistemleri tarafından kullanılan bireylerin gizlilik haklarını korumak için güvenli veri işleme, depolama ve işleme protokollerinin uygulandığından emin olmaları gerekir. Veri gizliliğine yönelik bu taahhüt, yasal gerekliliklere uyumu sağlar ve kullanıcılar arasında güven oluşturur.

Sanayi İşbirliğine Katılın

Yapay zeka uyumlu yazılım geliştirme hizmetlerine yatırım yapmak isteyen işletmeler, yapay zeka düzenlemelerine odaklanan sektör işbirliklerine, forumlara ve tartışmalara aktif olarak katılmalıdır. Meslektaşları ve sektör uzmanlarıyla etkileşim kurarak değerli bilgiler edinebilir ve en iyi geliştirme uygulamalarının geliştirilmesine katkıda bulunabilirler.

Proaktif Risk Yönetimi

İşletmeler, yapay zeka uygulamalarıyla ilişkili potansiyel riskleri belirlemek ve azaltmak için proaktif risk yönetimi stratejileri uygulamalıdır. Düzenli olarak kapsamlı risk değerlendirmeleri yapın ve öngörülemeyen zorlukların üstesinden gelmek için planlar geliştirin.

Özel bir Yazılım Geliştirme Şirketiyle Ortak Olun

AB'deki yeni yapay zeka düzenlemesi ve uyumluluğu uyarınca işletmelerin başarılı olmak için yapabileceği en hayati şeylerden biri, profesyonel yapay zeka geliştirme hizmetleri sunan bir firmayla ortaklık kurmaktır. Kendini işine adamış profesyonellerden rehberlik almak, yapay zeka girişimlerinin yasal çerçeveyle uyumlu olmasını sağlar.

Yapay zeka geliştirme konusunda AB yönergeleri konusunda bilgili olan profesyonel şirketler, işlerine uygun özel tavsiyeler sunarak karmaşık düzenleyici ortamda gezinmelerine ve bununla ilişkili yasal riskleri azaltmalarına yardımcı olabilir.

Kolaylaştırılmış Kalkınma için Yeni AB Yapay Zeka Yasasına Yönelmede Appinventiv Nasıl İdeal Ortağınız Olabilir?

Blogumuzun AB'deki yapay zeka düzenlemeleriyle ilgili incelikleri kavramanızı sağladığını umuyoruz. Tecrübeli yapay zeka geliştiricilerinden oluşan ekibimiz, en son düzenleyici standartlarla uyumlu son teknoloji yapay zeka çözümlerinin oluşturulmasını sağlayarak masaya zengin bir uzmanlık getiriyor. Uygulamalarınızın yalnızca yenilikçi değil, aynı zamanda AB Yapay Zeka Yasası ile tamamen uyumlu olmasını da garanti ederek teknolojinin ön saflarında yer almaya kararlıyız.

Özel bir yapay zeka uygulama geliştirme şirketi olarak, düzenleyici çerçevede belirtilen gereksinimler, şeffaflık yönergeleri ve uyumluluk zaman çizelgeleri konusunda oldukça bilgiliyiz. Bu, yapay zeka projelerinizi katı AB standartlarına göre yönlendirmemize olanak tanır.

Yenilik ve uyumluluğu kusursuz bir şekilde bütünleştiren bir yapay zeka geliştirme yolculuğuna çıkmak için uzmanlarımızla iletişime geçin.

SSS

S. GDPR AB'de yapay zeka gelişimini ve kullanımını nasıl etkiliyor?

C. Genel Veri Koruma Yönetmeliği (GDPR), AB'de yapay zeka gelişimini ve kullanımını önemli ölçüde etkilemektedir. AI uygulamalarında kişisel verilerin korunmasını, şeffaflığın sağlanmasını ve hesap verebilirliğin teşvik edilmesini güçlü bir şekilde vurgulamaktadır. Algoritmik önyargıyla ilgili endişeleri gidermek amacıyla GDPR uyumluluğu, yapay zeka projeleri için Veri Koruma Etki Değerlendirmelerinin (DPIA'lar) uygulanmasını zorunlu kılmaktadır.

S. AB'de sağlık veya finans gibi sektörlere özel yapay zeka düzenlemeleri var mı?

C. AB AI yönetmeliği, yüksek riskli AI sistemlerini düzenlemek için kapsamlı bir çerçeve görevi görmektedir. Ancak belirli sektörlerin, kendilerine özgü zorluklara ve gereksinimlere göre uyarlanmış ek düzenlemeleri olabilir. Örneğin sağlık sektörü, yapay zekanın tıbbi uygulamalarda etik ve sorumlu kullanımını sağlamak için ek düzenlemelere sahip olabilir. Benzer şekilde finans sektörünün, finansal hizmetlerdeki yapay zeka uygulamaları için özel yönergeleri olabilir. İşletmelerin hem AB Yapay Zeka Yasası gibi genel yapay zeka düzenlemelerinden hem de kendi alanları için geçerli olan sektöre özel düzenlemelerden haberdar olması gerekir.

S. CEO'lar ve CTO'lar, AI ürünlerini AB düzenlemelerine uygun olarak geliştirirken hangi hususları dikkate almalıdır?

C. Yapay zekaya ilişkin AB düzenlemelerine uymak için CEO'lar ve CTO'lar öncelikle en son Kanun hakkında bilgi sahibi olmaya öncelik vermelidir. Şeffaflık yönergelerine ve uyumluluk zaman çizelgelerine uyumun sağlanması çok önemlidir. Buna ek olarak, etik kurallar, şeffaflık, insan gözetimi, veri gizliliği uygulamaları, risk yönetimi, hukuki danışmanlık ve sektör işbirliklerine aktif katılım, AB'deki düzenleyici gereklilikleri ve etik standartları karşılayan yapay zeka stratejileri geliştirmek için temel unsurlardır.