Réglementation et conformité de l'IA dans l'UE : cartographier le paysage juridique pour le développement de logiciels

Publié: 2024-02-12L’intelligence artificielle (IA) change rapidement la façon dont notre monde fonctionne, laissant un impact significatif sur divers secteurs. De l'offre de soins de santé personnalisés à l'optimisation de la logistique et des chaînes d'approvisionnement, la technologie a déjà démontré ses capacités dans tous les secteurs.

Sur les marchés européens, le potentiel de l’IA est particulièrement prometteur, car les pays et les entreprises adoptent rapidement le développement de logiciels basés sur l’IA pour stimuler l’innovation, la croissance et le bien-être sociétal.

Cependant, à côté de cet enthousiasme, il reste d’importants défis à relever. Les préoccupations concernant les biais des algorithmes, leur transparence et les suppressions d’emplois potentielles ont soulevé de multiples questions éthiques et sociales qui nécessitent un examen attentif. Il est crucial d’équilibrer l’exploitation de son potentiel et l’atténuation de ses risques pour naviguer efficacement dans le paysage de l’IA.

Notamment, l’Union européenne a récemment modifié la loi sur l’IA, soulignant l’importance de la réglementation européenne en matière d’IA. Pour les entreprises qui cherchent à se lancer sur le marché du développement de logiciels en Europe, la compréhension et le respect de ces réglementations ne sont plus une option mais une partie essentielle de l'activité.

Ce blog vous aidera à comprendre tout ce qui concerne l'intersection de l'intelligence artificielle et du développement de logiciels, en mettant en évidence l'évolution du paysage de la réglementation de l'IA dans l'UE. En plus de cela, nous examinerons également l’importance du respect des normes réglementaires gouvernementales en matière d’IA.

Alors, sans plus attendre, passons aux détails cruciaux.

Importance de la réglementation sur l’IA dans l’UE

L’Union européenne (UE) adopte une position proactive en matière de réglementation et de conformité dans un monde dominé par les logiciels basés sur l’IA. Consciente des avantages et des risques potentiels de cette puissante technologie, l'UE vise à établir un cadre solide soutenu par des pratiques éthiques, la transparence et un déploiement responsable. Comprendre l'importance de la conformité de l'IA dans le développement de logiciels est crucial pour plusieurs raisons :

Construire de la confiance

La conformité de l'IA dans l'UE vise à renforcer la confiance entre les utilisateurs, les entreprises et les parties prenantes en garantissant que les systèmes d'IA sont développés et utilisés de manière éthique. Cette confiance est essentielle à l’adoption généralisée et au développement continu des solutions d’IA.

Atténuer les risques éthiques

Le potentiel de préjugés, de discrimination et d’autres problèmes éthiques augmente à mesure que l’IA s’intègre de plus en plus dans la vie quotidienne. Les réglementations de l'UE visent à atténuer ces risques et à garantir que les systèmes d'IA sont utilisés de manière équitable et responsable.

Conformité et durabilité

L’UE vise à créer un écosystème d’IA durable et responsable en établissant des exigences de conformité claires. Cela aide les entreprises à gérer les risques, à renforcer la cybersécurité et à favoriser la transparence. En fin de compte, comprendre l’importance de la conformité de l’IA aide les entreprises à gérer les problèmes juridiques et favorise le développement et le déploiement responsables de l’IA.

La conformité de l'IA dans l'UE n'est pas seulement une obligation juridique pour les entreprises, mais également un investissement stratégique dans le succès à long terme de l'IA et son impact positif sur la société. En adhérant à la réglementation européenne sur l’IA, les entreprises peuvent contribuer à construire un avenir où leurs solutions basées sur l’IA profiteront à tous de manière éthique et durable.

Pour s’assurer qu’un système d’IA respecte les règles, il doit subir une évaluation de conformité. Une fois réussi, il est enregistré dans la base de données de l'UE et reçoit un marquage CE (conformité européenne) pour montrer qu'il répond aux normes avant d'être autorisé sur le marché. Si des changements importants sont apportés au système, comme le former sur de nouvelles données ou l'ajout/suppression de fonctionnalités, il doit passer par une nouvelle évaluation pour s'assurer qu'il suit toujours les règles avant de pouvoir être à nouveau certifié et réinséré dans la base de données.

Le règlement européen sur l’IA : naviguer dans le paysage réglementaire pour le développement de logiciels basés sur l’IA

L'Union européenne a mis en œuvre plusieurs réglementations clés qui ont un impact significatif sur le domaine de l'intelligence artificielle. La réglementation de l'IA dans le développement de logiciels est conçue pour garantir un développement éthique de l'IA, capable de protéger la vie privée des individus et d'atténuer les risques potentiels. Examinons quelques conformités clés de l'UE pour le développement de l'IA.

1. Règlement Général sur la Protection des Données (RGPD)

Le Règlement général sur la protection des données (RGPD) est un facteur crucial pour façonner le paysage de l’intelligence artificielle dans l’Union européenne. Il se concentre sur la protection des données personnelles et applique des mesures strictes pour garantir la transparence et la responsabilité dans les applications d’IA.

En plus de cela, le RGPD s’attaque également aux biais algorithmiques, en soulignant l’importance de systèmes d’IA équitables et impartiaux. Le règlement nécessite le recours à des évaluations d’impact sur la protection des données (DPIA) pour les projets d’IA, qui évaluent les risques potentiels et les implications en matière de confidentialité. Ce cadre réglementaire complet vise à établir une base solide pour le développement éthique et responsable de l’IA au sein de l’UE.

2. Loi sur l'intelligence artificielle

La loi sur l’intelligence artificielle est un cadre complet qui régit les systèmes d’IA à haut risque. Il décrit les exigences en matière de transparence, d’explicabilité et de surveillance humaine. Cette structure réglementaire vise à promouvoir le développement et le déploiement responsables et explicables de l’IA.

Les entreprises développant des logiciels basés sur l’IA doivent respecter la conformité de l’IA dans le développement de logiciels et ses implications, y compris les délais de conformité et les considérations pratiques. En établissant des critères de transparence et de surveillance, la loi établit un équilibre entre la promotion de l'innovation et la protection des droits fondamentaux. Il ouvre la voie à des pratiques éthiques d’IA dans l’Union européenne.

3. Directive sur la responsabilité du fait des produits

La directive sur la responsabilité du fait des produits est un cadre complet qui donne la priorité à la sécurité des produits d'IA et au bien-être des utilisateurs finaux. Il confie aux développeurs la responsabilité de gérer les risques potentiels associés aux produits d’IA, soulignant la nécessité d’une approche proactive en matière de sécurité des produits.

La directive encourage les développeurs associés au développement de produits à explorer des stratégies de gestion des risques afin d'améliorer les normes globales de sécurité des produits d'IA. En adhérant à ces mesures, les développeurs peuvent contribuer à la création d’un paysage d’IA sécurisé et fiable au sein de l’Union européenne.

En comprenant parfaitement la réglementation de l’IA dans l’UE, les entreprises peuvent naviguer dans le paysage changeant du développement de l’IA, en garantissant la conformité, les pratiques éthiques et le déploiement responsable des technologies d’IA.

Naviguer dans le spectre des risques : comprendre les catégories de risques dans la nouvelle loi européenne sur l’IA

Selon le Parlement européen, l’objectif principal est de garantir la sécurité, la transparence, la traçabilité, la non-discrimination et la durabilité environnementale des systèmes d’IA utilisés au sein de l’UE. Ainsi, ils ont établi des règles différenciées en fonction du niveau de risque associé aux systèmes d’IA. Examinons les multiples catégories en détail ci-dessous :

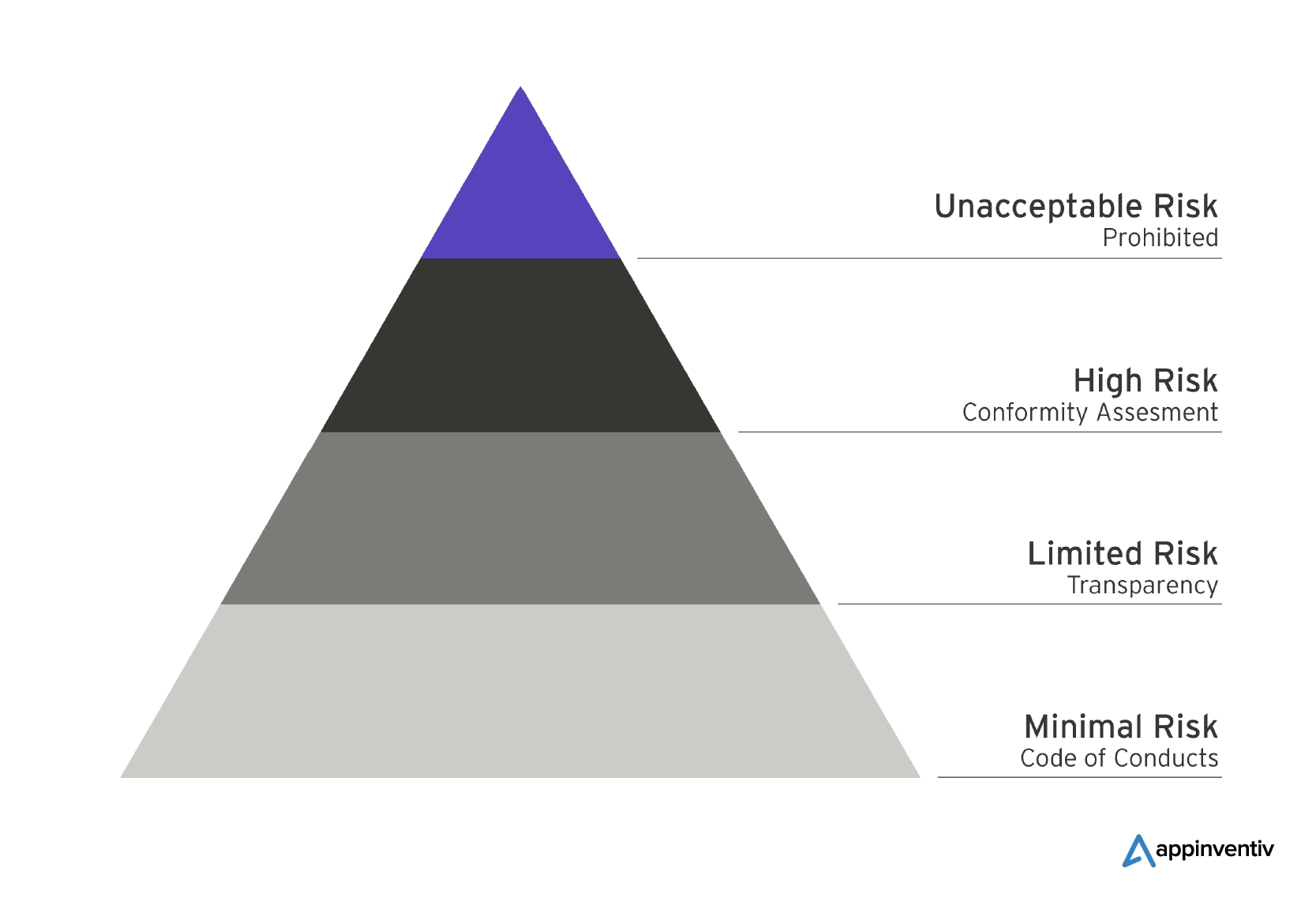

Risque inacceptable : interdire les systèmes d'IA menaçants

Les systèmes d’IA entrant dans la catégorie des risques inacceptables sont considérés comme des menaces directes pour les individus et seront carrément interdits conformément à la nouvelle loi européenne sur l’IA. Par exemple, la manipulation cognitivo-comportementale, la notation sociale et l’identification biométrique sont quelques exemples d’activités entrant dans cette catégorie interdite. Certaines exceptions peuvent être autorisées pour des applications spécifiques des forces de l'ordre, qui seront soumises à des conditions strictes, notamment dans le cas des systèmes d'identification biométrique en temps réel.

Risque élevé : garantir la sécurité et les droits fondamentaux

La catégorie à haut risque définie dans la loi européenne sur l’IA sert de mesure de protection pour garantir la sécurité et la préservation des droits fondamentaux lors du déploiement de l’intelligence artificielle. Cette catégorie englobe les systèmes d’IA susceptibles d’avoir un impact négatif sur la sécurité ou les droits fondamentaux.

Pour plus de clarté, la catégorie à risque élevé est divisée en deux sous-catégories. La première sous-catégorie se concentre sur les systèmes d'IA intégrés dans les produits régis par la législation européenne sur la sécurité des produits, qui comprend un large éventail de secteurs tels que les jouets, l'aviation et les dispositifs médicaux. La deuxième sous-catégorie se concentre sur les systèmes d’IA fonctionnant dans des domaines critiques spécifiques, nécessitant un enregistrement obligatoire dans une base de données de l’UE.

Risque limité : transparence minimale pour des décisions éclairées des utilisateurs

Les systèmes d’IA classés comme à risque limité doivent se conformer à des exigences minimales de transparence permettant aux utilisateurs de prendre des décisions éclairées. Conformément aux contraintes de risque limitées, l'utilisateur doit être averti lorsqu'il interagit avec des applications d'IA, telles que celles générant ou manipulant du contenu image, audio ou vidéo, comme les deepfakes. Les normes de transparence pour l’IA à risque limité visent à trouver un équilibre entre la sensibilisation des utilisateurs et l’utilisation transparente des applications d’IA.

IA à usage général et générative : garantir la transparence

La loi de l’UE sur l’IA établit des lignes directrices claires pour les modèles d’IA à usage général et génératifs afin de garantir la transparence de leurs opérations. Cela inclut des outils comme ChatGPT, qui sont tenus de divulguer que leur contenu est généré par l'IA, d'empêcher la génération de contenu illégal et de publier des résumés des données protégées par le droit d'auteur utilisées pour la formation.

En outre, les modèles d’IA à usage général à fort impact, tels que les modèles avancés comme GPT-4, doivent faire l’objet d’évaluations complètes. En cas d'incidents graves, ces modèles sont tenus de signaler ces événements à la Commission européenne.

Développement de logiciels compatibles avec l'IA – Considérations clés pour les entreprises

Selon les conclusions de l’étude du MIT, la loi européenne sur l’IA est un texte législatif innovant conçu pour atténuer tout préjudice potentiel pouvant résulter de l’utilisation de l’IA dans des zones à haut risque, garantissant ainsi les droits fondamentaux des individus. Plus précisément, des secteurs tels que la santé, l’éducation, la surveillance des frontières et les services publics ont été identifiés comme domaines prioritaires à protéger. En outre, la loi interdit explicitement l’utilisation d’applications d’IA qui présentent un « risque inacceptable ».

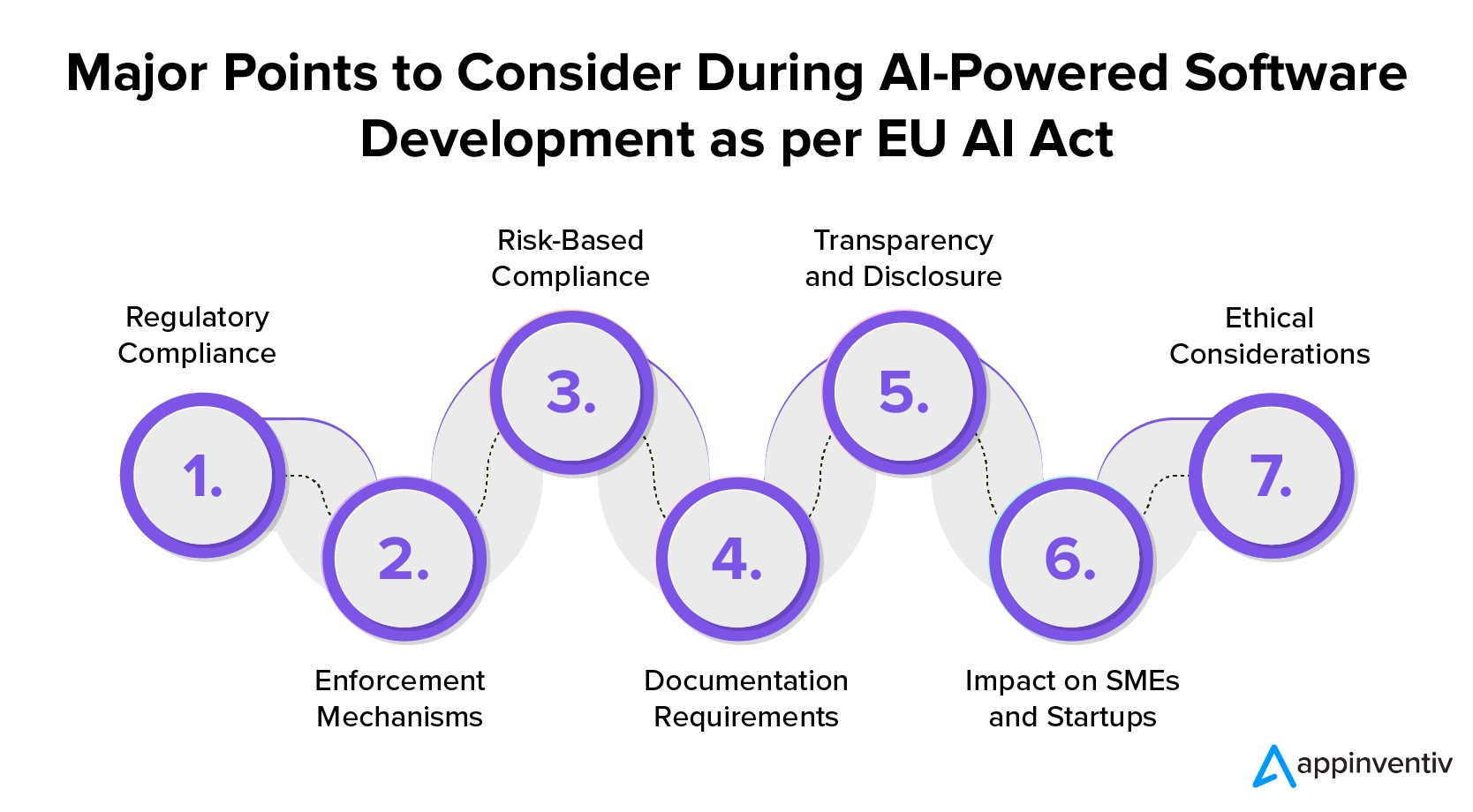

Annoncé en décembre 2023, le EU AI Act constitue une étape cruciale vers la réglementation de l’intelligence artificielle dans l’Union européenne. Les entreprises qui cherchent à comprendre la réglementation de l’IA dans le développement de logiciels doivent en saisir les implications et se préparer à s’y conformer. Voici les points clés que les entreprises souhaitant investir dans des services de développement de logiciels compatibles avec l’IA devraient prendre en compte :

1. Conformité réglementaire

La loi européenne sur l’IA exige une stricte conformité de la part des développeurs de logiciels d’IA, établissant des réglementations précises tant pour les fournisseurs que pour les utilisateurs. Pour garantir le respect de ces réglementations, les entreprises cherchant à investir dans le développement de logiciels basés sur l'IA doivent strictement respecter les normes de transparence et de reporting lors de l'introduction de systèmes d'IA sur le marché de l'UE.

2. Mécanismes d'application

La loi comprend un mécanisme d'application solide et une structure d'amendes stricte. Le non-respect, notamment en cas de violations graves de l’IA, peut entraîner des amendes pouvant aller jusqu’à 7 % du chiffre d’affaires annuel global. Cela souligne l’importance du développement éthique de l’IA et de son déploiement responsable.

3. Conformité basée sur les risques

Lorsque les entreprises choisissent d’utiliser le développement de logiciels basés sur l’IA, elles doivent procéder à des évaluations des risques. Ceux-ci aident à classer les systèmes d’IA en fonction des risques potentiels qu’ils peuvent présenter pour la sécurité humaine et les droits fondamentaux.

Les systèmes d’IA seront classés dans les catégories « inacceptable », « élevé », « limité » ou « risque minimal » avec des exigences plus strictes pour les groupes à risque plus élevé.

Pour garantir la conformité de l’IA dans l’UE, les entreprises doivent catégoriser leurs obligations de conformité en fonction du niveau de risque encouru. Cette approche permet la mise en œuvre de mesures appropriées pour différents types de systèmes d’IA. Les entreprises doivent s’engager dans ce processus pour atténuer les risques potentiels et garantir une utilisation responsable de l’IA.

4. Exigences en matière de documentation

Les entreprises développant des logiciels basés sur l’IA sont tenues de maintenir à jour la documentation et les enregistrements techniques de leurs systèmes. Cette documentation est essentielle pour la transparence globale et pour démontrer le respect des normes réglementaires.

5. Transparence et divulgation

Les développeurs de logiciels embauchés par les entreprises doivent se conformer à des obligations de transparence variables en fonction du niveau de risque du système d'IA. Pour les systèmes d’IA à haut risque, l’enregistrement dans la base de données de l’UE est requis. De plus, les entreprises doivent informer les utilisateurs et obtenir leur consentement pour des applications spécifiques de l’IA, telles que la reconnaissance des émotions ou la catégorisation biométrique.

6. Impact sur les PME et les startups

Pour soutenir les petites entreprises, la loi européenne sur l’IA limite les amendes pour les petites et moyennes entreprises (PME) et les startups. Cela reflète la nature variée des activités d’IA et favorise le respect des réglementations.

7. Considérations éthiques

Le cadre met l'accent sur les considérations éthiques, obligeant les entreprises à équilibrer l'exploitation du potentiel de l'IA et l'atténuation de ses risques. La loi de l’UE sur l’IA vise à pénaliser le non-respect et à encourager le respect de normes de sécurité élevées.

Comment prospérer à l’ère de la réglementation européenne sur l’IA : meilleures pratiques pour garantir la conformité

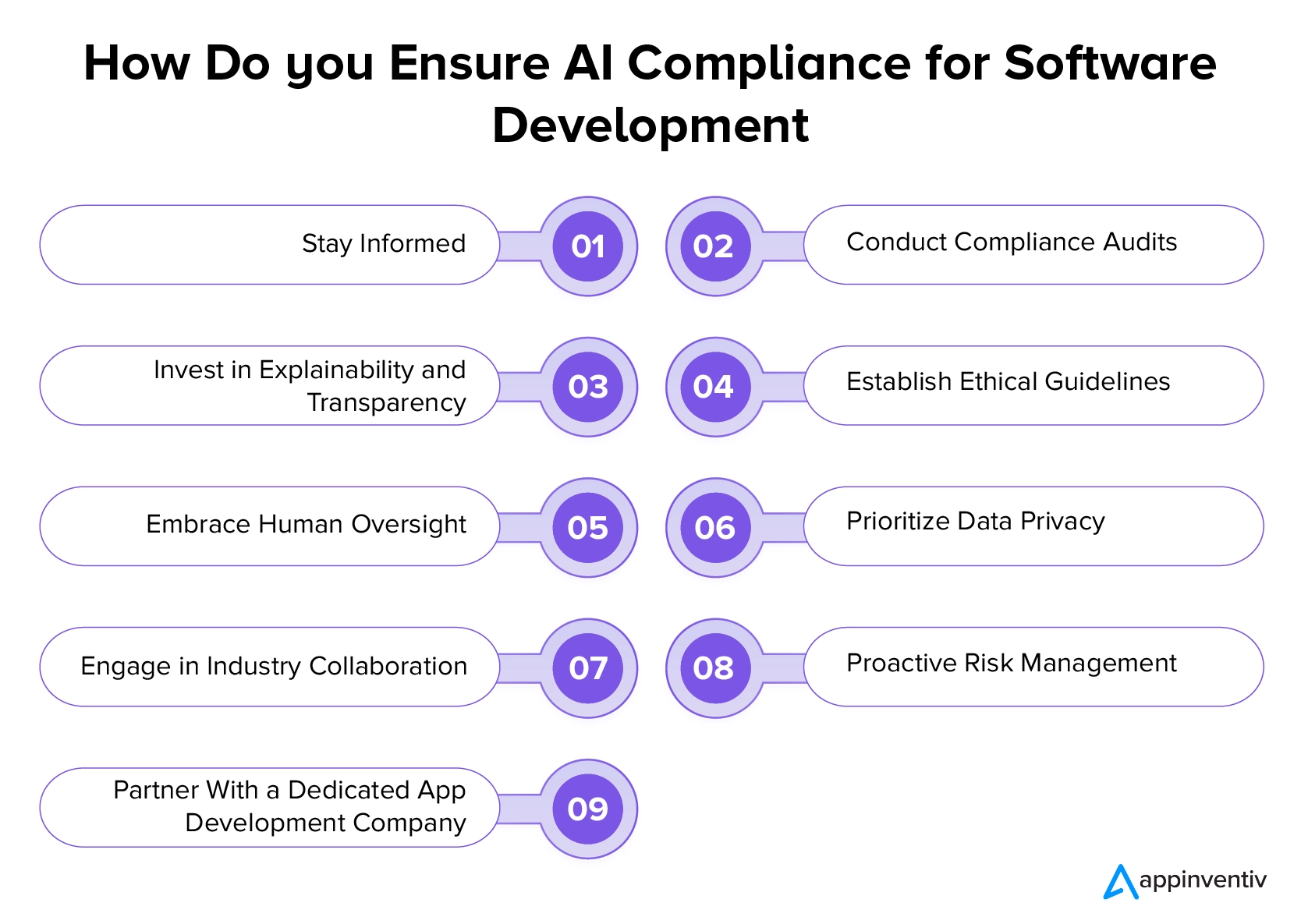

La loi européenne sur l’intelligence artificielle et d’autres réglementations modifient considérablement le paysage du développement de l’IA, en donnant la priorité à l’éthique, à la transparence et au bien-être des utilisateurs. Même si la perspective de s'adapter à ces changements peut entraîner certains défis en matière de développement de l'IA, les entreprises peuvent naviguer sur ce nouveau terrain en suivant les meilleures pratiques mentionnées ci-dessous et en collaborant avec une société de développement de logiciels professionnelle.

Rester informé

Les entreprises doivent rester informées des derniers développements en matière de réglementation sur l’IA, y compris les modifications et mises à jour. Il est essentiel de surveiller régulièrement les autorités réglementaires, les publications officielles et les mises à jour de l’industrie pour garantir la connaissance de tout changement susceptible d’avoir un impact sur les initiatives d’IA. En restant à jour avec la réglementation sur l'IA dans le développement de logiciels, les entreprises peuvent adapter leurs stratégies de manière proactive et garantir la conformité aux réglementations en évolution.

Effectuer des audits de conformité

Les entreprises doivent régulièrement effectuer des audits de leurs systèmes et processus d’IA pour garantir leur conformité aux réglementations en vigueur. Il est important d’évaluer la transparence, l’équité et la responsabilité des algorithmes d’IA. Cela inclut l’identification et la résolution de tout biais ou risque potentiel associé à vos applications d’IA. En effectuant ces audits, les entreprises peuvent atténuer tout problème juridique ou éthique potentiel qui pourrait survenir.

Lisez également : Prévenir l'effondrement des modèles d'IA : gérer le risque inhérent aux ensembles de données synthétiques

Investissez dans l’explicabilité et la transparence

Il est conseillé aux entreprises de donner la priorité à la transparence et à l’explicabilité dans leurs systèmes d’IA. Ils doivent mettre en œuvre des solutions permettant une communication claire sur la manière dont leurs algorithmes d’IA prennent des décisions. Cela est conforme aux exigences réglementaires et favorise la confiance entre les utilisateurs et les parties prenantes.

Établir des lignes directrices éthiques

Les entreprises doivent donner la priorité à l’élaboration et à la mise en œuvre de directives éthiques claires pour leurs projets d’IA. Ces lignes directrices devraient spécifiquement aborder des considérations éthiques cruciales, telles que l’équité, la confidentialité et l’impact sociétal plus large de l’IA. Des normes éthiques solides garantissent un développement responsable de l’IA, inspirent la confiance entre les utilisateurs et les parties prenantes et s’alignent sur les exigences réglementaires.

Adoptez la surveillance humaine

Les entreprises doivent souligner l’importance de la surveillance humaine dans les processus d’IA, en particulier dans les applications à haut risque. L’intégration de l’examen humain et de la prise de décision est essentielle pour renforcer la responsabilité et atténuer les risques potentiels liés aux systèmes d’IA entièrement automatisés.

Donner la priorité à la confidentialité des données

Les entreprises doivent adhérer à des pratiques robustes en matière de confidentialité des données, conformes aux réglementations telles que le RGPD. Lors de la conception de logiciels basés sur l'IA, ils doivent s'assurer de mettre en œuvre des protocoles sécurisés de gestion, de stockage et de traitement des données pour protéger les droits à la vie privée des personnes dont les données sont utilisées par les systèmes d'IA. Cet engagement en faveur de la confidentialité des données garantit le respect des exigences légales et renforce la confiance avec les utilisateurs.

S'engager dans une collaboration industrielle

Les entreprises qui souhaitent investir dans des services de développement de logiciels compatibles avec l’IA devraient participer activement aux collaborations, forums et discussions sectorielles axés sur la réglementation de l’IA. En dialoguant avec leurs pairs et experts du secteur, ils peuvent obtenir des informations précieuses et contribuer au développement des meilleures pratiques de développement.

Gestion proactive des risques

Les entreprises doivent mettre en œuvre des stratégies proactives de gestion des risques pour identifier et atténuer les risques potentiels associés aux applications d’IA. Effectuer régulièrement des évaluations approfondies des risques et élaborer des plans pour relever les défis imprévus.

Associez-vous à une société de développement de logiciels dédiée

L’une des choses les plus essentielles que les entreprises puissent faire pour prospérer conformément à la nouvelle réglementation et à la conformité de l’IA dans l’UE est de s’associer à une entreprise qui propose des services professionnels de développement d’IA. La recherche de conseils auprès de professionnels dévoués garantit que leurs initiatives en matière d’IA s’alignent sur le paysage juridique.

Les entreprises professionnelles qui connaissent bien les lignes directrices de l’UE pour le développement de l’IA peuvent fournir des conseils spécifiques adaptés à leur activité, les aidant à naviguer dans un environnement réglementaire complexe et à atténuer les risques juridiques qui y sont associés.

Comment Appinventiv peut-il être votre partenaire idéal pour naviguer dans la nouvelle loi européenne sur l'IA pour un développement rationalisé ?

Nous espérons que notre blog vous a fait comprendre les subtilités liées à la réglementation de l’IA dans l’UE. Notre équipe de développeurs d’IA chevronnés apporte une richesse d’expertise, garantissant la création de solutions d’IA de pointe conformes aux dernières normes réglementaires. Nous nous engageons à rester à la pointe de la technologie, garantissant que vos applications sont non seulement innovantes mais également pleinement conformes à la loi européenne sur l'IA.

En tant que société dédiée au développement d'applications d'IA, nous connaissons parfaitement les exigences, les directives de transparence et les délais de conformité spécifiés dans le cadre réglementaire. Cela nous permet de guider vos projets d’IA selon les normes strictes de l’UE.

Contactez nos experts pour vous lancer dans un parcours de développement de l’IA qui intègre de manière transparente innovation et conformité.

FAQ

Q. Quel est l'impact du RGPD sur le développement et l'utilisation de l'IA dans l'UE ?

A. Le règlement général sur la protection des données (RGPD) a un impact considérable sur le développement et l'utilisation de l'IA dans l'UE. Il met fortement l’accent sur la protection des données personnelles, la garantie de la transparence et la promotion de la responsabilité dans les applications d’IA. Pour répondre aux préoccupations concernant les biais algorithmiques, la conformité au RGPD impose la mise en œuvre d'évaluations d'impact sur la protection des données (DPIA) pour les projets d'IA.

Q. Existe-t-il des réglementations sectorielles en matière d'IA dans l'UE, comme dans le domaine de la santé ou de la finance ?

A. Le règlement de l’UE sur l’IA sert de cadre complet pour réglementer les systèmes d’IA à haut risque. Cependant, des secteurs spécifiques peuvent avoir des réglementations supplémentaires adaptées à leurs défis et exigences uniques. Par exemple, le secteur de la santé peut avoir des réglementations supplémentaires pour garantir une utilisation éthique et responsable de l’IA dans les applications médicales. De même, le secteur financier peut avoir des lignes directrices spécifiques pour les applications de l’IA dans les services financiers. Les entreprises doivent être conscientes à la fois des réglementations générales sur l’IA, telles que la loi européenne sur l’IA, et de toute réglementation spécifique au secteur qui s’applique à leur domaine.

Q. Quelles considérations les PDG et les CTO devraient-ils prendre en compte lors du développement de produits d'IA conformes aux réglementations de l'UE ?

A. Pour se conformer à la réglementation européenne sur l'IA, les PDG et les CTO doivent d'abord donner la priorité à l'information sur la dernière loi. Il est crucial de garantir l’alignement sur les directives de transparence et les délais de conformité. En plus de cela, les lignes directrices éthiques, la transparence, la surveillance humaine, les pratiques de confidentialité des données, la gestion des risques, la consultation juridique et la participation active aux collaborations industrielles sont autant d’éléments essentiels pour développer des stratégies d’IA qui répondent aux exigences réglementaires et aux normes éthiques de l’UE.