Regulasi dan Kepatuhan AI di UE: Memetakan Lanskap Hukum untuk Pengembangan Perangkat Lunak

Diterbitkan: 2024-02-12Kecerdasan buatan (AI) dengan cepat mengubah cara dunia beroperasi dan meninggalkan dampak yang signifikan pada berbagai sektor. Mulai dari menawarkan layanan kesehatan yang dipersonalisasi hingga mengoptimalkan logistik dan rantai pasokan, teknologi ini telah menunjukkan kemampuannya di semua industri.

Di pasar Eropa, potensi AI sangat menjanjikan, karena negara-negara dan dunia usaha dengan cepat memanfaatkan pengembangan perangkat lunak yang didukung AI untuk mendorong inovasi, pertumbuhan, dan kesejahteraan masyarakat.

Namun, selain kegembiraan tersebut, ada tantangan penting yang harus diatasi. Kekhawatiran mengenai bias algoritma, transparansi, dan potensi perpindahan pekerjaan telah menimbulkan berbagai pertanyaan etika dan sosial yang memerlukan pertimbangan cermat. Penting untuk menyeimbangkan pemanfaatan potensi dan mitigasi risiko agar dapat menavigasi lanskap AI secara efektif.

Khususnya, Uni Eropa baru-baru ini mengubah UU AI, dengan menekankan pentingnya regulasi AI UE. Bagi bisnis yang ingin terjun ke pasar pengembangan perangkat lunak di Eropa, memahami dan mematuhi peraturan ini bukan lagi suatu pilihan tetapi merupakan bagian penting dari bisnis.

Blog ini akan membantu Anda memahami segala sesuatu yang berkaitan dengan titik temu antara kecerdasan buatan dan pengembangan perangkat lunak, serta menyoroti lanskap regulasi AI yang terus berkembang di UE. Selain itu, kami juga akan mendalami pentingnya mematuhi standar peraturan pemerintah tentang AI.

Jadi, tanpa basa-basi lagi, mari kita beralih ke detail penting.

Signifikansi Regulasi AI di UE

Uni Eropa (UE) mengambil sikap proaktif terhadap regulasi dan kepatuhan di dunia yang didominasi oleh perangkat lunak bertenaga AI. Menyadari potensi manfaat dan risiko dari teknologi canggih ini, UE bertujuan untuk membangun kerangka kerja yang kuat yang didukung oleh praktik etis, transparansi, dan penerapan yang bertanggung jawab. Memahami pentingnya kepatuhan AI dalam pengembangan perangkat lunak sangatlah penting karena beberapa alasan:

Membangun kepercayaan

Kepatuhan AI di UE bertujuan untuk membangun kepercayaan di antara pengguna, bisnis, dan pemangku kepentingan dengan memastikan sistem AI dikembangkan dan digunakan secara etis. Kepercayaan ini penting untuk penerapan secara luas dan pengembangan solusi AI yang berkelanjutan.

Mengurangi Risiko Etis

Potensi bias, diskriminasi, dan masalah etika lainnya semakin meningkat seiring dengan semakin terintegrasinya AI ke dalam kehidupan sehari-hari. Peraturan UE memberikan panduan untuk memitigasi risiko-risiko ini dan memastikan sistem AI digunakan secara adil dan bertanggung jawab.

Kepatuhan dan Keberlanjutan

UE bertujuan untuk menciptakan ekosistem AI yang berkelanjutan dan bertanggung jawab dengan menetapkan persyaratan kepatuhan yang jelas. Hal ini membantu dunia usaha mengelola risiko, memperkuat keamanan siber, dan mendorong transparansi. Pada akhirnya, memahami pentingnya kepatuhan AI akan membantu bisnis mengelola masalah hukum dan mendorong pengembangan dan penerapan AI yang bertanggung jawab.

Kepatuhan AI di UE bukan hanya merupakan kewajiban hukum bagi dunia usaha namun juga merupakan investasi strategis dalam keberhasilan jangka panjang AI dan dampak positifnya terhadap masyarakat. Dengan mematuhi peraturan AI di UE, dunia usaha dapat berkontribusi dalam membangun masa depan di mana solusi bertenaga AI mereka dapat memberikan manfaat bagi semua orang secara etis dan berkelanjutan.

Untuk memastikan sistem AI mengikuti aturan, sistem tersebut harus menjalani penilaian kesesuaian. Setelah lolos, produk tersebut akan didaftarkan di database UE dan menerima tanda CE (European Conformity) untuk menunjukkan bahwa produk tersebut memenuhi standar sebelum diizinkan di pasar. Jika ada perubahan besar pada sistem, seperti melatih data baru atau menambah/menghapus fitur, sistem harus melalui penilaian baru untuk memastikan sistem masih mengikuti aturan sebelum dapat disertifikasi kembali dan dimasukkan kembali ke database.

Peraturan AI UE: Menavigasi Lanskap Peraturan untuk Pengembangan Perangkat Lunak yang Didukung AI

Uni Eropa telah menerapkan beberapa peraturan penting yang berdampak signifikan pada bidang kecerdasan buatan. Regulasi AI dalam pengembangan perangkat lunak dirancang untuk memastikan pengembangan AI yang etis dan mampu melindungi privasi individu dan memitigasi potensi risiko. Mari kita periksa beberapa kepatuhan utama UE untuk pengembangan AI.

1. Peraturan Perlindungan Data Umum (GDPR)

Peraturan Perlindungan Data Umum (GDPR) merupakan faktor penting dalam membentuk lanskap kecerdasan buatan di Uni Eropa. Hal ini berfokus pada perlindungan data pribadi dan menerapkan langkah-langkah ketat untuk memastikan transparansi dan akuntabilitas dalam aplikasi AI.

Selain itu, GDPR juga mengatasi bias algoritmik, dengan menekankan pentingnya sistem AI yang adil dan tidak memihak. Peraturan ini mengharuskan penggunaan Penilaian Dampak Perlindungan Data (DPIA) untuk proyek AI, yang mengevaluasi potensi risiko dan implikasi privasi. Kerangka peraturan yang komprehensif ini bertujuan untuk membangun landasan yang kuat bagi pengembangan AI yang etis dan bertanggung jawab di UE.

2. Undang-Undang Kecerdasan Buatan

Undang-Undang Kecerdasan Buatan adalah kerangka komprehensif yang mengatur sistem AI berisiko tinggi. Ini menguraikan persyaratan untuk transparansi, penjelasan, dan pengawasan manusia. Struktur peraturan ini bertujuan untuk mendorong pengembangan dan penerapan AI yang bertanggung jawab dan dapat dijelaskan.

Bisnis yang mengembangkan perangkat lunak bertenaga AI harus mematuhi kepatuhan AI dalam pengembangan perangkat lunak dan implikasinya, termasuk jadwal kepatuhan dan pertimbangan praktis. Dengan menetapkan kriteria transparansi dan pengawasan, UU ini memberikan keseimbangan antara mendorong inovasi dan melindungi hak-hak dasar. Hal ini membuka jalan bagi praktik AI yang etis di Uni Eropa.

3. Petunjuk Tanggung Jawab Produk

Petunjuk Kewajiban Produk adalah kerangka kerja komprehensif yang memprioritaskan keamanan produk AI dan kesejahteraan pengguna akhir. Hal ini memberikan tanggung jawab kepada pengembang untuk mengelola potensi risiko yang terkait dengan produk AI, dan menekankan perlunya pendekatan proaktif terhadap keamanan produk.

Arahan ini mendorong pengembang yang terkait dengan pengembangan produk untuk mengeksplorasi strategi manajemen risiko guna meningkatkan standar keselamatan produk AI secara keseluruhan. Dengan mematuhi langkah-langkah ini, pengembang dapat berkontribusi terhadap penciptaan lanskap AI yang aman dan andal di Uni Eropa.

Dengan memahami regulasi AI di UE secara komprehensif, dunia usaha dapat menavigasi lanskap pengembangan AI yang terus berkembang, memastikan kepatuhan, praktik etika, dan penerapan teknologi AI yang bertanggung jawab.

Menavigasi Spektrum Risiko: Memahami Kategori Risiko dalam Undang-Undang AI UE yang Baru

Menurut Parlemen Eropa, tujuan utamanya adalah untuk memastikan keamanan, transparansi, ketertelusuran, non-diskriminasi, dan kelestarian lingkungan dari sistem AI yang digunakan di UE. Oleh karena itu, mereka telah menetapkan aturan yang berbeda berdasarkan tingkat risiko yang terkait dengan sistem AI. Mari kita lihat beberapa kategori secara detail di bawah ini:

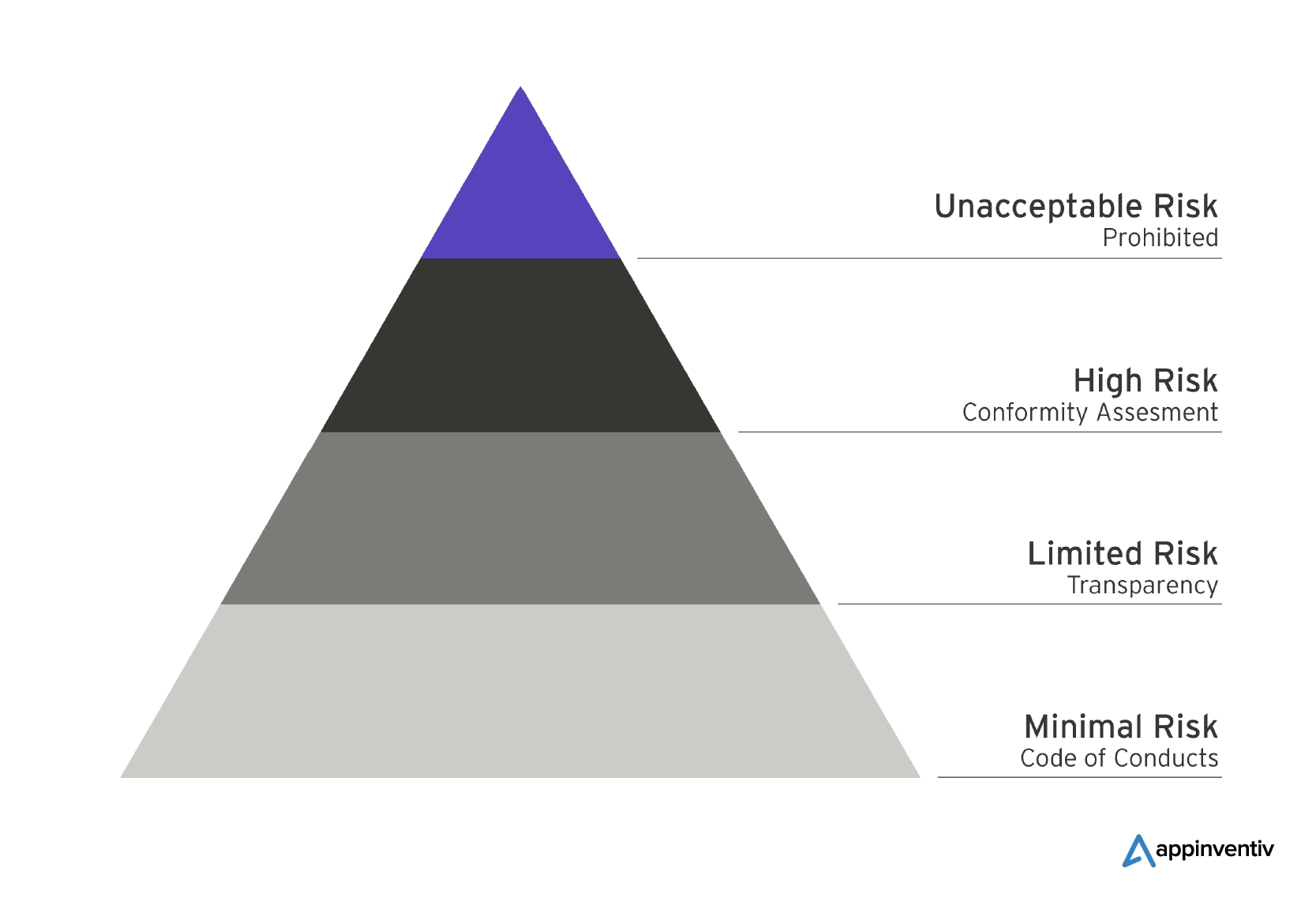

Risiko yang Tidak Dapat Diterima: Melarang Sistem AI yang Mengancam

Sistem AI yang termasuk dalam kategori risiko yang tidak dapat diterima dianggap sebagai ancaman langsung terhadap individu dan akan dilarang secara langsung sesuai dengan Undang-Undang AI UE yang baru. Misalnya saja manipulasi perilaku kognitif, penilaian sosial, dan identifikasi biometrik adalah beberapa contoh aktivitas yang termasuk dalam kategori terlarang ini. Beberapa pengecualian mungkin diperbolehkan untuk aplikasi penegakan hukum tertentu, yang akan tunduk pada persyaratan yang ketat, khususnya dalam kasus sistem identifikasi biometrik real-time.

Risiko Tinggi: Menjaga Keamanan dan Hak-Hak Dasar

Kategori risiko tinggi yang diuraikan dalam UU AI UE berfungsi sebagai tindakan perlindungan untuk memastikan keselamatan dan pelestarian hak-hak dasar ketika menerapkan kecerdasan buatan. Kategori ini mencakup sistem AI yang berpotensi berdampak negatif terhadap keselamatan atau hak-hak dasar.

Untuk lebih memperjelas, kategori risiko tinggi dibagi menjadi dua subkategori. Subkategori pertama berfokus pada sistem AI yang diintegrasikan ke dalam produk yang diatur oleh undang-undang keamanan produk UE, yang mencakup berbagai sektor seperti mainan, penerbangan, dan perangkat medis. Subkategori kedua berfokus pada sistem AI yang beroperasi di area kritis tertentu, sehingga memerlukan registrasi wajib di database UE.

Risiko Terbatas: Transparansi Minimal untuk Keputusan Pengguna yang Terinformasi

Sistem AI yang dikategorikan sebagai risiko terbatas harus mematuhi persyaratan transparansi minimal yang memungkinkan pengguna membuat keputusan yang tepat. Sesuai dengan batasan risiko yang terbatas, pengguna harus diberi tahu saat berinteraksi dengan aplikasi AI, seperti aplikasi yang menghasilkan atau memanipulasi konten gambar, audio, atau video, seperti deepfake. Standar transparansi untuk AI dengan risiko terbatas berfokus pada keseimbangan antara kesadaran pengguna dan penggunaan aplikasi AI yang lancar.

Tujuan Umum dan AI Generatif: Memastikan Transparansi

Undang-Undang AI UE menetapkan pedoman yang jelas untuk model AI tujuan umum dan generatif guna memastikan transparansi dalam operasi mereka. Hal ini mencakup alat seperti ChatGPT, yang diwajibkan untuk mengungkapkan bahwa konten mereka dibuat oleh AI, mencegah pembuatan konten ilegal, dan mempublikasikan ringkasan data berhak cipta yang digunakan untuk pelatihan.

Selain itu, model AI dengan tujuan umum yang berdampak tinggi, seperti model canggih seperti GPT-4, harus menjalani evaluasi komprehensif. Jika terjadi insiden serius, model ini wajib melaporkan kejadian tersebut ke Komisi Eropa.

Pengembangan Perangkat Lunak yang Sesuai dengan AI – Pertimbangan Utama untuk Bisnis

Berdasarkan wawasan dari tinjauan MIT, UU AI UE merupakan undang-undang inovatif yang dirancang untuk memitigasi potensi kerugian yang mungkin timbul akibat penggunaan AI di area berisiko tinggi, sehingga melindungi hak-hak dasar setiap individu. Secara khusus, sektor-sektor seperti layanan kesehatan, pendidikan, pengawasan perbatasan, dan layanan publik telah diidentifikasi sebagai bidang prioritas untuk dilindungi. Selain itu, undang-undang tersebut secara eksplisit melarang penggunaan aplikasi AI yang menimbulkan “risiko yang tidak dapat diterima.”

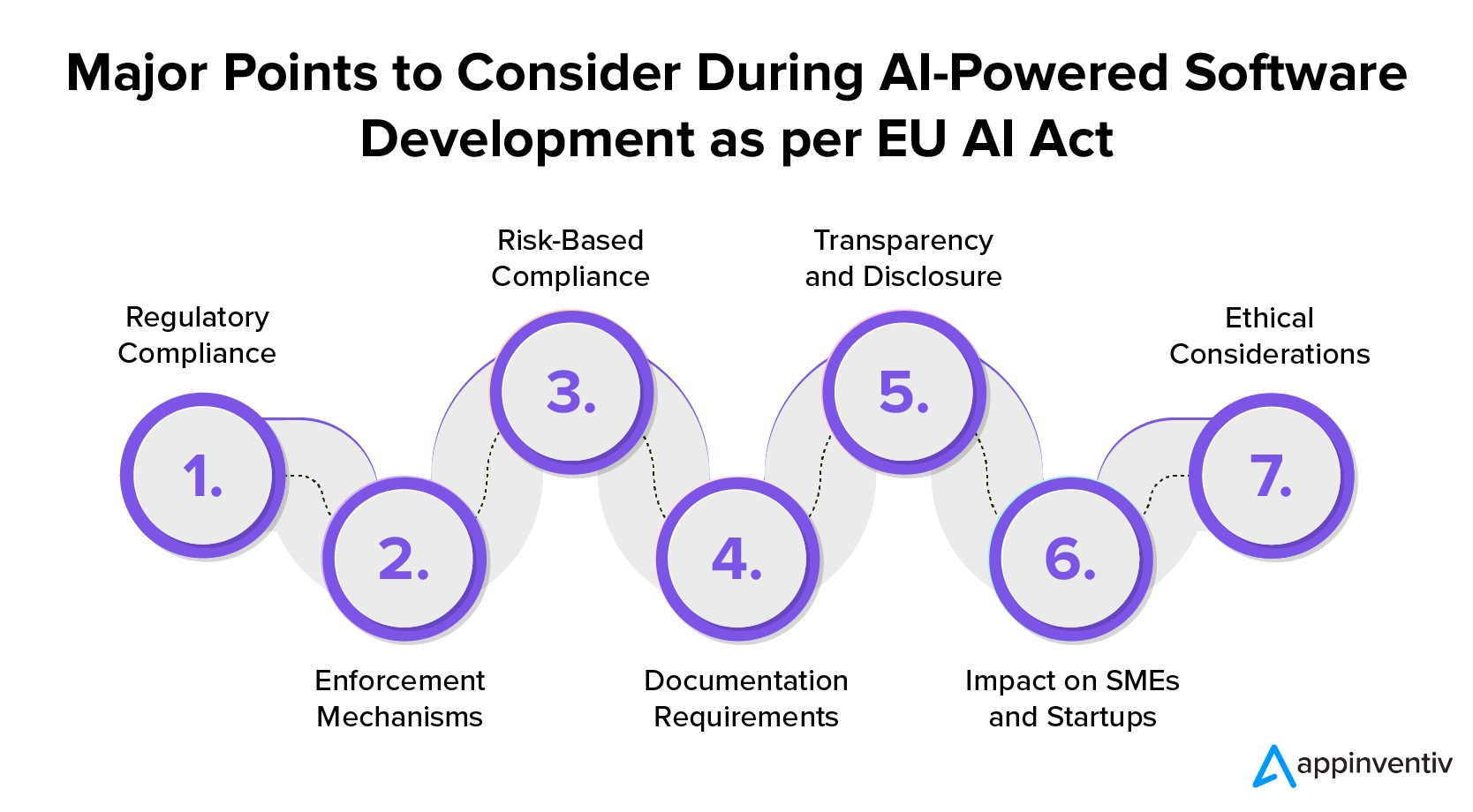

Diumumkan pada bulan Desember 2023, Undang-Undang AI UE merupakan langkah penting dalam mengatur kecerdasan buatan di Uni Eropa. Perusahaan yang ingin memahami regulasi AI dalam pengembangan perangkat lunak harus memahami implikasinya dan bersiap untuk mematuhinya. Berikut adalah poin-poin penting yang harus dipertimbangkan oleh bisnis yang ingin berinvestasi dalam layanan pengembangan perangkat lunak yang sesuai dengan AI:

1. Kepatuhan terhadap Peraturan

Undang-undang AI UE mewajibkan kepatuhan yang ketat dari pengembang perangkat lunak AI, yang menetapkan peraturan yang tepat bagi penyedia dan pengguna. Untuk memastikan kepatuhan terhadap peraturan ini, perusahaan yang ingin berinvestasi dalam pengembangan perangkat lunak bertenaga AI harus benar-benar mematuhi standar transparansi dan pelaporan saat memperkenalkan sistem AI ke pasar UE.

2. Mekanisme Penegakan

Undang-undang ini mencakup mekanisme penegakan hukum yang kuat dan struktur denda yang ketat. Ketidakpatuhan, khususnya dalam kasus pelanggaran AI yang serius, dapat mengakibatkan denda hingga 7% dari omzet tahunan global. Hal ini menyoroti pentingnya pengembangan AI yang etis dan penerapan yang bertanggung jawab.

3. Kepatuhan Berbasis Risiko

Ketika bisnis memilih untuk memanfaatkan pengembangan perangkat lunak yang didukung AI, mereka harus melakukan penilaian risiko. Hal ini membantu dalam mengklasifikasikan sistem AI berdasarkan potensi risiko yang mungkin ditimbulkannya terhadap keselamatan manusia dan hak-hak dasar.

Sistem AI akan dikategorikan dalam kategori “tidak dapat diterima”, “tinggi”, “terbatas”, atau “risiko minimal” dengan persyaratan yang lebih ketat untuk kelompok berisiko tinggi.

Untuk memastikan kepatuhan AI di UE, dunia usaha harus mengkategorikan tugas kepatuhan mereka berdasarkan tingkat risiko yang ada. Pendekatan ini memungkinkan penerapan langkah-langkah yang tepat untuk berbagai jenis sistem AI. Dunia usaha harus terlibat dalam proses ini untuk memitigasi potensi risiko dan memastikan penggunaan AI secara bertanggung jawab.

4. Persyaratan Dokumentasi

Bisnis yang mengembangkan perangkat lunak berbasis AI diharuskan untuk memelihara dokumentasi dan catatan teknis terkini untuk sistem mereka. Dokumentasi ini sangat penting untuk transparansi secara keseluruhan dan untuk menunjukkan kepatuhan terhadap standar peraturan.

5. Transparansi dan Keterbukaan

Pengembang perangkat lunak yang dipekerjakan oleh perusahaan harus mematuhi berbagai kewajiban transparansi tergantung pada tingkat risiko sistem AI. Untuk sistem AI berisiko tinggi, pendaftaran di database UE diperlukan. Selain itu, bisnis harus memberi tahu pengguna dan mendapatkan persetujuan mereka untuk aplikasi AI tertentu, seperti pengenalan emosi atau kategorisasi biometrik.

6. Dampak terhadap UKM dan Startup

Untuk mendukung usaha kecil, UU AI UE membatasi denda bagi Usaha Kecil dan Menengah (UKM) dan perusahaan rintisan. Hal ini mencerminkan beragamnya sifat bisnis AI dan mendorong kepatuhan terhadap peraturan.

7. Pertimbangan Etis

Kerangka kerja ini menekankan pertimbangan etis, yang mengharuskan dunia usaha untuk menyeimbangkan antara memanfaatkan potensi AI dan memitigasi risikonya. Undang-undang AI UE bertujuan untuk menghukum ketidakpatuhan dan mendorong kepatuhan terhadap standar keselamatan yang tinggi.

Cara Berkembang di Era Regulasi AI UE: Praktik Terbaik untuk Memastikan Kepatuhan

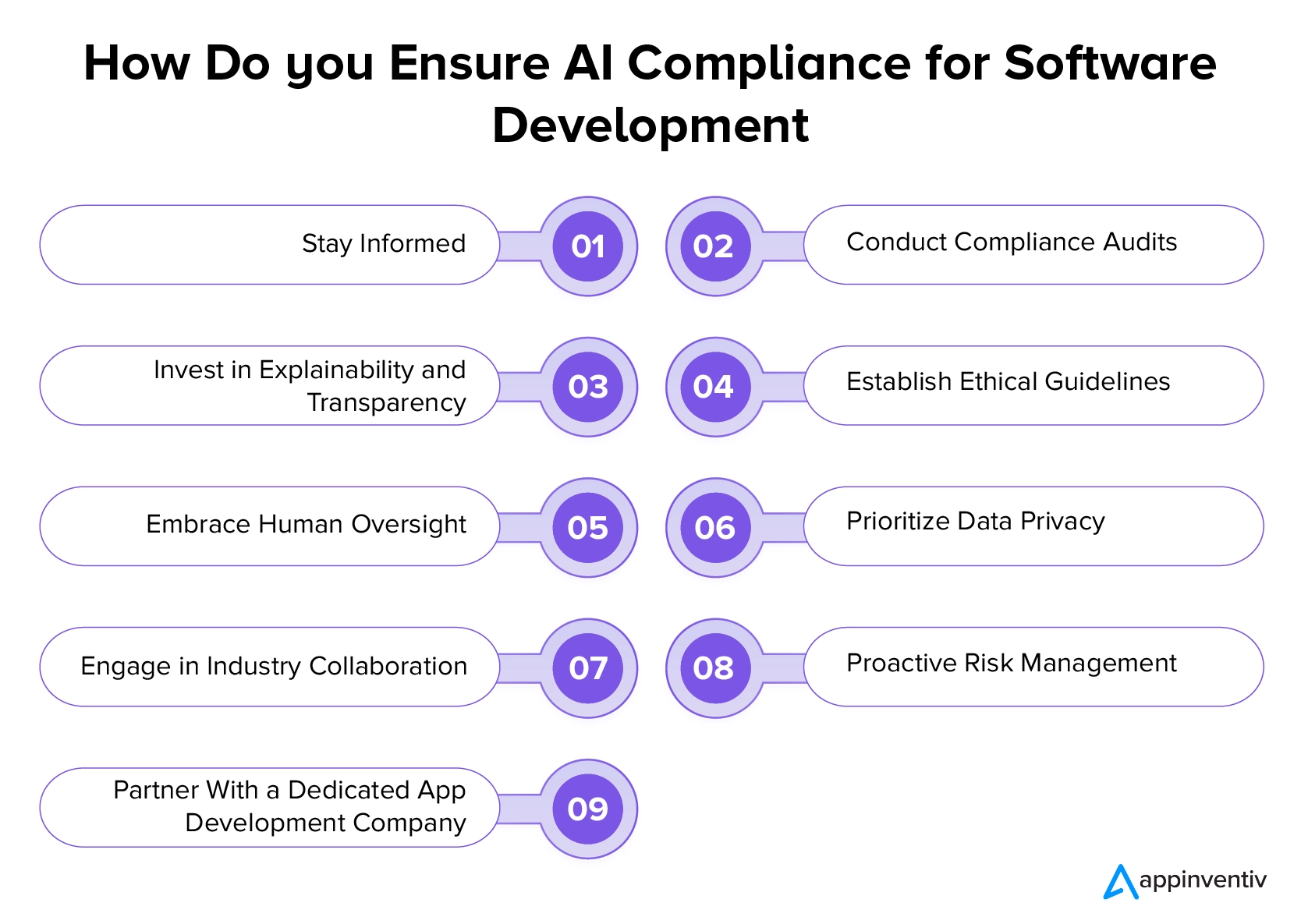

Undang-Undang Kecerdasan Buatan UE dan peraturan lainnya secara signifikan mengubah lanskap pengembangan AI, dengan memprioritaskan etika, transparansi, dan kesejahteraan pengguna. Meskipun prospek adaptasi terhadap perubahan ini mungkin menimbulkan beberapa tantangan pengembangan AI, dunia usaha dapat menavigasi medan baru ini dengan mengikuti praktik terbaik yang disebutkan di bawah dan berkolaborasi dengan perusahaan pengembangan perangkat lunak profesional.

Tetap Terinformasi

Dunia usaha harus selalu mendapat informasi tentang perkembangan terkini peraturan AI, termasuk amandemen dan pembaruannya. Sangat penting untuk memantau secara rutin otoritas pengatur, publikasi resmi, dan pembaruan industri untuk memastikan kesadaran akan setiap perubahan yang dapat berdampak pada inisiatif AI. Dengan selalu mengikuti perkembangan peraturan AI dalam pengembangan perangkat lunak, bisnis dapat secara proaktif menyesuaikan strategi mereka dan memastikan kepatuhan terhadap peraturan yang terus berkembang.

Melakukan Audit Kepatuhan

Bisnis harus secara rutin melakukan audit terhadap sistem dan proses AI mereka untuk memastikan kepatuhan terhadap peraturan yang ada. Penting untuk menilai transparansi, keadilan, dan akuntabilitas algoritma AI. Hal ini termasuk mengidentifikasi dan mengatasi potensi bias atau risiko yang terkait dengan aplikasi AI Anda. Dengan melakukan audit ini, bisnis dapat memitigasi potensi masalah hukum atau etika yang mungkin timbul.

Baca Juga: Mencegah Keruntuhan Model AI: Mengatasi Risiko Inheren Kumpulan Data Sintetis

Berinvestasi dalam Penjelasan dan Transparansi

Dunia usaha disarankan untuk memprioritaskan transparansi dan penjelasan dalam sistem AI mereka. Mereka harus menerapkan solusi yang memungkinkan komunikasi yang jelas tentang bagaimana algoritma AI mereka mengambil keputusan. Hal ini sejalan dengan persyaratan peraturan dan menumbuhkan kepercayaan di antara pengguna dan pemangku kepentingan.

Menetapkan Pedoman Etika

Dunia usaha harus memprioritaskan pengembangan dan penerapan pedoman etika yang jelas untuk proyek AI mereka. Pedoman ini harus secara khusus membahas pertimbangan etika yang penting, seperti keadilan, privasi, dan dampak sosial yang lebih luas dari AI. Standar etika yang kuat memastikan pengembangan AI yang bertanggung jawab, menanamkan kepercayaan di antara pengguna dan pemangku kepentingan, dan selaras dengan persyaratan peraturan.

Rangkullah Pengawasan Manusia

Dunia usaha harus menekankan pentingnya pengawasan manusia dalam proses AI, khususnya dalam aplikasi berisiko tinggi. Mengintegrasikan tinjauan manusia dan pengambilan keputusan sangat penting untuk meningkatkan akuntabilitas dan memitigasi potensi risiko yang terkait dengan sistem AI yang sepenuhnya otomatis.

Prioritaskan Privasi Data

Bisnis harus mematuhi praktik privasi data yang ketat dan selaras dengan peraturan seperti GDPR. Saat merancang perangkat lunak yang didukung AI, mereka harus memastikan penerapan protokol penanganan, penyimpanan, dan pemrosesan data yang aman untuk menjaga hak privasi individu yang datanya digunakan oleh sistem AI. Komitmen terhadap privasi data ini memastikan kepatuhan terhadap persyaratan hukum dan membangun kepercayaan dengan pengguna.

Terlibat dalam Kolaborasi Industri

Dunia usaha yang ingin berinvestasi pada layanan pengembangan perangkat lunak yang sesuai dengan AI harus berpartisipasi aktif dalam kolaborasi industri, forum, dan diskusi yang berfokus pada regulasi AI. Dengan melibatkan rekan-rekan dan pakar industri, mereka dapat memperoleh wawasan berharga dan berkontribusi terhadap pengembangan praktik pembangunan terbaik.

Manajemen Risiko Proaktif

Dunia usaha harus menerapkan strategi manajemen risiko yang proaktif untuk mengidentifikasi dan memitigasi potensi risiko yang terkait dengan penerapan AI. Secara teratur melakukan penilaian risiko menyeluruh dan mengembangkan rencana untuk mengatasi tantangan yang tidak terduga.

Bermitra dengan Perusahaan Pengembangan Perangkat Lunak Khusus

Salah satu hal terpenting yang dapat dilakukan bisnis untuk berkembang sesuai dengan peraturan dan kepatuhan AI yang baru di UE adalah bermitra dengan perusahaan yang menawarkan layanan pengembangan AI profesional. Mencari bimbingan dari para profesional yang berdedikasi memastikan bahwa inisiatif AI mereka selaras dengan lanskap hukum.

Perusahaan profesional yang berpengalaman dalam pedoman UE untuk pengembangan AI dapat memberikan saran khusus yang disesuaikan dengan bisnis mereka, membantu mereka menavigasi lingkungan peraturan yang kompleks dan memitigasi risiko hukum yang terkait dengannya.

Bagaimana Appinventiv Dapat Menjadi Mitra Ideal Anda dalam Menavigasi Undang-Undang AI UE yang Baru untuk Pembangunan yang Efisien?

Kami berharap blog kami dapat membantu Anda memahami seluk-beluk regulasi AI di UE. Tim pengembang AI kami yang berpengalaman menghadirkan segudang keahlian, memastikan terciptanya solusi AI mutakhir yang selaras dengan standar peraturan terbaru. Kami berkomitmen untuk tetap menjadi yang terdepan dalam teknologi, menjamin bahwa aplikasi Anda tidak hanya inovatif tetapi juga sepenuhnya mematuhi EU AI Act.

Sebagai perusahaan pengembang aplikasi AI yang berdedikasi, kami sangat memahami persyaratan, pedoman transparansi, dan jadwal kepatuhan yang ditentukan dalam kerangka peraturan. Hal ini memungkinkan kami memandu proyek AI Anda sesuai dengan standar UE yang ketat.

Hubungi para ahli kami untuk memulai perjalanan pengembangan AI yang mengintegrasikan inovasi dan kepatuhan dengan lancar.

FAQ

T. Bagaimana pengaruh GDPR terhadap pengembangan dan penggunaan AI di UE?

A. Peraturan Perlindungan Data Umum (GDPR) berdampak besar pada pengembangan dan penggunaan AI di UE. Hal ini sangat menekankan pada perlindungan data pribadi, memastikan transparansi, dan mendorong akuntabilitas dalam aplikasi AI. Untuk mengatasi kekhawatiran mengenai bias algoritmik, kepatuhan GDPR mengamanatkan penerapan Penilaian Dampak Perlindungan Data (DPIA) untuk proyek AI.

T. Apakah ada peraturan AI yang spesifik pada sektor tertentu di UE, misalnya di bidang kesehatan atau keuangan?

A. Peraturan AI UE berfungsi sebagai kerangka komprehensif untuk mengatur sistem AI yang berisiko tinggi. Namun, sektor-sektor tertentu mungkin memiliki peraturan tambahan yang disesuaikan dengan tantangan dan kebutuhan unik mereka. Misalnya, industri perawatan kesehatan mungkin memiliki peraturan tambahan untuk memastikan penggunaan AI yang etis dan bertanggung jawab dalam aplikasi medis. Demikian pula, sektor keuangan mungkin memiliki pedoman khusus untuk penerapan AI dalam jasa keuangan. Dunia usaha harus menyadari peraturan umum AI, seperti EU AI Act, dan peraturan khusus sektor apa pun yang berlaku di domain mereka.

T. Pertimbangan apa yang harus dipertimbangkan oleh CEO dan CTO ketika mengembangkan produk AI sesuai dengan peraturan UE?

A. Untuk mematuhi peraturan UE mengenai AI, CEO dan CTO harus terlebih dahulu memprioritaskan untuk selalu mendapatkan informasi tentang Undang-undang terbaru. Penting untuk memastikan keselarasan dengan pedoman transparansi dan jadwal kepatuhan. Selain itu, pedoman etika, transparansi, pengawasan manusia, praktik privasi data, manajemen risiko, konsultasi hukum, dan partisipasi aktif dalam kolaborasi industri merupakan elemen penting untuk mengembangkan strategi AI yang memenuhi persyaratan peraturan dan standar etika di UE.