กฎระเบียบและการปฏิบัติตามข้อกำหนดของ AI ในสหภาพยุโรป: การสร้างแผนผังภูมิทัศน์ทางกฎหมายสำหรับการพัฒนาซอฟต์แวร์

เผยแพร่แล้ว: 2024-02-12ปัญญาประดิษฐ์ (AI) กำลังเปลี่ยนแปลงวิธีการดำเนินงานของโลกอย่างรวดเร็ว ทำให้เกิดผลกระทบอย่างมีนัยสำคัญต่อภาคส่วนต่างๆ ตั้งแต่การนำเสนอการดูแลสุขภาพเฉพาะบุคคลไปจนถึงการเพิ่มประสิทธิภาพลอจิสติกส์และห่วงโซ่อุปทาน เทคโนโลยีนี้ได้แสดงความสามารถของตนในทุกอุตสาหกรรมแล้ว

เมื่อมาถึงตลาดยุโรป ศักยภาพของ AI มีแนวโน้มที่ดีเป็นพิเศษ เนื่องจากประเทศและธุรกิจต่างๆ ต่างเปิดรับการพัฒนาซอฟต์แวร์ที่ขับเคลื่อนด้วย AI อย่างรวดเร็ว เพื่อขับเคลื่อนนวัตกรรม การเติบโต และความเป็นอยู่ที่ดีของสังคม

อย่างไรก็ตาม นอกจากความตื่นเต้นแล้ว ยังมีความท้าทายที่สำคัญที่ต้องจัดการอีกด้วย ความกังวลเกี่ยวกับอคติของอัลกอริธึม ความโปร่งใส และโอกาสในการเปลี่ยนงาน ทำให้เกิดคำถามด้านจริยธรรมและสังคมหลายประการที่ต้องพิจารณาอย่างรอบคอบ สิ่งสำคัญคือต้องสร้างสมดุลระหว่างการควบคุมศักยภาพและการลดความเสี่ยงเพื่อนำทางภูมิทัศน์ AI อย่างมีประสิทธิภาพ

โดยเฉพาะอย่างยิ่งสหภาพยุโรปได้เปลี่ยนแปลงพระราชบัญญัติ AI เมื่อเร็วๆ นี้ โดยเน้นย้ำถึงความสำคัญของกฎระเบียบด้าน AI ของสหภาพยุโรป สำหรับธุรกิจที่ต้องการเจาะลึกตลาดการพัฒนาซอฟต์แวร์ในยุโรป การทำความเข้าใจและการปฏิบัติตามกฎระเบียบเหล่านี้ไม่ใช่ทางเลือกอีกต่อไป แต่เป็นส่วนสำคัญของธุรกิจ

บล็อกนี้จะช่วยให้คุณเข้าใจทุกสิ่งที่เกี่ยวข้องกับจุดบรรจบของปัญญาประดิษฐ์และการพัฒนาซอฟต์แวร์ โดยเน้นที่ภูมิทัศน์ที่เปลี่ยนแปลงไปของกฎระเบียบ AI ในสหภาพยุโรป นอกจากนี้ เรายังจะเจาะลึกถึงความสำคัญของการปฏิบัติตามมาตรฐานการกำกับดูแล AI ของรัฐบาลอีกด้วย

ดังนั้นเพื่อไม่ให้เป็นการเสียเวลา เรามาดูรายละเอียดที่สำคัญกันดีกว่า

ความสำคัญของกฎระเบียบ AI ในสหภาพยุโรป

สหภาพยุโรป (EU) กำลังแสดงจุดยืนเชิงรุกเกี่ยวกับกฎระเบียบและการปฏิบัติตามข้อกำหนดในโลกที่ถูกครอบงำโดยซอฟต์แวร์ที่ขับเคลื่อนด้วย AI สหภาพยุโรปตระหนักถึงประโยชน์และความเสี่ยงที่อาจเกิดขึ้นจากเทคโนโลยีอันทรงพลัง โดยตั้งเป้าที่จะสร้างกรอบการทำงานที่แข็งแกร่งซึ่งได้รับการสนับสนุนโดยหลักปฏิบัติด้านจริยธรรม ความโปร่งใส และการใช้งานอย่างมีความรับผิดชอบ การทำความเข้าใจถึงความสำคัญของการปฏิบัติตาม AI ในการพัฒนาซอฟต์แวร์มีความสำคัญด้วยเหตุผลหลายประการ:

การสร้างความน่าเชื่อถือ

การปฏิบัติตามข้อกำหนด AI ในสหภาพยุโรปมีเป้าหมายเพื่อสร้างความไว้วางใจระหว่างผู้ใช้ ธุรกิจ และผู้มีส่วนได้ส่วนเสียโดยสร้างความมั่นใจว่าระบบ AI ได้รับการพัฒนาและใช้อย่างมีจริยธรรม ความไว้วางใจนี้มีความสำคัญต่อการนำไปใช้อย่างกว้างขวางและการพัฒนาโซลูชั่น AI อย่างต่อเนื่อง

การลดความเสี่ยงด้านจริยธรรม

โอกาสที่จะเกิดอคติ การเลือกปฏิบัติ และข้อกังวลด้านจริยธรรมอื่นๆ เพิ่มมากขึ้น เมื่อ AI บูรณาการเข้ากับชีวิตประจำวันมากขึ้น กฎระเบียบของสหภาพยุโรปเป็นแนวทางในการลดความเสี่ยงเหล่านี้และรับรองว่าระบบ AI จะถูกใช้อย่างยุติธรรมและมีความรับผิดชอบ

การปฏิบัติตามกฎระเบียบและความยั่งยืน

สหภาพยุโรปมีเป้าหมายที่จะสร้างระบบนิเวศ AI ที่ยั่งยืนและมีความรับผิดชอบโดยการกำหนดข้อกำหนดการปฏิบัติตามกฎระเบียบที่ชัดเจน สิ่งนี้ช่วยให้ธุรกิจต่างๆ จัดการความเสี่ยง เสริมสร้างความปลอดภัยทางไซเบอร์ และส่งเสริมความโปร่งใส ท้ายที่สุดแล้ว การทำความเข้าใจถึงความสำคัญของการปฏิบัติตามข้อกำหนดของ AI จะช่วยให้ธุรกิจต่างๆ จัดการปัญหาทางกฎหมาย และส่งเสริมการพัฒนาและการใช้งานที่มีความรับผิดชอบของ AI

การปฏิบัติตามข้อกำหนดของ AI ในสหภาพยุโรปไม่เพียงแต่เป็นภาระผูกพันทางกฎหมายสำหรับธุรกิจเท่านั้น แต่ยังเป็นการลงทุนเชิงกลยุทธ์เพื่อความสำเร็จในระยะยาวของ AI และผลกระทบเชิงบวกในสังคมอีกด้วย การปฏิบัติตามกฎระเบียบด้าน AI ในสหภาพยุโรป ธุรกิจต่างๆ สามารถมีส่วนร่วมในการสร้างอนาคตที่โซลูชันที่ขับเคลื่อนด้วย AI เป็นประโยชน์ต่อทุกคนอย่างมีจริยธรรมและยั่งยืน

เพื่อให้แน่ใจว่าระบบ AI เป็นไปตามกฎ ระบบนั้นจะต้องผ่านการประเมินความสอดคล้อง เมื่อผ่านแล้ว จะได้รับการจดทะเบียนในฐานข้อมูลของสหภาพยุโรป และได้รับเครื่องหมาย CE (European Conformity) เพื่อแสดงว่าเป็นไปตามมาตรฐานก่อนที่จะได้รับอนุญาตให้ออกสู่ตลาด หากมีการเปลี่ยนแปลงครั้งใหญ่ในระบบ เช่น การฝึกสอนเกี่ยวกับข้อมูลใหม่หรือการเพิ่ม/การลบคุณสมบัติ ระบบจะต้องผ่านการประเมินใหม่เพื่อให้แน่ใจว่ายังคงเป็นไปตามกฎก่อนจึงจะได้รับการรับรองอีกครั้งและนำกลับเข้าสู่ฐานข้อมูล

กฎระเบียบ AI ของสหภาพยุโรป: การนำทางภูมิทัศน์ด้านกฎระเบียบสำหรับการพัฒนาซอฟต์แวร์ที่ขับเคลื่อนด้วย AI

สหภาพยุโรปได้บังคับใช้กฎระเบียบสำคัญหลายประการซึ่งส่งผลกระทบอย่างมีนัยสำคัญต่อสาขาปัญญาประดิษฐ์ กฎระเบียบด้าน AI ในการพัฒนาซอฟต์แวร์ได้รับการออกแบบมาเพื่อให้แน่ใจว่าการพัฒนา AI อย่างมีจริยธรรมสามารถปกป้องความเป็นส่วนตัวของบุคคลและลดความเสี่ยงที่อาจเกิดขึ้นได้ มาดูการปฏิบัติตามข้อกำหนดสำคัญของสหภาพยุโรปสำหรับการพัฒนา AI กัน

1. กฎระเบียบคุ้มครองข้อมูลทั่วไป (GDPR)

กฎระเบียบคุ้มครองข้อมูลทั่วไป (GDPR) เป็นปัจจัยสำคัญในการกำหนดภูมิทัศน์ของปัญญาประดิษฐ์ในสหภาพยุโรป โดยมุ่งเน้นที่การปกป้องข้อมูลส่วนบุคคลและบังคับใช้มาตรการที่เข้มงวดเพื่อให้เกิดความโปร่งใสและความรับผิดชอบในแอปพลิเคชัน AI

นอกจากนี้ GDPR ยังจัดการกับอคติของอัลกอริทึม โดยเน้นความสำคัญของระบบ AI ที่ยุติธรรมและเป็นกลาง กฎระเบียบดังกล่าวจำเป็นต้องใช้การประเมินผลกระทบด้านการคุ้มครองข้อมูล (DPIA) สำหรับโครงการ AI ซึ่งประเมินความเสี่ยงที่อาจเกิดขึ้นและผลกระทบด้านความเป็นส่วนตัว กรอบการกำกับดูแลที่ครอบคลุมนี้มีจุดมุ่งหมายเพื่อสร้างรากฐานที่แข็งแกร่งสำหรับการพัฒนา AI ที่มีจริยธรรมและความรับผิดชอบภายในสหภาพยุโรป

2. พระราชบัญญัติปัญญาประดิษฐ์

พระราชบัญญัติปัญญาประดิษฐ์เป็นกรอบการทำงานที่ครอบคลุมซึ่งควบคุมระบบ AI ที่มีความเสี่ยงสูง โดยสรุปข้อกำหนดด้านความโปร่งใส ความสามารถในการอธิบาย และการกำกับดูแลของมนุษย์ โครงสร้างการกำกับดูแลนี้มีจุดมุ่งหมายเพื่อส่งเสริมการพัฒนาและการปรับใช้ AI ที่มีความรับผิดชอบและอธิบายได้

ธุรกิจที่พัฒนาซอฟต์แวร์ที่ขับเคลื่อนด้วย AI จะต้องปฏิบัติตามการปฏิบัติตามข้อกำหนดของ AI ในการพัฒนาซอฟต์แวร์และผลที่ตามมา รวมถึงลำดับเวลาของการปฏิบัติตามข้อกำหนดและข้อพิจารณาในทางปฏิบัติ ด้วยการกำหนดเกณฑ์เพื่อความโปร่งใสและการกำกับดูแล พระราชบัญญัตินี้จึงสร้างความสมดุลระหว่างการส่งเสริมนวัตกรรมและการปกป้องสิทธิขั้นพื้นฐาน โดยเป็นการปูทางไปสู่แนวทางปฏิบัติด้าน AI ที่มีจริยธรรมในสหภาพยุโรป

3. คำสั่งความรับผิดต่อผลิตภัณฑ์

Product Liability Directive เป็นกรอบการทำงานที่ครอบคลุมที่ให้ความสำคัญกับความปลอดภัยของผลิตภัณฑ์ AI และความเป็นอยู่ของผู้ใช้ปลายทาง โดยมอบหมายให้นักพัฒนารับผิดชอบในการจัดการความเสี่ยงที่อาจเกิดขึ้นที่เกี่ยวข้องกับผลิตภัณฑ์ AI โดยเน้นถึงความจำเป็นในการใช้แนวทางเชิงรุกเพื่อความปลอดภัยของผลิตภัณฑ์

คำสั่งดังกล่าวสนับสนุนให้นักพัฒนาที่เกี่ยวข้องกับการพัฒนาผลิตภัณฑ์สำรวจกลยุทธ์การบริหารความเสี่ยงเพื่อปรับปรุงมาตรฐานความปลอดภัยโดยรวมของผลิตภัณฑ์ AI การปฏิบัติตามมาตรการเหล่านี้ นักพัฒนาสามารถมีส่วนร่วมในการสร้างภูมิทัศน์ AI ที่ปลอดภัยและเชื่อถือได้ภายในสหภาพยุโรป

ด้วยการทำความเข้าใจกฎระเบียบด้าน AI ในสหภาพยุโรปอย่างครอบคลุม ธุรกิจต่างๆ จึงสามารถนำทางภูมิทัศน์ที่เปลี่ยนแปลงไปของการพัฒนา AI รับรองการปฏิบัติตามกฎระเบียบ แนวปฏิบัติด้านจริยธรรม และการปรับใช้เทคโนโลยี AI อย่างมีความรับผิดชอบ

การสำรวจสเปกตรัมความเสี่ยง: การทำความเข้าใจประเภทของความเสี่ยงในพระราชบัญญัติ AI ของสหภาพยุโรปฉบับใหม่

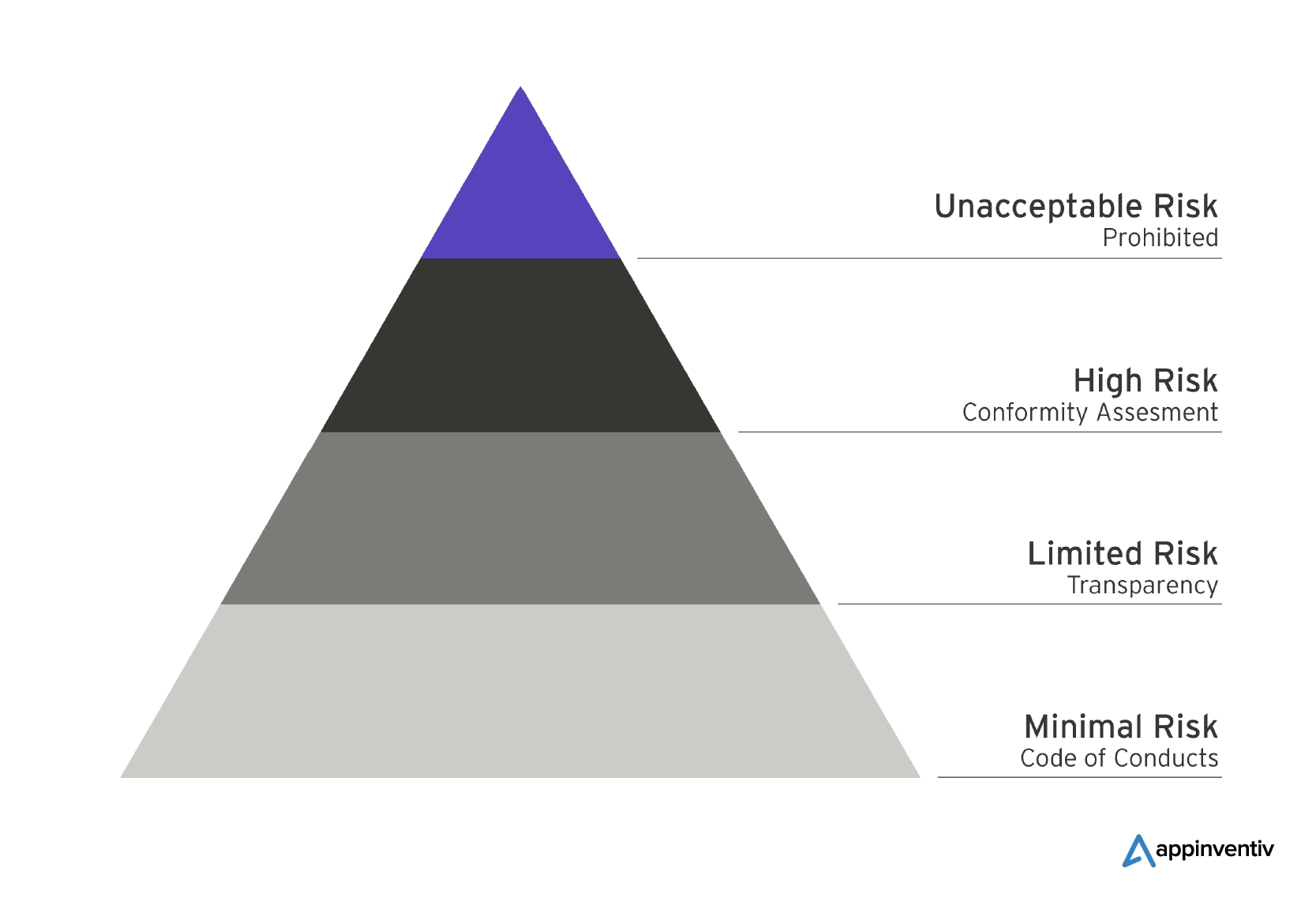

ตามที่รัฐสภายุโรประบุ วัตถุประสงค์หลักคือเพื่อให้มั่นใจในความปลอดภัย ความโปร่งใส การตรวจสอบย้อนกลับ การไม่เลือกปฏิบัติ และความยั่งยืนด้านสิ่งแวดล้อมของระบบ AI ที่ใช้งานภายในสหภาพยุโรป ดังนั้น พวกเขาจึงได้กำหนดกฎเกณฑ์ที่แตกต่างกันตามระดับความเสี่ยงที่เกี่ยวข้องกับระบบ AI มาดูรายละเอียดหลายประเภทด้านล่าง:

ความเสี่ยงที่ยอมรับไม่ได้: การห้ามระบบ AI ที่เป็นอันตราย

ระบบ AI ที่จัดอยู่ในประเภทของความเสี่ยงที่ยอมรับไม่ได้ถือเป็นภัยคุกคามโดยตรงต่อบุคคล และจะถูกห้ามโดยสิ้นเชิงตามกฎหมาย AI ของสหภาพยุโรปฉบับใหม่ ตัวอย่างเช่น การบิดเบือนพฤติกรรมทางปัญญา การให้คะแนนทางสังคม และการระบุตัวตนด้วยชีวมาตร เป็นตัวอย่างบางส่วนของกิจกรรมที่อยู่ในหมวดหมู่ต้องห้ามนี้ อาจมีการยกเว้นบางประการสำหรับการสมัครบังคับใช้กฎหมายโดยเฉพาะ ซึ่งจะอยู่ภายใต้เงื่อนไขที่เข้มงวด โดยเฉพาะอย่างยิ่งในกรณีของระบบระบุตัวตนด้วยไบโอเมตริกแบบเรียลไทม์

ความเสี่ยงสูง: การปกป้องความปลอดภัยและสิทธิขั้นพื้นฐาน

หมวดหมู่ที่มีความเสี่ยงสูงที่ระบุไว้ในพระราชบัญญัติ AI ของสหภาพยุโรปทำหน้าที่เป็นมาตรการป้องกันเพื่อให้มั่นใจในความปลอดภัยและการรักษาสิทธิ์ขั้นพื้นฐานเมื่อปรับใช้ปัญญาประดิษฐ์ หมวดหมู่นี้ครอบคลุมถึงระบบ AI ที่มีศักยภาพในการส่งผลเสียต่อความปลอดภัยหรือสิทธิขั้นพื้นฐาน

เพื่อให้เกิดความชัดเจนเพิ่มเติม หมวดหมู่ที่มีความเสี่ยงสูงจึงแบ่งออกเป็นสองหมวดหมู่ย่อย หมวดหมู่ย่อยแรกมุ่งเน้นไปที่ระบบ AI ที่รวมอยู่ในผลิตภัณฑ์ที่อยู่ภายใต้กฎหมายความปลอดภัยของผลิตภัณฑ์ของสหภาพยุโรป ซึ่งรวมถึงภาคส่วนต่างๆ มากมาย เช่น ของเล่น การบิน และอุปกรณ์ทางการแพทย์ หมวดหมู่ย่อยที่สองมุ่งเน้นไปที่ระบบ AI ที่ทำงานในพื้นที่สำคัญเฉพาะ ซึ่งจำเป็นต้องลงทะเบียนบังคับในฐานข้อมูลของสหภาพยุโรป

ความเสี่ยงที่จำกัด: ความโปร่งใสน้อยที่สุดสำหรับการตัดสินใจของผู้ใช้โดยอาศัยข้อมูล

ระบบ AI ที่จัดอยู่ในประเภทความเสี่ยงที่จำกัดจำเป็นต้องปฏิบัติตามข้อกำหนดด้านความโปร่งใสขั้นต่ำที่ช่วยให้ผู้ใช้สามารถตัดสินใจได้อย่างมีข้อมูล ตามข้อจำกัดความเสี่ยงที่จำกัด ผู้ใช้ควรได้รับการแจ้งเตือนเมื่อมีการโต้ตอบกับแอปพลิเคชัน AI เช่น การสร้างหรือจัดการเนื้อหารูปภาพ เสียง หรือวิดีโอ เช่น Deepfakes มาตรฐานความโปร่งใสสำหรับ AI ที่มีความเสี่ยงจำกัดมุ่งเน้นไปที่การสร้างสมดุลระหว่างการรับรู้ของผู้ใช้และการใช้งานแอปพลิเคชัน AI อย่างราบรื่น

วัตถุประสงค์ทั่วไปและ AI เชิงสร้างสรรค์: รับประกันความโปร่งใส

พระราชบัญญัติ AI ของสหภาพยุโรปกำหนดแนวทางที่ชัดเจนสำหรับโมเดล AI สำหรับการใช้งานทั่วไปและเชิงสร้างสรรค์ เพื่อให้มั่นใจถึงความโปร่งใสในการดำเนินงาน ซึ่งรวมถึงเครื่องมืออย่าง ChatGPT ซึ่งจำเป็นต้องเปิดเผยว่าเนื้อหาสร้างขึ้นโดย AI ป้องกันการสร้างเนื้อหาที่ผิดกฎหมาย และเผยแพร่สรุปข้อมูลที่มีลิขสิทธิ์ซึ่งใช้สำหรับการฝึกอบรม

นอกจากนี้ โมเดล AI อเนกประสงค์ที่มีผลกระทบสูง เช่น โมเดลขั้นสูง เช่น GPT-4 จะต้องได้รับการประเมินที่ครอบคลุม ในกรณีที่เกิดเหตุการณ์ร้ายแรง โมเดลเหล่านี้มีหน้าที่รายงานเหตุการณ์ดังกล่าวต่อคณะกรรมาธิการยุโรป

การพัฒนาซอฟต์แวร์ที่สอดคล้องกับ AI – ข้อควรพิจารณาที่สำคัญสำหรับธุรกิจ

ตามข้อมูลเชิงลึกจากการทบทวนของ MIT กฎหมาย EU AI Act เป็นกฎหมายเชิงนวัตกรรมที่ออกแบบมาเพื่อบรรเทาอันตรายที่อาจเกิดขึ้นจากการใช้ AI ในพื้นที่ที่มีความเสี่ยงสูง จึงเป็นการปกป้องสิทธิขั้นพื้นฐานของแต่ละบุคคล โดยเฉพาะภาคส่วนต่างๆ เช่น การดูแลสุขภาพ การศึกษา การเฝ้าระวังชายแดน และบริการสาธารณะ ได้รับการระบุว่าเป็นประเด็นสำคัญในการคุ้มครอง นอกจากนี้ พระราชบัญญัติยังห้ามการใช้แอปพลิเคชัน AI ที่เป็น "ความเสี่ยงที่ยอมรับไม่ได้" อย่างชัดเจน

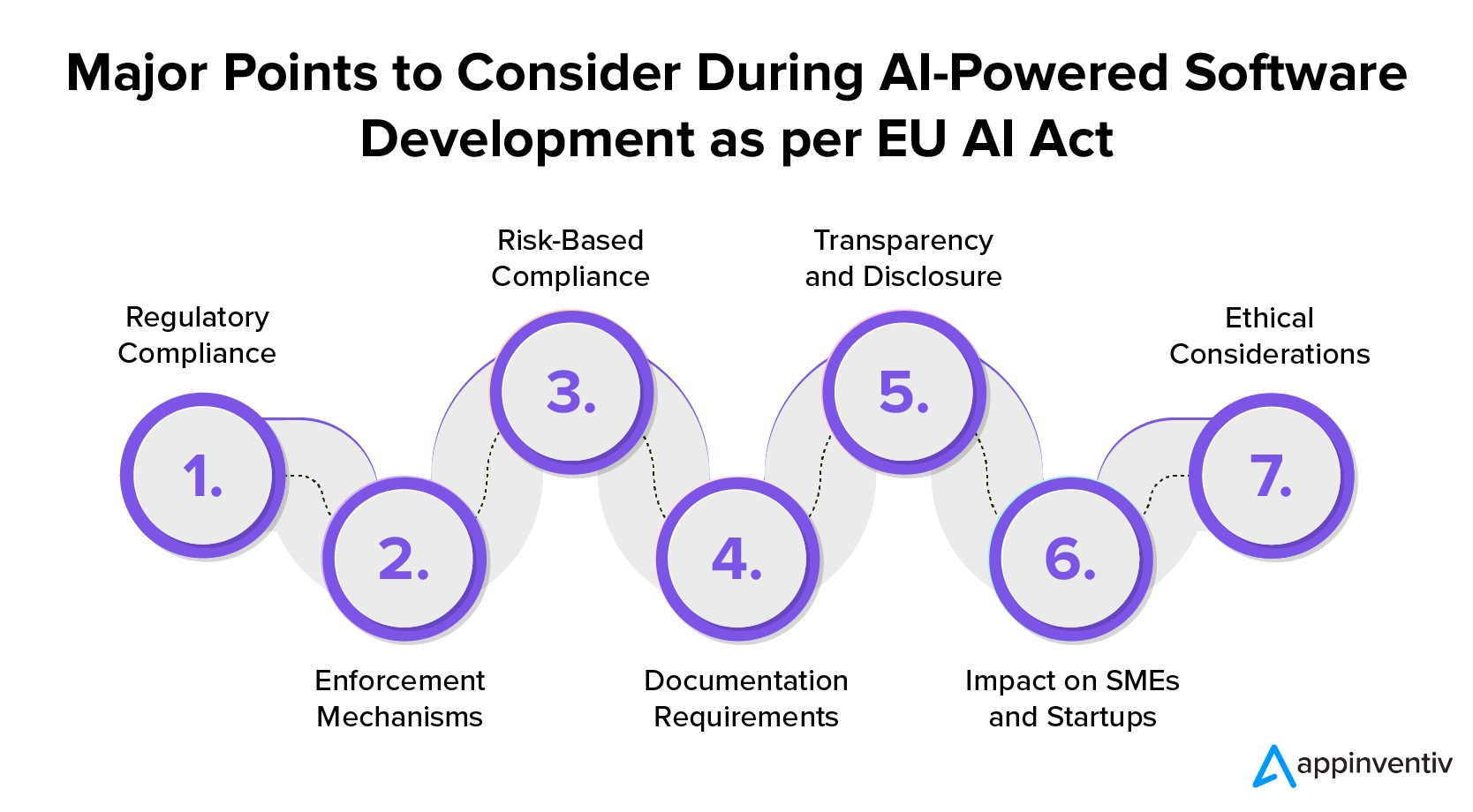

ประกาศในเดือนธันวาคม 2023 พระราชบัญญัติ AI ของสหภาพยุโรปเป็นขั้นตอนสำคัญในการควบคุมปัญญาประดิษฐ์ในสหภาพยุโรป ธุรกิจที่ต้องการทำความเข้าใจกฎระเบียบด้าน AI ในการพัฒนาซอฟต์แวร์จะต้องเข้าใจถึงผลกระทบและเตรียมพร้อมสำหรับการปฏิบัติตามกฎระเบียบ ต่อไปนี้คือประเด็นสำคัญที่ธุรกิจที่ต้องการลงทุนในบริการพัฒนาซอฟต์แวร์ที่สอดคล้องกับ AI ควรพิจารณา:

1. การปฏิบัติตามกฎระเบียบ

พระราชบัญญัติ AI ของสหภาพยุโรปกำหนดให้นักพัฒนาซอฟต์แวร์ AI ต้องปฏิบัติตามอย่างเข้มงวด โดยกำหนดกฎระเบียบที่แม่นยำสำหรับทั้งผู้ให้บริการและผู้ใช้ เพื่อให้มั่นใจว่าปฏิบัติตามกฎระเบียบเหล่านี้ ธุรกิจที่ต้องการลงทุนในการพัฒนาซอฟต์แวร์ที่ขับเคลื่อนด้วย AI จะต้องปฏิบัติตามมาตรฐานความโปร่งใสและการรายงานอย่างเคร่งครัดเมื่อแนะนำระบบ AI สู่ตลาดสหภาพยุโรป

2. กลไกการบังคับใช้

พระราชบัญญัตินี้ประกอบด้วยกลไกการบังคับใช้ที่เข้มงวดและโครงสร้างค่าปรับที่เข้มงวด การไม่ปฏิบัติตามข้อกำหนด โดยเฉพาะอย่างยิ่งในกรณีที่มีการละเมิด AI อย่างร้ายแรง อาจทำให้ต้องเสียค่าปรับสูงถึง 7% ของมูลค่าการซื้อขายประจำปีทั่วโลก สิ่งนี้เน้นย้ำถึงความสำคัญของการพัฒนา AI อย่างมีจริยธรรมและการใช้งานอย่างมีความรับผิดชอบ

3. การปฏิบัติตามตามความเสี่ยง

เมื่อธุรกิจเลือกที่จะใช้การพัฒนาซอฟต์แวร์ที่ขับเคลื่อนด้วย AI พวกเขาจะต้องดำเนินการประเมินความเสี่ยง สิ่งเหล่านี้ช่วยในการจำแนกระบบ AI ตามความเสี่ยงที่อาจเกิดขึ้นกับความปลอดภัยของมนุษย์และสิทธิขั้นพื้นฐาน

ระบบ AI จะถูกจัดอยู่ในหมวดหมู่ “ที่ยอมรับไม่ได้” “สูง” “จำกัด” หรือ “ความเสี่ยงขั้นต่ำ” โดยมีข้อกำหนดที่เข้มงวดมากขึ้นสำหรับกลุ่มที่มีความเสี่ยงสูงกว่า

เพื่อให้มั่นใจว่าปฏิบัติตามข้อกำหนดของ AI ในสหภาพยุโรป ธุรกิจต่างๆ จะต้องจัดหมวดหมู่หน้าที่ในการปฏิบัติตามกฎระเบียบตามระดับความเสี่ยงที่เกี่ยวข้อง แนวทางนี้ช่วยให้สามารถดำเนินมาตรการที่เหมาะสมสำหรับระบบ AI ประเภทต่างๆ ได้ ธุรกิจต้องมีส่วนร่วมในกระบวนการนี้เพื่อลดความเสี่ยงที่อาจเกิดขึ้นและรับรองการใช้ AI อย่างมีความรับผิดชอบ

4. ข้อกำหนดด้านเอกสาร

ธุรกิจที่พัฒนาซอฟต์แวร์ที่ใช้ AI จำเป็นต้องดูแลรักษาเอกสารทางเทคนิคและบันทึกที่ทันสมัยสำหรับระบบของตน เอกสารนี้มีความสำคัญต่อความโปร่งใสโดยรวมและเพื่อแสดงให้เห็นถึงการปฏิบัติตามมาตรฐานด้านกฎระเบียบ

5. ความโปร่งใสและการเปิดเผยข้อมูล

นักพัฒนาซอฟต์แวร์ที่ได้รับการว่าจ้างจากธุรกิจต่างๆ จะต้องปฏิบัติตามพันธกรณีด้านความโปร่งใสที่แตกต่างกัน ขึ้นอยู่กับระดับความเสี่ยงของระบบ AI สำหรับระบบ AI ที่มีความเสี่ยงสูง จำเป็นต้องลงทะเบียนในฐานข้อมูลของสหภาพยุโรป นอกจากนี้ ธุรกิจจะต้องแจ้งให้ผู้ใช้ทราบและรับความยินยอมสำหรับแอปพลิเคชัน AI ที่เฉพาะเจาะจง เช่น การจดจำอารมณ์ หรือการจัดหมวดหมู่ไบโอเมตริกซ์

6. ผลกระทบต่อ SMEs และสตาร์ทอัพ

เพื่อสนับสนุนธุรกิจขนาดเล็ก พระราชบัญญัติ AI ของสหภาพยุโรปจึงจำกัดค่าปรับสำหรับวิสาหกิจขนาดกลางและขนาดย่อม (SMEs) และสตาร์ทอัพ สิ่งนี้สะท้อนให้เห็นถึงธรรมชาติที่หลากหลายของธุรกิจ AI และส่งเสริมการปฏิบัติตามกฎระเบียบ

7. ข้อพิจารณาด้านจริยธรรม

กรอบการทำงานดังกล่าวเน้นการพิจารณาด้านจริยธรรม โดยกำหนดให้ธุรกิจต่างๆ ต้องสร้างสมดุลระหว่างการควบคุมศักยภาพของ AI และลดความเสี่ยง พระราชบัญญัติ AI ของสหภาพยุโรปมีเป้าหมายที่จะลงโทษการไม่ปฏิบัติตามข้อกำหนดและส่งเสริมให้ปฏิบัติตามมาตรฐานความปลอดภัยระดับสูง

ทำอย่างไรจึงจะประสบความสำเร็จในยุคกฎระเบียบ AI ของสหภาพยุโรป: แนวทางปฏิบัติที่ดีที่สุดในการรับรองการปฏิบัติตามข้อกำหนด

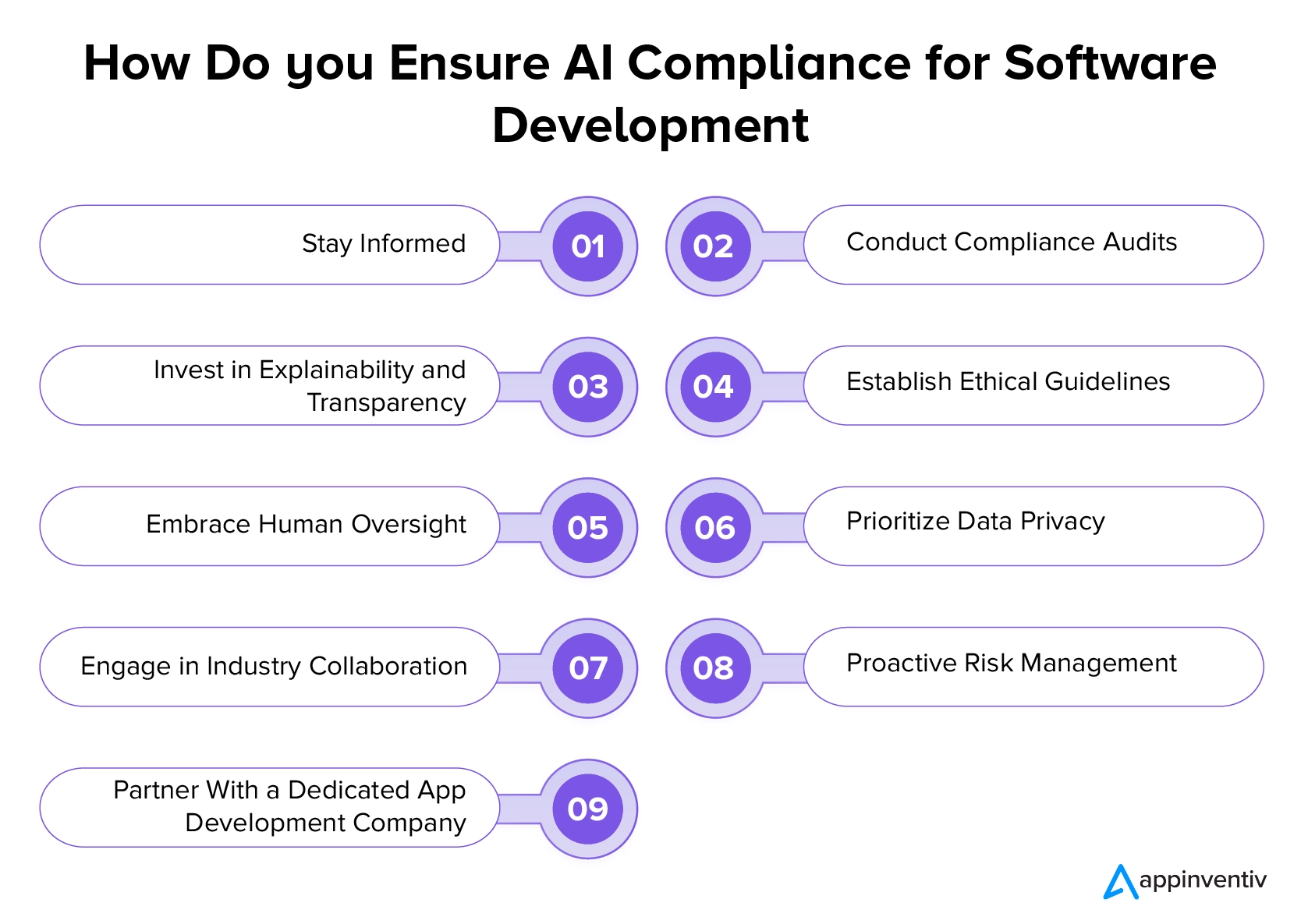

พระราชบัญญัติปัญญาประดิษฐ์ของสหภาพยุโรปและกฎระเบียบอื่นๆ ได้เปลี่ยนแปลงภูมิทัศน์การพัฒนา AI อย่างมีนัยสำคัญ โดยให้ความสำคัญกับจริยธรรม ความโปร่งใส และความเป็นอยู่ที่ดีของผู้ใช้ แม้ว่าโอกาสในการปรับตัวเข้ากับการเปลี่ยนแปลงเหล่านี้อาจทำให้เกิดความท้าทายในการพัฒนา AI แต่ธุรกิจต่างๆ สามารถสำรวจภูมิประเทศใหม่นี้ได้โดยปฏิบัติตามแนวทางปฏิบัติที่ดีที่สุดที่กล่าวถึงด้านล่าง และร่วมมือกับบริษัทพัฒนาซอฟต์แวร์ระดับมืออาชีพ

รับทราบข้อมูลอยู่เสมอ

ธุรกิจจะต้องรับทราบข้อมูลเกี่ยวกับการพัฒนาล่าสุดในกฎระเบียบ AI รวมถึงการแก้ไขและการปรับปรุง สิ่งสำคัญคือต้องตรวจสอบหน่วยงานกำกับดูแล สิ่งพิมพ์อย่างเป็นทางการ และการอัปเดตอุตสาหกรรมอย่างสม่ำเสมอ เพื่อให้มั่นใจว่าตระหนักถึงการเปลี่ยนแปลงใด ๆ ที่อาจส่งผลกระทบต่อความคิดริเริ่มของ AI ด้วยการติดตามข่าวสารล่าสุดเกี่ยวกับกฎระเบียบ AI ในการพัฒนาซอฟต์แวร์ ธุรกิจต่างๆ จะสามารถปรับกลยุทธ์ในเชิงรุกและรับรองการปฏิบัติตามกฎระเบียบที่เปลี่ยนแปลงตลอดเวลา

ดำเนินการตรวจสอบการปฏิบัติตามข้อกำหนด

ธุรกิจต้องทำการตรวจสอบระบบและกระบวนการ AI ของตนเป็นประจำเพื่อให้มั่นใจว่าสอดคล้องกับกฎระเบียบที่มีอยู่ การประเมินความโปร่งใส ความยุติธรรม และความรับผิดชอบของอัลกอริทึม AI เป็นสิ่งสำคัญ ซึ่งรวมถึงการระบุและจัดการกับอคติหรือความเสี่ยงที่อาจเกิดขึ้นที่เกี่ยวข้องกับแอปพลิเคชัน AI ของคุณ การดำเนินการตรวจสอบเหล่านี้ช่วยให้ธุรกิจสามารถบรรเทาปัญหาทางกฎหมายหรือจริยธรรมที่อาจเกิดขึ้นได้

อ่านเพิ่มเติม: การป้องกันการล่มสลายของโมเดล AI: การจัดการกับความเสี่ยงโดยธรรมชาติของชุดข้อมูลสังเคราะห์

ลงทุนในความสามารถในการอธิบายและความโปร่งใส

ธุรกิจควรจัดลำดับความสำคัญของความโปร่งใสและความสามารถในการอธิบายในระบบ AI ของตน พวกเขาควรใช้โซลูชันที่ช่วยให้สามารถสื่อสารได้ชัดเจนว่าอัลกอริทึม AI ของพวกเขาทำการตัดสินใจอย่างไร สิ่งนี้สอดคล้องกับข้อกำหนดด้านกฎระเบียบและส่งเสริมความไว้วางใจระหว่างผู้ใช้และผู้มีส่วนได้ส่วนเสีย

กำหนดแนวปฏิบัติทางจริยธรรม

ธุรกิจต้องจัดลำดับความสำคัญในการพัฒนาและการนำแนวทางด้านจริยธรรมที่ชัดเจนสำหรับโครงการ AI ของตน แนวทางเหล่านี้ควรกล่าวถึงการพิจารณาด้านจริยธรรมที่สำคัญโดยเฉพาะ เช่น ความเป็นธรรม ความเป็นส่วนตัว และผลกระทบต่อสังคมในวงกว้างของ AI มาตรฐานทางจริยธรรมที่แข็งแกร่งช่วยให้มั่นใจได้ถึงการพัฒนา AI ที่มีความรับผิดชอบ ปลูกฝังความไว้วางใจระหว่างผู้ใช้และผู้มีส่วนได้ส่วนเสีย และสอดคล้องกับข้อกำหนดด้านกฎระเบียบ

ยอมรับการกำกับดูแลของมนุษย์

ธุรกิจควรเน้นย้ำถึงความสำคัญของการควบคุมดูแลโดยมนุษย์ในกระบวนการ AI โดยเฉพาะอย่างยิ่งในการใช้งานที่มีความเสี่ยงสูง การบูรณาการการตรวจสอบโดยมนุษย์และการตัดสินใจถือเป็นสิ่งสำคัญในการเพิ่มความรับผิดชอบและลดความเสี่ยงที่อาจเกิดขึ้นซึ่งเชื่อมโยงกับระบบ AI อัตโนมัติเต็มรูปแบบ

จัดลำดับความสำคัญความเป็นส่วนตัวของข้อมูล

ธุรกิจต้องปฏิบัติตามแนวทางปฏิบัติด้านความเป็นส่วนตัวของข้อมูลที่เข้มงวดซึ่งสอดคล้องกับกฎระเบียบเช่น GDPR เมื่อออกแบบซอฟต์แวร์ที่ขับเคลื่อนด้วย AI พวกเขาต้องแน่ใจว่าได้ใช้โปรโตคอลการจัดการ การจัดเก็บ และการประมวลผลข้อมูลที่ปลอดภัย เพื่อปกป้องสิทธิ์ความเป็นส่วนตัวของบุคคลที่ข้อมูลถูกใช้โดยระบบ AI ความมุ่งมั่นต่อความเป็นส่วนตัวของข้อมูลนี้ช่วยให้มั่นใจได้ว่าจะปฏิบัติตามข้อกำหนดทางกฎหมายและสร้างความไว้วางใจกับผู้ใช้

มีส่วนร่วมในความร่วมมือทางอุตสาหกรรม

ธุรกิจที่ต้องการลงทุนในบริการพัฒนาซอฟต์แวร์ที่สอดคล้องกับ AI ควรมีส่วนร่วมในความร่วมมือในอุตสาหกรรม ฟอรัม และการอภิปรายที่เน้นเรื่องกฎระเบียบของ AI ด้วยการมีส่วนร่วมกับเพื่อนร่วมงานและผู้เชี่ยวชาญในอุตสาหกรรม พวกเขาจะได้รับข้อมูลเชิงลึกอันมีค่าและมีส่วนช่วยในการพัฒนาแนวทางปฏิบัติในการพัฒนาที่ดีที่สุด

การจัดการความเสี่ยงเชิงรุก

ธุรกิจควรใช้กลยุทธ์การบริหารความเสี่ยงเชิงรุกเพื่อระบุและลดความเสี่ยงที่อาจเกิดขึ้นที่เกี่ยวข้องกับแอปพลิเคชัน AI ดำเนินการประเมินความเสี่ยงอย่างละเอียดถี่ถ้วนและพัฒนาแผนเพื่อรับมือกับความท้าทายที่ไม่คาดฝัน

ร่วมมือกับบริษัทพัฒนาซอฟต์แวร์เฉพาะด้าน

หนึ่งในสิ่งที่สำคัญที่สุดที่ธุรกิจสามารถทำได้เพื่อให้ประสบความสำเร็จตามกฎข้อบังคับ AI ใหม่และการปฏิบัติตามข้อกำหนดในสหภาพยุโรป คือการร่วมมือกับบริษัทที่ให้บริการการพัฒนา AI อย่างมืออาชีพ การขอคำแนะนำจากผู้เชี่ยวชาญที่ทุ่มเททำให้มั่นใจได้ว่าความคิดริเริ่มด้าน AI ของพวกเขาจะสอดคล้องกับภูมิทัศน์ทางกฎหมาย

บริษัทมืออาชีพที่รอบรู้ในแนวทางของสหภาพยุโรปสำหรับการพัฒนา AI สามารถให้คำแนะนำเฉพาะที่เหมาะกับธุรกิจของตนได้ ช่วยให้พวกเขานำทางในสภาพแวดล้อมด้านกฎระเบียบที่ซับซ้อน และลดความเสี่ยงทางกฎหมายที่เกี่ยวข้อง

Appinventiv จะเป็นพันธมิตรในอุดมคติของคุณในการดำเนินการตามพระราชบัญญัติ AI ของสหภาพยุโรปฉบับใหม่เพื่อการพัฒนาที่คล่องตัวได้อย่างไร

เราหวังว่าบล็อกของเราจะทำให้คุณเข้าใจความซับซ้อนที่เกี่ยวข้องกับกฎระเบียบ AI ในสหภาพยุโรป ทีมนักพัฒนา AI ผู้ช่ำชองของเรานำความเชี่ยวชาญอันมากมายมาสู่โต๊ะ เพื่อให้มั่นใจว่าจะสร้างโซลูชัน AI ที่ล้ำสมัยซึ่งสอดคล้องกับมาตรฐานการกำกับดูแลล่าสุด เรามุ่งมั่นที่จะอยู่ในระดับแนวหน้าของเทคโนโลยี โดยรับประกันว่าแอปพลิเคชันของคุณไม่เพียงแต่เป็นนวัตกรรมใหม่เท่านั้น แต่ยังปฏิบัติตามกฎหมาย EU AI Act อย่างสมบูรณ์อีกด้วย

ในฐานะบริษัทพัฒนาแอป AI โดยเฉพาะ เรามีความเชี่ยวชาญเป็นอย่างดีในข้อกำหนด แนวทางปฏิบัติที่โปร่งใส และลำดับเวลาการปฏิบัติตามที่ระบุไว้ในกรอบการกำกับดูแล สิ่งนี้ช่วยให้เราสามารถแนะนำโครงการ AI ของคุณตามมาตรฐาน EU ที่เข้มงวด

ติดต่อผู้เชี่ยวชาญของเราเพื่อเริ่มต้นการเดินทางของการพัฒนา AI ที่ผสานรวมนวัตกรรมและการปฏิบัติตามข้อกำหนดได้อย่างราบรื่น

คำถามที่พบบ่อย

ถาม: GDPR ส่งผลต่อการพัฒนาและการใช้งาน AI ในสหภาพยุโรปอย่างไร

ก. กฎระเบียบคุ้มครองข้อมูลทั่วไป (GDPR) ส่งผลกระทบอย่างมากต่อการพัฒนาและการใช้งาน AI ในสหภาพยุโรป โดยเน้นย้ำการปกป้องข้อมูลส่วนบุคคล รับรองความโปร่งใส และส่งเสริมความรับผิดชอบในแอปพลิเคชัน AI เพื่อจัดการกับความกังวลเกี่ยวกับอคติของอัลกอริทึม การปฏิบัติตาม GDPR จึงกำหนดให้มีการดำเนินการประเมินผลกระทบด้านการคุ้มครองข้อมูล (DPIA) สำหรับโครงการ AI

ถาม มีกฎระเบียบด้าน AI เฉพาะภาคส่วนในสหภาพยุโรป เช่น ในด้านการดูแลสุขภาพหรือการเงินหรือไม่

ตอบ กฎระเบียบ AI ของสหภาพยุโรปทำหน้าที่เป็นกรอบการทำงานที่ครอบคลุมสำหรับการควบคุมระบบ AI ที่มีความเสี่ยงสูง อย่างไรก็ตาม ภาคส่วนเฉพาะอาจมีกฎระเบียบเพิ่มเติมที่ปรับให้เหมาะกับความท้าทายและข้อกำหนดเฉพาะของตน ตัวอย่างเช่น อุตสาหกรรมการดูแลสุขภาพอาจมีกฎระเบียบเพิ่มเติมเพื่อให้แน่ใจว่า AI จะมีการใช้อย่างมีจริยธรรมและมีความรับผิดชอบในการใช้งานทางการแพทย์ ในทำนองเดียวกัน ภาคการเงินอาจมีแนวทางเฉพาะสำหรับการใช้งาน AI ในบริการทางการเงิน ธุรกิจต้องตระหนักถึงทั้งกฎระเบียบ AI ทั่วไป เช่น พระราชบัญญัติ AI ของสหภาพยุโรป และกฎระเบียบเฉพาะภาคส่วนใดๆ ที่ใช้กับโดเมนของตน

ถาม: CEO และ CTO ควรคำนึงถึงอะไรบ้างเมื่อพัฒนาผลิตภัณฑ์ AI ให้สอดคล้องกับกฎระเบียบของสหภาพยุโรป

ตอบ เพื่อให้เป็นไปตามกฎระเบียบของสหภาพยุโรปเกี่ยวกับ AI ซีอีโอและ CTO จะต้องจัดลำดับความสำคัญในการติดตามข่าวสารเกี่ยวกับพระราชบัญญัติล่าสุดก่อน จำเป็นอย่างยิ่งที่จะต้องตรวจสอบให้แน่ใจว่าสอดคล้องกับแนวปฏิบัติที่โปร่งใสและกำหนดเวลาการปฏิบัติตามกฎระเบียบ นอกจากนี้ แนวปฏิบัติทางจริยธรรม ความโปร่งใส การกำกับดูแลของมนุษย์ แนวทางปฏิบัติด้านความเป็นส่วนตัวของข้อมูล การจัดการความเสี่ยง การให้คำปรึกษาด้านกฎหมาย และการมีส่วนร่วมอย่างแข็งขันในความร่วมมือในอุตสาหกรรม ล้วนเป็นองค์ประกอบสำคัญในการพัฒนากลยุทธ์ AI ที่ตรงตามข้อกำหนดด้านกฎระเบียบและมาตรฐานทางจริยธรรมในสหภาพยุโรป