GPT-3 书写工具的工作原理以及使用时要注意的 4 件事

已发表: 2022-10-24自 GPT-3 出现以来,有大量初创公司在争夺以各种格式销售 AI 文案服务的用户的关注。

电子邮件、博客文章、登陆页面、广告文案、销售沟通......

还记得大多数翻译和校对工作仍然由人类完成的时候吗?

然后是 DeepL、谷歌翻译和语法。

使每个人的识字和语言民主化和加速。

你猜怎么着?

那里发生的事情现在正在发生在文本创建中。

整个价值链的源头层。

让我们讨论一下 AI 文案正在发生什么,为什么 GPT-3 只是一个开始,以及这些 AI 文案工具中的大多数除了在同一核心之上构建一些漂亮的面孔之外,并没有做太多事情。

Jarvis、Copy AI、CopySmith、CopyShark、Writesonic、Anyword...

他们来了,看到了 GPT-3,现在正试图赢得你作为潜在用户。

一些人工智能文案工具发展得非常快,建立了强大的收入渠道,并从优秀的投资者那里筹集资金。

经常过度承诺数百个模板并没有真正提供他们所说的那样,当归结起来时,它们都没有影响和改进其核心文本质量的能力。

他们都依赖于...

来自 OpenAI 的 GPT-3。

有很多能力,一个真正的通用人工智能强国和许多好奇的头脑的灯塔,他们现在涌向自然语言生成领域。

但 GPT-3 只是一个令人难以置信的快速发展的技术分支的开始。

突然出现了 GPT-3,危险变成了机会。 OpenAI 的历史

和我一起做一个简短的技术介绍。 让我告诉你更多关于那些看似神秘的信件的含义。

GPT-3代表Generative Pre-trained Transformer v3 。

让我逐字逐句地引导你。

从简单的“生成”开始意味着人工智能模型旨在创造。

对于“变形金刚”,我们不是在谈论我们从电影中知道的 3 层楼大小的汽车人。

Transformer 是深度学习和人工智能领域相对较新的发展。

一种技术,使机器能够学习人类语言的模式并通过逐字创建句子来继续学习。

单独的变压器模型就像一个新生儿,除非它向父母学习,否则它无法做很多事情。

变形金刚通过阅读数十亿个示例来学习以发挥创造力。

这就是为什么它被称为对大量人类语言进行“预训练”的原因。

我们谈论数以万亿计的单词。

我也会在这里和那里谈论模型。

我们在这里不做高级时装,因此,尝试将模型视为某物的快照。

包括它所经历的所有经验、学习和发展。

想想你今天早上是如何醒来的,这一刻反映并包括了你的整个生活,充满了经验和学习,这使你成为了今天的你。

想象一下,您用所有先前影响的事件拍摄这一刻的快照。 这是一个根据您的经验预先训练的模型。

让我知道这是否让您在评论或 DM 中更容易理解 GPT-3 模型。

我们是 TextCortex 一家 AI 初创公司,它会带走你 80% 的写作工作。

OpenAI 的历史

为什么 OpenAI 在这种情况下很重要?

他们是能够在该领域引起重大兴趣的灯塔。

从好奇的学者、严肃的公司、富有创造力的企业家一直到单身人士,他们都希望在变压器技术创造历史时成为其中的一员。

让我们从创建 GPT-3 的人开始这个故事情节。

2015 年底- 故事始于我们今天看到的技术创新者埃隆·马斯克 (Elon Musk) 的许多创新发展。

他们与 Sam Altman 和其他几位投资伙伴一起承诺斥资 10 亿美元建立一个非营利组织,该组织将与研究界自由合作并引领人工智能的伦理发展。

2019年对于 OpenAI 来说是真正多事的一年。

在 Elon Musk 离开该组织后,微软参与了另外 10 亿美元的项目,将公司转变为一个商业驱动的营利性组织。

当 OpenAI 准备上市时,他们的一个模型开始引起轰动——当时宣称太危险而无法向世界发布。

旁注:上面提到的危险是我在大学学习机器学习时搬到太空的原因之一。

2020 年,他们向全世界发布了 GPT-3。

一个 AI 模型几乎是其前身的116 倍( 1750 亿)。 参数*.

最初,只有少数几家选定的机构可以进行试验,直到最近他们向所有愿意为其功能支付昂贵费用的人开放 GPT-3。

- 将参数视为补充和帮助您的 AI 大脑的大小。

AI文案的出现

GPT-3 激励了许多产品构建者在 GPT-3 之上创建一个美观的用户界面。 我只是在开始时提到了其中的一些。

但是,我们每周都会观察到相同产品的新发布。

在看到第 40 个工具后,我停止将有关它们的信息收集到我的知识库中......

我看到他们中的一些人声称他们通过成为更好的“GPT-3 API 的沟通者”来区分自己。

这意味着什么? 这是一个真正的差异化点吗?

API 是应用程序编程接口的缩写。

听起来很复杂,但你还记得电影中的大神谕总是有一个看门人为他们说话吗?

API对于计算机来说就是这样。

所有这些 AI 文案公司都在朝 GPT-3 的守门人朝圣,以发送用户的愿望并获得答案。

回到成为 GPT-3 的看门人 API 的最佳沟通者这一点。

虽然沟通很重要,但它不会影响预言机在创建时的过程。

只有 OpenAI 才能改进为您创造的人工智能。

然而,GPT-3 不再是区块上唯一的预言机。

随着兴趣的增加,有各种不同的 oracles 可用,在 TextCortex,我们每天都在用我们自己的数据训练它们,以实现它们各自的最佳目标。

使用 GPT-3 编写工具时要注意的 4 件事

正如我所说,我们已经看到那些人工智能文案工具像雨后森林地面上的蘑菇一样突然出现。

他们中的大多数人只有一个动机——赚快钱。

当您考虑软件背后公司的稳定性时,这就会成为一个问题。

我们做了一些估算,并以我们的高级用户为例,他们的单个用户每月的运营成本约为 100 美元。

我向那些开始终身交易的人表示哀悼,他们才意识到 GPT-3 并不是免费提供的。

对于购买这些产品的客户现在站在关上的门前,使用没有回应的软件感到难过。

此外,像 Replika AI 这样拥有 700 万用户的大型 AI 合作公司已经放弃了 GPT-3,因为它们无法影响质量,同时为了锁定依赖关系而支付高昂的运营成本。

1. 不要跳到最便宜(终身)的交易上

就像生活中的许多东西一样,买便宜的东西很贵。

终身交易也是如此。

我见过很多用户联系我们,因为他们曾经使用的软件要么关闭了客户支持,要么本身不再工作,因为它存在根本的操作缺陷。

小心... 快付钱给眼睛里有美元符号的人。

2.不要中了#模板技巧

许多广告模板只是占位符,以便了解您可能感兴趣的内容。

这是我们观察到的常见抱怨。 糟糕的“创建相关性说明”或不断重复的创建模式。

我们在社区内的密切对话中积极询问用户他们想要什么。

当我们对某种格式产生足够的兴趣时,我们会深入挖掘,收集数据,训练自己的 AI 转换器模型,并为我们的社区提供可持续发展的东西。

3. 当每个人都使用相同的时候,它会损害你的排名

正如我们所说,所有这些声称是人工智能但最终只是通过千篇一律的流程推动和旋转您的输入的基于规则的软件正在受到打击。

尽管像 GPT-3 这样的现代人工智能技术让人感觉非常有创意和自然,但假设检测他们的创造将是一个挑战,它会给你一种安全感。

但是,如果太多人使用单一模式来创建它,则可以对其进行逆向工程。

我们看到运行 GPT-3 的提供商每月为您提供 10.000 篇博客文章。

那些不良行为者只会螺旋出更多的踪迹以提出解决方案。

目前,我们认为可以利用内容相关性 (RTC) 指标来检测 AI 生成内容的使用情况。

让我给你一个手机市场的类似情况。

如果您要提供服务、构建应用程序或攻击系统,您会选择哪一个?

苹果的 iOS 带有 apx。 27.5%还是Androids 71%的全球移动操作系统份额?

所以想想谷歌在处理人工智能生成的内容时的第一个目标是什么。

使用目标驱动的模型对您有利,这些模型是各自领域的专家。

在它旁边,您应该尽可能多地寻找可定制性。 例如,我们为您提供利用不同的创意引擎。

4. 基础设施更新时不稳定

那些大型语言模型正在不断发展。

任何更新和培训底层基础设施都会影响文本质量的输出。

由于大多数 AI 文案工具都依赖并依赖于 GPT-3 的多种变体,因此其基础架构的更改会破坏质量。

他们需要时间才能找到“他们再次与神谕通信”。 ;)

为什么 GPT-3 只是自然语言生成的开始,以及我们如何在 TextCortex 以不同的方式做事

我现在已经把它宠坏了好几次了,你可以猜到我的答案,我们是否使用 GPT-3 实现了自然语言生成的 Olymp?

这是一个不,我们没有。

毫不犹豫地,我再次重申,GPT-3 是大胆的一步,它让个人、学者、企业和政府都加入了这个领域。

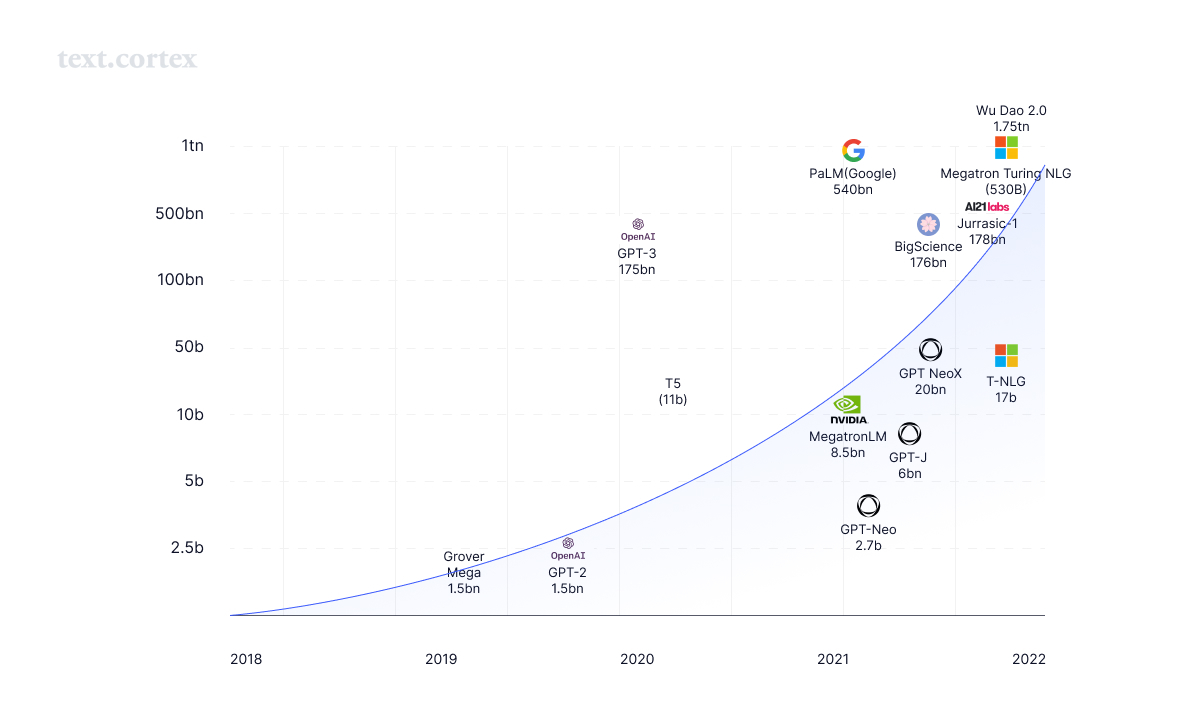

尽管如此,这是一个新时代的开始。 目前,我们看到了在创建具有更多参数、更大大脑的 AI 方面的军备竞赛。

回到我的变形金刚(电影)叙事微软威震天图灵模型。

大脑大小是 GPT-3 的 3 倍的模型。

使用其5300亿。 为您的产品或博客文章编写描述的参数就像为智能手机充电的唯一目的建造一座煤电厂。

它不止于此。

有传言称 GPT-4 将在万亿参数中。

谷歌宣布已经实现了数万亿的模型。

中国武道模式也在那里。

这是否意味着它们比 GPT-3 好 10 倍?

更大的参数大小会带来更好的创建吗?

强大的力量是否伴随着巨大的责任?

有一件事是肯定的:大参数大小肯定会带来巨大的功耗。

构建、训练和操作如此庞大的语言模型对环境来说是一场灾难。

还记得我之前是如何谈论“预训练”模型的吗? 创建一个超出其可以学习的数量的大脑并没有帮助。 最聪明的蹒跚学步的孩子仅限于学习从环境中观察到的东西。

我们非常尊重从 OpenAI 到 DeepMind 到 EleutherAI 到 AI21 Labs 的 NLG 领域的 OG。

所有人都倾注了巨大的努力和资源,使人类向前迈出了一步。

我们希望加入他们的行列,并鄙视那些渴望从他们的工作中获得快速收益的人。

在 TextCortex,我们喜欢做艰苦的工作。

因为走捷径不会建立持久和有竞争力的价值,因为它关系到你的核心。

创作的品质。

虽然 GPT-3 是一个多面手,一个真正的多面手,但对于 AI 文案的用例来说,它的规模已经很大。

就像人类已经从泛化到专业化,发展到今天的我们一样。

这也将涉及自然语言生成。

这就是为什么在 TextCortex,我们没有开发一种适合所有人的模型。 我们构建小型目标驱动模型,建立和编排网络。

因为“一刀切”,根本不适合所有。

我们构建了一个由 100 个和 1000 个模型组成的网络,而不是一个庞大的万亿参数 AI 模型,它可以作为专家 AI 写作伙伴。

我们正在根据我们自己精心挑选的知识和数据训练、构建、测试、开发、试验和部署我们自己的 AI 模型。

教他们成为通才世界的专家。

我们没有提供 100 多个经常错过与您的需求相关性的预写模板,而是发布了我们专门探索、收集知识并训练我们的 AI 掌握的模板。

为自己选择合适的 AI 写作工具

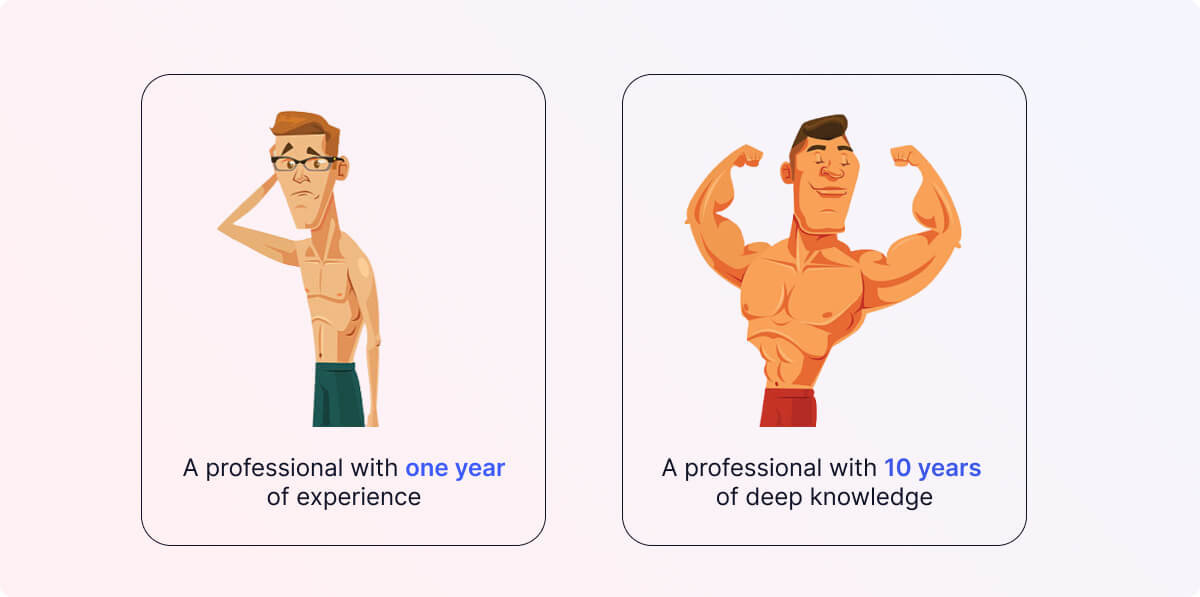

这是一个简单的问题,您更喜欢什么?

在您需要的领域中拥有一年经验的专业人士还是拥有 10 年深厚知识的专业人士?

应该写可靠合同的律师是否也需要知道如何撰写有关巧克力松饼食谱的最吸引人的博客?

通过我们较小的目的驱动的人工智能模型方法,我们可以教他们某些格式和写作风格的原因、方式和内容。

例如,我们的长模型在超过 1000 万个高度参与的博客上进行了训练。

他们明白,长篇内容包括对内容丰富的主要部分的引人入胜的介绍,以及将所有内容带入一个重点的结论。

使 AI 模型适应我们的用户需求是我们的日常工作。

我们每天都在努力扩大这个 AI 专家网络,并将他们带到您需要他们成为的每个文本框中。

你是一个狂热的作家吗?

查看我们的 chrome 扩展程序,在每个文本框中为您的作品充电。

您是正在寻找 NLG AI 解决方案的开发人员? 联系我们测试我们的 API。

您想为我们的事业贡献数据吗? 请做我们的客人。

让我们有目的地构建有创意的 AI!